Qu'est-ce qu'Amazon Bedrock ? La plateforme AWS GenAI expliquée

Résumé rapide : Amazon Bedrock est un service entièrement géré et sans serveur d'AWS qui permet aux développeurs de créer et de mettre à l'échelle des applications d'IA générative en utilisant des modèles de base de premier plan provenant de fournisseurs tels qu'Anthropic, Meta, Mistral AI et Amazon, sans avoir à gérer l'infrastructure. Il fournit un accès sécurisé de niveau entreprise à des centaines de modèles d'IA via une API unifiée, ainsi que des outils de personnalisation, des bases de connaissances, des agents et des garde-fous.

L'IA générative est passée du statut de nouveauté expérimentale à celui de nécessité stratégique. Selon des données récentes de l'industrie, 81% des cadres dirigeants mènent aujourd'hui des initiatives d'adoption de l'IA, contre seulement 53% l'année dernière. Mais l'enthousiasme se heurte à la réalité lorsque les équipes sont confrontées aux limites de l'infrastructure, que 44% des entreprises identifient comme leur principal obstacle.

Amazon Bedrock est apparu comme la réponse d'AWS à ce défi. Lancée en 2023, il s'agit d'une plateforme entièrement gérée qui supprime la charge d'infrastructure liée à la création d'applications d'IA générative. Au lieu de provisionner des serveurs, d'entraîner des modèles ou de gérer la mise à l'échelle, les développeurs accèdent aux principaux modèles de base par le biais d'une API unifiée.

Et ça marche. Amazon Bedrock alimente l'IA générative pour plus de 100 000 organisations dans le monde, des startups aux entreprises mondiales dans tous les secteurs.

Le service de base : Ce que fait réellement Amazon Bedrock

Amazon Bedrock est une offre de plateforme en tant que service (PaaS) qui fournit un accès sans serveur aux modèles de fondation. Le service élimine les obstacles traditionnels au déploiement de l'IA : infrastructure coûteuse, expertise en formation de modèles et complexité de la mise à l'échelle.

Mais voilà, Bedrock ne consiste pas à construire des modèles à partir de zéro. Il s'agit d'accéder à des modèles de pointe pré-entraînés et de les personnaliser en fonction des besoins spécifiques de l'entreprise. Les développeurs soumettent des invites et génèrent des réponses en utilisant des opérations d'inférence de modèle sans jamais toucher aux configurations de serveur.

La plateforme prend en charge de multiples modalités. La génération de texte, la création d'images, l'intégration multimodale et la génération de code s'effectuent toutes via la même interface unifiée. Cette cohérence est importante lorsque les équipes doivent échanger des modèles sans réécrire des applications entières.

Architecture entièrement gérée et sans serveur

Bedrock gère la mise à l'échelle automatique en coulisses. Lorsque le trafic de l'application augmente, le service fournit une capacité supplémentaire. Lorsque l'utilisation diminue, les ressources sont réduites. Aucune intervention manuelle n'est nécessaire.

Ce modèle sans serveur signifie que les équipes ne paient que pour l'utilisation réelle. Il n'y a pas de coût pour une infrastructure inactive qui attend les demandes. Selon la documentation officielle d'AWS, le service s'intègre directement à d'autres offres AWS telles que S3 et SageMaker par le biais d'API standard.

Modèles de base : L'avantage de la sélection des modèles

Le choix du modèle est au cœur de la proposition de valeur de Bedrock. La plateforme donne accès à des centaines de modèles de base provenant des principaux fournisseurs d'IA, et la possibilité de les échanger sans réécrire le code transforme la sélection de modèles d'une contrainte technique en un avantage stratégique.

Les fournisseurs actuellement pris en charge sont Anthropic (modèles Claude), Amazon (séries Nova et Titan), Meta (Llama), Google (Gemma 3), Mistral AI, AI21 Labs (Jamba), OpenAI et Qwen. Chaque fournisseur apporte des atouts différents. Claude 3.5 Sonnet excelle dans les raisonnements complexes. Nova Premier gère les tâches multimodales. Titan Embeddings optimise la recherche sémantique.

Les outils d'évaluation intégrés aident les équipes à comparer les performances, les coûts et la précision des différents modèles. Ainsi, la sélection des modèles ne se fait plus au hasard, mais sur la base de données.

Structure des prix : Comment Amazon Bedrock facture

Bedrock utilise une tarification basée sur les jetons avec plusieurs niveaux de service. Les coûts dépendent du fournisseur de modèle spécifique, de la modalité et du niveau de service sélectionné.

À partir de mars 2026, la page officielle des prix présente plusieurs niveaux :

- Niveau standard : Prix de base pour l'inférence à la demande

- Niveau de flexibilité : Un rapport qualité-prix optimisé pour des cas d'utilisation spécifiques

- Niveau de priorité : Taux standard plus prime pour un traitement plus rapide (jusqu'à 25% de meilleur temps de latence)

- Niveau réservé : Tarification basée sur l'engagement pour les charges de travail prévisibles

L'inférence par lots offre une réduction de 50% par rapport à la tarification à la demande pour certains modèles de fondation. La tarification est calculée pour 1 million de jetons en entrée et en sortie.

| Modèle | Entrée (pour 1 million de jetons) | Production (pour 1 million de jetons) |

|---|---|---|

| Claude Instant 1.2 | $0.0008 par 1K jetons en entrée et $0.0024 par 1K jetons en sortie (ou $0.80 et $2.40 par million de jetons) | $0.0008 par 1K jetons en entrée et $0.0024 par 1K jetons en sortie (ou $0.80 et $2.40 par million de jetons) |

| Claude 2.1 | $8.00 | $24.00 |

| Gemma 3 4B | $0.04 | $0.08 |

| Gemma 3 12B | $0.09 | $0.29 |

La page officielle des prix indique que les tarifs varient en fonction de la région AWS. Les régions US East (Virginie), US East (Ohio) et US West (Oregon) proposent généralement les tarifs les plus compétitifs. Les opérations de lecture et d'écriture du cache sont facturées séparément pour les modèles qui prennent en charge la mise en cache rapide.

Les capacités clés qui différencient Bedrock

Bases de connaissances

Les bases de connaissances permettent aux applications de connecter des modèles de base à des sources de données propriétaires. Le service prend en charge l'ensemble du flux de travail Retrieval-Augmented Generation (RAG) : ingestion de documents à partir de S3, création d'encastrements vectoriels, stockage dans des bases de données vectorielles et récupération du contexte pertinent pour les messages-guides.

Cette capacité transforme les réponses génériques de l'IA en réponses fondées sur des données, des politiques ou des documents techniques spécifiques de l'entreprise.

Agents

Les agents Bedrock orchestrent des tâches en plusieurs étapes en décomposant les demandes des utilisateurs, en invoquant les API et en exécutant des actions. Un agent peut prendre des rendez-vous, interroger des bases de données et effectuer des calculs, le tout par le biais d'instructions en langage naturel.

Les agents représentent un passage de la simple réponse à des questions à l'exécution autonome de tâches. Ils étendent ce que l'IA générative peut accomplir sans code d'orchestration personnalisé.

Garde-corps

Les garde-fous renforcent les politiques de sécurité sur les entrées et les sorties des modèles. Les équipes configurent des filtres de contenu, des restrictions de sujets et la rédaction d'informations sensibles sans modifier le code de l'application.

Cela est important pour les secteurs réglementés. Les services financiers, les soins de santé et les applications gouvernementales doivent empêcher les modèles de générer des contenus inappropriés ou de divulguer des données protégées. Les garde-fous fournissent cette couche de contrôle.

Personnalisation du modèle

Les capacités de réglage fin permettent aux équipes d'adapter les modèles de base en utilisant leurs propres ensembles de données. Cela permet d'améliorer les performances pour les tâches spécifiques à un domaine sans avoir à former des modèles à partir de zéro.

La personnalisation maintient le modèle sans serveur. Les équipes téléchargent les données d'entraînement, configurent les hyperparamètres, et Bedrock s'occupe du reste.

Amazon Bedrock vs. concurrents

Le marché des plateformes d'IA générative s'articule autour de trois acteurs majeurs : Amazon Bedrock, Azure OpenAI Service et Google Vertex AI. Chacun adopte une approche différente.

Bedrock met l'accent sur la diversité des modèles. Azure OpenAI se concentre fortement sur les modèles OpenAI (GPT-4, GPT-3.5) avec des alternatives limitées. Google Vertex AI donne naturellement la priorité aux modèles propres à Google tels que PaLM et Gemini.

L'histoire de l'intégration diffère également. Bedrock se connecte nativement aux services AWS - S3, Lambda, IAM, CloudWatch. Azure OpenAI s'intègre à l'écosystème de Microsoft. Vertex AI fonctionne mieux au sein de Google Cloud Platform.

Les architectures de sécurité reflètent les philosophies des plateformes. Bedrock utilise des points de terminaison VPC et des rôles IAM sans services de passerelle supplémentaires. Les implémentations Azure nécessitent souvent la gestion des API (APIM) pour l'intégration VNET, ce qui ajoute des coûts horaires et des frais de traitement des données.

La réalité : Près de 74% des organisations utilisent désormais des plateformes d'IA basées sur le cloud pour réduire les coûts d'infrastructure et optimiser les ressources. Le verrouillage des plateformes reste une préoccupation, mais les stratégies d'IA multi-cloud restent complexes.

Applications et cas d'utilisation dans le monde réel

Amazon Bedrock prend en charge diverses applications d'IA générative dans différents secteurs. Les chatbots du service client utilisent les modèles de Claude pour gérer des conversations nuancées. Les systèmes de génération de contenu s'appuient sur de multiples modèles pour créer des textes marketing, des descriptions de produits et de la documentation technique.

La génération de code représente un autre cas d'utilisation majeur. Les équipes de développement utilisent Bedrock pour générer automatiquement du code de base, écrire des tests unitaires et expliquer des bases de code complexes en langage naturel.

Les applications de traitement de documents combinent des bases de connaissances avec des modèles de base pour extraire des informations des contrats, des rapports financiers et des documents juridiques. L'architecture RAG fonde les réponses sur le contenu réel des documents plutôt que sur les hallucinations des modèles.

Selon AWS, des entreprises telles que Robinhood et Epsilon s'appuient sur Bedrock pour leurs applications d'IA de production. Le service gère les charges de travail orientées client où la latence et la fiabilité ont un impact direct sur les résultats de l'entreprise.

Découvrez comment les données d'Amazon sont utilisées dans la pratique

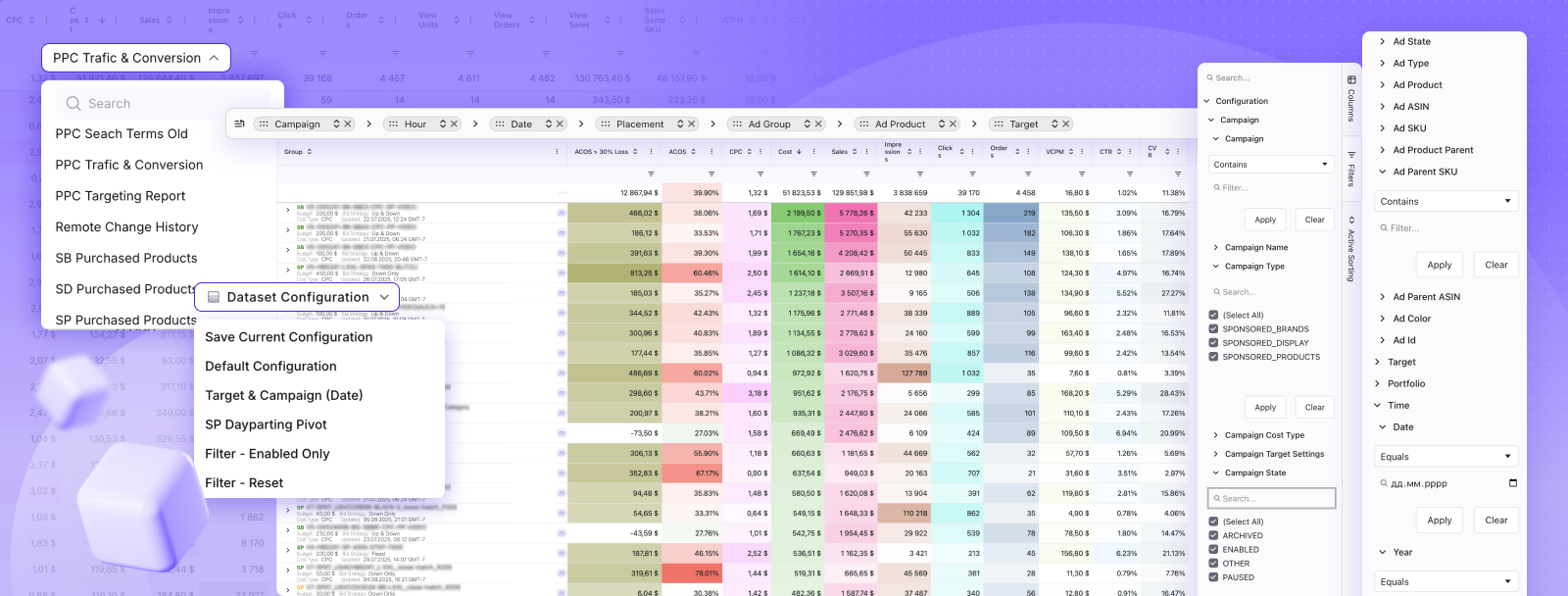

Amazon Bedrock explique comment AWS gère les données à grande échelle et les modèles d'IA en coulisses. Mais du côté de la place de marché, la plupart des décisions se résument encore à des données plus simples - annonces, clics et ventes, et comment elles sont connectées. WisePPC fonctionne avec cette couche.

Il rassemble les données relatives aux annonces et aux ventes d'Amazon en un seul endroit afin que vous puissiez voir les performances sans avoir à assembler des rapports. Vous pouvez suivre l'évolution des campagnes dans le temps, comparer les résultats et ajuster directement les enchères ou les budgets, tout cela en vous basant sur le même ensemble de données plutôt que sur des vues distinctes. Explorer WisePPC pour voir comment les données d'Amazon sont utilisées dans les décisions quotidiennes.

Pour commencer : Premiers pas avec Bedrock

AWS propose un parcours de démarrage rapide pour les nouveaux utilisateurs de Bedrock. La console offre une interface web pour tester les modèles sans écrire de code. Les équipes peuvent soumettre des invites, comparer les résultats des différents modèles et évaluer les performances avant de s'engager dans l'intégration de l'API.

Pour l'accès programmatique, l'API Bedrock prend en charge les bibliothèques SDK AWS standard dans plusieurs langages - Python, JavaScript, Java, Go, C++. L'authentification utilise les identifiants IAM, le même système d'identité que les autres services AWS.

L'accès aux modèles nécessite une autorisation explicite. Tous les modèles de fondation ne sont pas disponibles par défaut. Les équipes demandent l'accès via la console Bedrock, et AWS fournit la capacité en fonction de la disponibilité et du statut du compte.

La documentation officielle comprend des exemples de code pour les opérations courantes : l'invocation de modèles, la diffusion de réponses, la gestion de conversations et la mise en œuvre de flux de travail RAG. Ces exemples accélèrent le développement initial.

Limites et considérations

Amazon Bedrock fonctionne exclusivement au sein de l'infrastructure AWS. Les équipes engagées dans des stratégies multi-cloud ou déjà investies dans Azure ou GCP sont confrontées à des défis de migration. Le service n'offre pas d'options de déploiement portable.

La disponibilité régionale varie. Tous les modèles ne sont pas accessibles dans toutes les régions AWS. Les différences de prix entre les régions peuvent avoir un impact sur les stratégies d'optimisation des coûts. Les équipes doivent vérifier la disponibilité des modèles dans leur région de déploiement préférée avant de planifier l'architecture.

Des contraintes de capacité du modèle surviennent parfois pendant les périodes de forte demande. Le niveau de priorité aide, mais même les niveaux de service les plus élevés ne peuvent pas garantir une disponibilité instantanée en cas de pics d'utilisation extrêmes. Les entreprises clientes attendent parfois des semaines pour obtenir l'approbation de la capacité dans des régions spécifiques.

Des capacités de réglage fin existent mais n'égalent pas la profondeur d'une formation personnalisée sur une infrastructure dédiée. Les équipes ayant des besoins très spécialisés peuvent se heurter à des limites dans la profondeur de personnalisation des modèles.

Questions fréquemment posées

À quoi sert exactement Amazon Bedrock ?

Amazon Bedrock est utilisé pour créer des applications d'IA générative telles que des chatbots, des générateurs de contenu, des analyseurs de documents et des assistants de code sans avoir à gérer d'infrastructure.

Combien coûte Amazon Bedrock ?

La tarification est basée sur les jetons et varie selon le modèle. Les coûts dépendent des jetons d'entrée/sortie et du fournisseur choisi, des réductions étant possibles pour le traitement par lots.

Quels sont les modèles disponibles dans Amazon Bedrock ?

Bedrock propose des modèles de fournisseurs tels que Anthropic, Amazon, Meta, Google, Mistral et d'autres, dont la disponibilité dépend de la région.

Amazon Bedrock est-il identique à AWS SageMaker ?

Non, SageMaker se concentre sur l'entraînement de modèles personnalisés, tandis que Bedrock fournit un accès sans serveur à des modèles pré-entraînés pour un déploiement plus rapide.

Amazon Bedrock peut-il travailler avec mes données privées ?

Oui, il peut se connecter à des sources de données privées telles que S3 tout en gardant les données sécurisées au sein de votre compte AWS.

Quels sont les secteurs qui utilisent Amazon Bedrock ?

Les secteurs d'activité comprennent la finance, les soins de santé, la vente au détail, les médias, le développement de logiciels et les administrations publiques.

Amazon Bedrock prend-il en charge le réglage fin ?

Oui, certains modèles permettent un réglage fin pour personnaliser les résultats à l'aide de vos propres données.

Réflexions finales

Amazon Bedrock élimine les obstacles traditionnels à l'adoption de l'IA générative. L'architecture sans serveur, entièrement gérée, permet aux équipes de se concentrer sur la logique de l'application plutôt que sur la gestion de l'infrastructure. L'accès à des centaines de modèles de fondation de premier plan par le biais d'une API unifiée offre une flexibilité à mesure que la technologie de l'IA évolue.

Mais la plateforme vit au sein d'AWS. Les stratégies multi-cloud nécessitent des couches d'architecture supplémentaires. Les limitations régionales et les contraintes de capacité peuvent ralentir les déploiements. Les équipes doivent évaluer ces compromis par rapport à la simplicité opérationnelle qu'offre Bedrock.

Pour les organisations déjà engagées dans l'infrastructure AWS, Bedrock offre le chemin le plus rapide de l'expérimentation de l'IA au déploiement de la production. La combinaison de la diversité des modèles, de la sécurité d'entreprise et de l'intégration des services AWS crée une plateforme convaincante pour la mise à l'échelle des applications d'IA générative.

Prêt à construire avec l'IA générative ? Commencez à explorer Amazon Bedrock via la console AWS, testez des modèles pour des cas d'utilisation spécifiques et évaluez comment la plateforme s'adapte aux flux de travail existants. La documentation officielle et les guides de démarrage rapide fournissent des chemins d'accès clairs pour les équipes, quel que soit leur niveau d'expérience.

Rejoignez la bêta de WisePPC et bénéficiez d'un accès exclusif

WisePPC est maintenant en version bêta - et nous invitons un nombre limité d'utilisateurs à nous rejoindre. En tant que bêta-testeur, vous bénéficierez d'un accès gratuit, d'avantages à vie et d'une chance de contribuer à l'élaboration du produit - d'un Amazon Ads Verified Partner vous pouvez faire confiance.

Aucune carte de crédit n'est requise

Aucune carte de crédit n'est requise

Gratuit en version bêta et mois supplémentaire gratuit après la sortie de la version bêta

Gratuit en version bêta et mois supplémentaire gratuit après la sortie de la version bêta

25% à vie - offre bêta limitée

25% à vie - offre bêta limitée

Accédez aux mesures que les publicités d'Amazon ne vous montrent pas

Accédez aux mesures que les publicités d'Amazon ne vous montrent pas

Participez à l'élaboration du produit grâce à vos commentaires

Participez à l'élaboration du produit grâce à vos commentaires