Czym jest Amazon Bedrock? Wyjaśnienie platformy AWS GenAI

Szybkie podsumowanie: Amazon Bedrock to w pełni zarządzana, bezserwerowa usługa AWS, która umożliwia programistom tworzenie i skalowanie generatywnych aplikacji AI przy użyciu wiodących modeli fundamentalnych od dostawców takich jak Anthropic, Meta, Mistral AI i Amazon bez konieczności zarządzania infrastrukturą. Zapewnia bezpieczny dostęp klasy korporacyjnej do setek modeli sztucznej inteligencji za pośrednictwem ujednoliconego interfejsu API, wraz z narzędziami do dostosowywania, bazami wiedzy, agentami i zabezpieczeniami.

Generatywna sztuczna inteligencja zmieniła się z eksperymentalnej nowości w strategiczną konieczność. Według najnowszych danych branżowych, 81% kadry kierowniczej prowadzi obecnie inicjatywy związane z wdrażaniem sztucznej inteligencji, w porównaniu do zaledwie 53% w ubiegłym roku. Entuzjazm zderza się jednak z rzeczywistością, gdy zespoły napotykają ograniczenia infrastrukturalne, które 44% firm identyfikuje jako główną przeszkodę.

Amazon Bedrock pojawił się jako odpowiedź AWS na to wyzwanie. Uruchomiona w 2023 roku, jest w pełni zarządzaną platformą, która usuwa obciążenie infrastrukturalne z tworzenia generatywnych aplikacji AI. Zamiast udostępniać serwery, trenować modele lub zarządzać skalowaniem, programiści uzyskują dostęp do wiodących modeli fundamentalnych za pośrednictwem ujednoliconego interfejsu API.

I to działa. Amazon Bedrock obsługuje generatywną sztuczną inteligencję dla ponad 100 000 organizacji na całym świecie, od startupów po globalne przedsiębiorstwa z każdej branży.

Usługa podstawowa: Co tak naprawdę robi Amazon Bedrock

Amazon Bedrock to platforma jako usługa (PaaS), która zapewnia bezserwerowy dostęp do modeli fundamentalnych. Usługa eliminuje tradycyjne bariery we wdrażaniu sztucznej inteligencji: kosztowną infrastrukturę, wiedzę specjalistyczną w zakresie szkolenia modeli i złożoność skalowania.

Nie chodzi tu jednak o budowanie modeli od podstaw. Chodzi o dostęp do wstępnie wytrenowanych, najnowocześniejszych modeli i dostosowanie ich do konkretnych potrzeb biznesowych. Programiści przesyłają monity i generują odpowiedzi za pomocą operacji wnioskowania o modelu bez konieczności dotykania konfiguracji serwera.

Platforma obsługuje wiele modalności. Generowanie tekstu, tworzenie obrazów, multimodalne osadzanie i generowanie kodu odbywa się za pośrednictwem tego samego ujednoliconego interfejsu. Ta spójność ma znaczenie, gdy zespoły muszą wymieniać modele bez przepisywania całych aplikacji.

W pełni zarządzana i bezserwerowa architektura

Bedrock obsługuje automatyczne skalowanie za kulisami. Gdy ruch w aplikacji wzrasta, usługa zapewnia dodatkową pojemność. Gdy wykorzystanie spada, zasoby są skalowane w dół. Nie jest wymagana ręczna interwencja.

Ten bezserwerowy model oznacza, że zespoły płacą tylko za rzeczywiste wykorzystanie. Nie ma kosztów za bezczynną infrastrukturę czekającą na żądania. Zgodnie z oficjalną dokumentacją AWS, usługa integruje się bezpośrednio z innymi ofertami AWS, takimi jak S3 i SageMaker, za pośrednictwem standardowych interfejsów API.

Modele Foundation: Przewaga w wyborze modelu

Wybór modelu leży u podstaw propozycji wartości Bedrock. Platforma zapewnia dostęp do setek podstawowych modeli od wiodących dostawców sztucznej inteligencji, a możliwość ich wymiany bez konieczności przepisywania kodu przekształca wybór modelu z ograniczenia technicznego w przewagę strategiczną.

Obecnie obsługiwani dostawcy to Anthropic (modele Claude), Amazon (serie Nova i Titan), Meta (Llama), Google (Gemma 3), Mistral AI, AI21 Labs (Jamba), OpenAI i Qwen. Każdy z dostawców ma inne mocne strony. Claude 3.5 Sonnet wyróżnia się złożonym rozumowaniem. Nova Premier obsługuje zadania multimodalne. Titan Embeddings optymalizuje wyszukiwanie semantyczne.

Wbudowane narzędzia oceny pomagają zespołom porównywać wydajność, koszty i dokładność różnych modeli. Dzięki temu wybór modelu zmienia się ze zgadywania w podejmowanie decyzji w oparciu o dane.

Struktura cenowa: Jak Amazon Bedrock pobiera opłaty

Bedrock stosuje ceny oparte na tokenach z wieloma poziomami usług. Koszty zależą od konkretnego dostawcy modelu, wybranej modalności i poziomu usług.

Od marca 2026 r. oficjalna strona z cenami zawiera kilka poziomów:

- Poziom standardowy: Cena podstawowa dla wnioskowania na żądanie

- Poziom elastyczny: Zoptymalizowany stosunek ceny do wydajności dla określonych przypadków użycia

- Poziom priorytetu: Standardowa stawka plus premium dla szybszego przetwarzania (do 25% lepsze opóźnienie)

- Poziom zastrzeżony: Ceny oparte na zobowiązaniach dla przewidywalnych obciążeń roboczych

Wnioskowanie wsadowe oferuje zniżkę 50% w porównaniu do cen na żądanie dla wybranych modeli Foundation. Ceny są obliczane za 1 milion tokenów zarówno dla danych wejściowych, jak i wyjściowych.

| Model | Dane wejściowe (na 1 mln tokenów) | Wydajność (na 1 mln tokenów) |

|---|---|---|

| Claude Instant 1.2 | $0,0008 za 1 tys. tokenów wejściowych i $0,0024 za 1 tys. tokenów wyjściowych (lub $0,80 i $2,40 za milion tokenów). | $0,0008 za 1 tys. tokenów wejściowych i $0,0024 za 1 tys. tokenów wyjściowych (lub $0,80 i $2,40 za milion tokenów). |

| Claude 2.1 | $8.00 | $24.00 |

| Gemma 3 4B | $0.04 | $0.08 |

| Gemma 3 12B | $0.09 | $0.29 |

Oficjalna strona z cenami zauważa, że stawki różnią się w zależności od regionu AWS. Najbardziej konkurencyjne ceny oferują zazwyczaj regiony US East (Wirginia), US East (Ohio) i US West (Oregon). Operacje odczytu i zapisu w pamięci podręcznej wiążą się z osobnymi opłatami dla modeli obsługujących szybkie buforowanie.

Kluczowe możliwości, które wyróżniają Bedrock

Bazy wiedzy

Bazy wiedzy pozwalają aplikacjom łączyć modele fundamentów z zastrzeżonymi źródłami danych. Usługa obsługuje cały przepływ pracy Retrieval-Augmented Generation (RAG): pozyskiwanie dokumentów z S3, tworzenie osadzeń wektorowych, przechowywanie ich w wektorowych bazach danych i pobieranie odpowiedniego kontekstu dla podpowiedzi.

Ta zdolność przekształca ogólne odpowiedzi AI w odpowiedzi oparte na konkretnych danych firmy, zasadach lub dokumentacji technicznej.

Agenci

Agenci Bedrock organizują wieloetapowe zadania poprzez rozbijanie żądań użytkowników, wywoływanie interfejsów API i wykonywanie akcji. Agent może rezerwować spotkania, wysyłać zapytania do baz danych i wykonywać obliczenia - wszystko za pomocą instrukcji w języku naturalnym.

Agenty stanowią przejście od prostego odpowiadania na pytania do autonomicznego wykonywania zadań. Rozszerzają to, co generatywna sztuczna inteligencja może osiągnąć bez niestandardowego kodu orkiestracji.

Barierki ochronne

Guardrails wymuszają zasady bezpieczeństwa na danych wejściowych i wyjściowych modelu. Zespoły konfigurują filtry treści, ograniczenia tematyczne i redakcję poufnych informacji bez modyfikowania kodu aplikacji.

Ma to znaczenie dla branż podlegających regulacjom. Usługi finansowe, opieka zdrowotna i aplikacje rządowe muszą zapobiegać generowaniu przez modele nieodpowiednich treści lub wyciekowi chronionych danych. Guardrails zapewniają tę warstwę kontroli.

Dostosowanie modelu

Możliwości dostrajania pozwalają zespołom dostosowywać modele fundamentalne przy użyciu własnych zestawów danych. Poprawia to wydajność dla zadań specyficznych dla domeny bez konieczności trenowania modeli od podstaw.

Personalizacja utrzymuje model bezserwerowy. Zespoły przesyłają dane szkoleniowe, konfigurują hiperparametry, a Bedrock zajmuje się resztą.

Amazon Bedrock vs konkurenci

Rynek platform generatywnej sztucznej inteligencji koncentruje się na trzech głównych graczach: Amazon Bedrock, Azure OpenAI Service i Google Vertex AI. Każdy z nich stosuje inne podejście.

Bedrock kładzie nacisk na różnorodność modeli. Azure OpenAI koncentruje się głównie na modelach OpenAI (GPT-4, GPT-3.5) z ograniczonymi alternatywami. Google Vertex AI naturalnie nadaje priorytet własnym modelom Google, takim jak PaLM i Gemini.

Historia integracji również się różni. Bedrock łączy się natywnie z usługami AWS - S3, Lambda, IAM, CloudWatch. Azure OpenAI integruje się z ekosystemem Microsoftu. Vertex AI działa najlepiej w ramach Google Cloud Platform.

Architektura zabezpieczeń odzwierciedla filozofię platformy. Bedrock używa punktów końcowych VPC i ról IAM bez dodatkowych usług bramy. Wdrożenia Azure często wymagają API Management (APIM) do integracji VNET, co zwiększa koszty godzinowe i opłaty za przetwarzanie danych.

Prawdziwa rozmowa: Prawie 74% organizacji korzysta obecnie z platform AI opartych na chmurze w celu obniżenia kosztów infrastruktury i optymalizacji zasobów. Blokada platformy pozostaje problemem, ale strategie AI w wielu chmurach pozostają złożone.

Rzeczywiste zastosowania i przypadki użycia

Amazon Bedrock obsługuje różnorodne generatywne aplikacje AI w różnych branżach. Chatboty do obsługi klienta wykorzystują modele Claude do zniuansowanej obsługi konwersacji. Systemy generowania treści wykorzystują wiele modeli do tworzenia tekstów marketingowych, opisów produktów i dokumentacji technicznej.

Generowanie kodu stanowi kolejny ważny przypadek użycia. Zespoły programistów używają Bedrock do automatycznego generowania standardowego kodu, pisania testów jednostkowych i wyjaśniania złożonych baz kodu w języku naturalnym.

Aplikacje do przetwarzania dokumentów łączą bazy wiedzy z modelami podstawowymi w celu uzyskania wglądu w umowy, raporty finansowe i dokumenty prawne. Architektura RAG opiera odpowiedzi na rzeczywistej zawartości dokumentu, a nie na modelowych halucynacjach.

Według AWS, firmy takie jak Robinhood i Epsilon wykorzystują Bedrock do produkcji aplikacji AI. Usługa obsługuje obciążenia skierowane do klientów, w których opóźnienia i niezawodność mają bezpośredni wpływ na wyniki biznesowe.

Zobacz, jak dane Amazon są wykorzystywane w praktyce

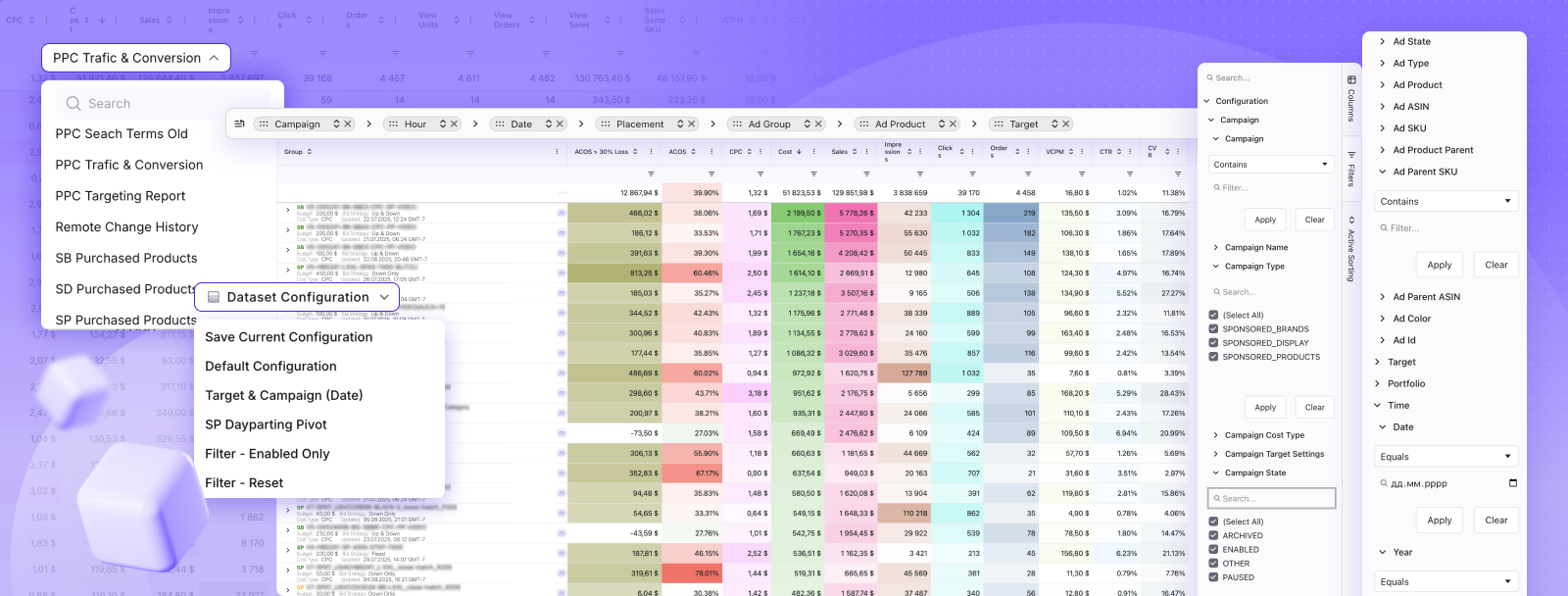

Amazon Bedrock wyjaśnia, w jaki sposób AWS obsługuje dane na dużą skalę i modele AI za kulisami. Jednak po stronie rynku większość decyzji nadal sprowadza się do prostszych danych - reklam, kliknięć i sprzedaży oraz sposobu ich łączenia. WisePPC działa z tą warstwą.

Pobiera dane dotyczące reklam i sprzedaży Amazon i przenosi je w jedno miejsce, dzięki czemu można zobaczyć wydajność bez konieczności łączenia raportów. Możesz śledzić, jak kampanie zmieniają się w czasie, porównywać wyniki i bezpośrednio dostosowywać stawki lub budżety, a wszystko to w oparciu o ten sam zestaw danych, a nie oddzielne widoki. Eksploruj WisePPC aby zobaczyć, jak dane Amazon są wykorzystywane w codziennych decyzjach.

Pierwsze kroki: Pierwsze kroki z Bedrock

AWS zapewnia ścieżkę szybkiego startu dla nowych użytkowników Bedrock. Konsola oferuje interfejs sieciowy do testowania modeli bez pisania kodu. Zespoły mogą przesyłać monity, porównywać wyniki modeli i oceniać wydajność przed podjęciem decyzji o integracji API.

W przypadku dostępu programistycznego, Bedrock API obsługuje standardowe biblioteki AWS SDK w wielu językach - Python, JavaScript, Java, Go, C++. Uwierzytelnianie wykorzystuje poświadczenia IAM, ten sam system tożsamości, co inne usługi AWS.

Dostęp do modelu wymaga wyraźnego zezwolenia. Nie wszystkie modele Foundation są dostępne domyślnie. Zespoły żądają dostępu za pośrednictwem konsoli Bedrock, a AWS zapewnia pojemność w oparciu o dostępność i stan konta.

Oficjalna dokumentacja zawiera przykłady kodu dla typowych operacji: wywoływanie modeli, przesyłanie strumieniowe odpowiedzi, zarządzanie konwersacjami i wdrażanie przepływów pracy RAG. Przykłady te przyspieszają początkowy rozwój.

Ograniczenia i rozważania

Amazon Bedrock działa wyłącznie w ramach infrastruktury AWS. Zespoły zaangażowane w strategie wielochmurowe lub już zainwestowane w Azure lub GCP stoją w obliczu wyzwań związanych z migracją. Usługa nie oferuje przenośnych opcji wdrażania.

Dostępność regionalna jest różna. Nie wszystkie modele są dostępne we wszystkich regionach AWS. Różnice cenowe w poszczególnych regionach mogą mieć wpływ na strategie optymalizacji kosztów. Zespoły powinny zweryfikować dostępność modeli w preferowanym regionie wdrożenia przed planowaniem architektury.

Ograniczenia przepustowości modelu czasami występują w okresach wysokiego zapotrzebowania. Poziom priorytetowy pomaga, ale nawet poziomy usług premium nie mogą zagwarantować natychmiastowej dostępności podczas ekstremalnych skoków użytkowania. Klienci korporacyjni czasami czekają tygodniami na zatwierdzenie przepustowości w określonych regionach.

Istnieją możliwości dostrajania, ale nie dorównują one głębokości niestandardowych szkoleń w dedykowanej infrastrukturze. Zespoły o wysoce wyspecjalizowanych wymaganiach mogą napotkać ograniczenia w zakresie głębokości dostosowywania modeli.

Często zadawane pytania

Do czego dokładnie służy Amazon Bedrock?

Amazon Bedrock służy do tworzenia generatywnych aplikacji AI, takich jak chatboty, generatory treści, analizatory dokumentów i asystenci kodu bez konieczności zarządzania infrastrukturą.

Ile kosztuje Amazon Bedrock?

Ceny są oparte na tokenach i różnią się w zależności od modelu. Koszty zależą od tokenów wejścia/wyjścia i wybranego dostawcy, a w przypadku przetwarzania wsadowego dostępne są zniżki.

Jakie modele są dostępne w Amazon Bedrock?

Bedrock oferuje modele od dostawców takich jak Anthropic, Amazon, Meta, Google, Mistral i innych, z dostępnością w zależności od regionu.

Czy Amazon Bedrock to to samo co AWS SageMaker?

Nie, SageMaker koncentruje się na niestandardowym szkoleniu modeli, podczas gdy Bedrock zapewnia bezserwerowy dostęp do wstępnie wytrenowanych modeli w celu szybszego wdrożenia.

Czy Amazon Bedrock może pracować z moimi prywatnymi danymi?

Tak, może łączyć się z prywatnymi źródłami danych, takimi jak S3, zachowując bezpieczeństwo danych na koncie AWS.

Jakie branże korzystają z Amazon Bedrock?

Branże obejmują finanse, opiekę zdrowotną, handel detaliczny, media, rozwój oprogramowania i rząd.

Czy Amazon Bedrock obsługuje dostrajanie?

Tak, niektóre modele obsługują precyzyjne dostrajanie w celu dostosowania wyników przy użyciu własnych danych.

Przemyślenia końcowe

Amazon Bedrock eliminuje tradycyjne bariery utrudniające wdrożenie generatywnej sztucznej inteligencji. W pełni zarządzana, bezserwerowa architektura pozwala zespołom skupić się na logice aplikacji, a nie na zarządzaniu infrastrukturą. Dostęp do setek wiodących modeli fundamentalnych za pośrednictwem ujednoliconego interfejsu API zapewnia elastyczność w miarę rozwoju technologii AI.

Ale platforma działa w ramach AWS. Strategie wielochmurowe wymagają dodatkowych warstw architektury. Ograniczenia regionalne i ograniczenia przepustowości mogą spowalniać wdrożenia. Zespoły powinny ocenić te kompromisy w stosunku do prostoty operacyjnej, jaką zapewnia Bedrock.

Dla organizacji już zaangażowanych w infrastrukturę AWS, Bedrock oferuje najszybszą ścieżkę od eksperymentów AI do wdrożenia produkcyjnego. Połączenie różnorodności modeli, bezpieczeństwa korporacyjnego i integracji usług AWS tworzy atrakcyjną platformę do skalowania generatywnych aplikacji AI.

Gotowy do tworzenia przy użyciu generatywnej sztucznej inteligencji? Zacznij odkrywać Amazon Bedrock za pośrednictwem konsoli AWS, testuj modele dla konkretnych przypadków użycia i oceniaj, w jaki sposób platforma pasuje do istniejących przepływów pracy. Oficjalna dokumentacja i przewodniki szybkiego startu zapewniają jasne ścieżki wdrażania dla zespołów na każdym poziomie doświadczenia.

Dołącz do WisePPC Beta i uzyskaj ekskluzywne korzyści dostępu

WisePPC jest teraz w wersji beta - i zapraszamy ograniczoną liczbę pierwszych użytkowników do dołączenia. Jako beta tester otrzymasz bezpłatny dostęp, dożywotnie profity i szansę na pomoc w kształtowaniu produktu - od Zweryfikowany partner Amazon Ads któremu można zaufać.

Karta kredytowa nie jest wymagana

Karta kredytowa nie jest wymagana

Darmowa w wersji beta i dodatkowy miesiąc za darmo po premierze

Darmowa w wersji beta i dodatkowy miesiąc za darmo po premierze

25% taniej dożywotnio - limitowana oferta beta

25% taniej dożywotnio - limitowana oferta beta

Dostęp do danych, których nie pokazują reklamy Amazon Ads

Dostęp do danych, których nie pokazują reklamy Amazon Ads

Weź udział w kształtowaniu produktu dzięki swoim opiniom

Weź udział w kształtowaniu produktu dzięki swoim opiniom