Was ist Amazon Bedrock? AWS GenAI-Plattform erklärt

Kurze Zusammenfassung: Amazon Bedrock ist ein vollständig verwalteter, serverloser Service von AWS, der es Entwicklern ermöglicht, generative KI-Anwendungen mit führenden Basismodellen von Anbietern wie Anthropic, Meta, Mistral AI und Amazon zu erstellen und zu skalieren, ohne die Infrastruktur zu verwalten. Er bietet sicheren, unternehmensgerechten Zugriff auf Hunderte von KI-Modellen über eine einheitliche API, zusammen mit Tools für die Anpassung, Wissensdatenbanken, Agenten und Leitplanken.

Generative KI hat sich von einer experimentellen Neuheit zu einer strategischen Notwendigkeit entwickelt. Jüngsten Branchendaten zufolge leiten inzwischen 81% der Führungskräfte Initiativen zur Einführung von KI, im Vergleich zu nur 53% im letzten Jahr. Der Enthusiasmus schlägt jedoch in die Realität um, wenn die Teams mit Einschränkungen bei der Infrastruktur konfrontiert werden, die 44% der Unternehmen als ihr Haupthindernis ansehen.

Amazon Bedrock ist die Antwort von AWS auf diese Herausforderung. Die im Jahr 2023 eingeführte, vollständig verwaltete Plattform entlastet die Infrastruktur bei der Entwicklung generativer KI-Anwendungen. Anstatt Server bereitzustellen, Modelle zu trainieren oder die Skalierung zu verwalten, greifen Entwickler über eine einheitliche API auf führende Grundmodelle zu.

Und es funktioniert. Amazon Bedrock betreibt generative KI für mehr als 100.000 Organisationen weltweit, von Startups bis hin zu globalen Unternehmen in allen Branchen.

Der Kernservice: Was Amazon Bedrock tatsächlich leistet

Amazon Bedrock ist ein Platform-as-a-Service (PaaS)-Angebot, das serverlosen Zugriff auf Basismodelle bietet. Der Service beseitigt die traditionellen Hindernisse für die KI-Bereitstellung: teure Infrastruktur, Fachwissen für die Modellschulung und komplexe Skalierung.

Die Sache ist die: Bei Bedrock geht es nicht darum, Modelle von Grund auf neu zu erstellen. Es geht darum, auf vortrainierte, hochmoderne Modelle zuzugreifen und sie an spezifische Geschäftsanforderungen anzupassen. Entwickler übermitteln Eingabeaufforderungen und generieren Antworten mithilfe von Modellinferenzoperationen, ohne die Serverkonfigurationen zu verändern.

Die Plattform unterstützt mehrere Modalitäten. Texterstellung, Bilderstellung, multimodale Einbettung und Codegenerierung laufen alle über dieselbe einheitliche Schnittstelle. Diese Konsistenz ist wichtig, wenn Teams Modelle austauschen müssen, ohne ganze Anwendungen neu zu schreiben.

Vollständig verwaltete und serverlose Architektur

Bedrock übernimmt die automatische Skalierung im Hintergrund. Wenn der Anwendungsverkehr in die Höhe schnellt, stellt der Dienst zusätzliche Kapazitäten bereit. Wenn die Nutzung sinkt, werden die Ressourcen reduziert. Ein manuelles Eingreifen ist nicht erforderlich.

Dieses serverlose Modell bedeutet, dass Teams nur für die tatsächliche Nutzung zahlen. Es fallen keine Kosten für eine ungenutzte Infrastruktur an, die auf Anfragen wartet. Laut der offiziellen AWS-Dokumentation lässt sich der Service über Standard-APIs direkt in andere AWS-Angebote wie S3 und SageMaker integrieren.

Gründungsmodelle: Der Vorteil der Modellauswahl

Die Modellauswahl steht im Mittelpunkt des Wertversprechens von Bedrock. Die Plattform bietet Zugang zu Hunderten von Basismodellen führender KI-Anbieter, und die Möglichkeit, diese auszutauschen, ohne den Code neu zu schreiben, verwandelt die Modellauswahl von einer technischen Einschränkung in einen strategischen Vorteil.

Zu den derzeit unterstützten Anbietern gehören Anthropic (Claude-Modelle), Amazon (Nova- und Titan-Serie), Meta (Llama), Google (Gemma 3), Mistral AI, AI21 Labs (Jamba), OpenAI und Qwen. Jeder Anbieter bringt unterschiedliche Stärken mit. Claude 3.5 Sonnet zeichnet sich durch komplexe Schlussfolgerungen aus. Nova Premier bewältigt multimodale Aufgaben. Titan Embeddings optimiert für die semantische Suche.

Mit den integrierten Bewertungswerkzeugen können Teams Leistung, Kosten und Genauigkeit verschiedener Modelle vergleichen. So wird die Modellauswahl von einem Ratespiel zu einer datengesteuerten Entscheidungsfindung.

Preisstruktur: Wie Amazon Bedrock abrechnet

Bedrock verwendet eine Token-basierte Preisgestaltung mit mehreren Service-Ebenen. Die Kosten hängen von dem jeweiligen Modellanbieter, der Modalität und der gewählten Leistungsstufe ab.

Ab März 2026 zeigt die offizielle Preisseite mehrere Stufen an:

- Standard-Stufe: Grundpreis für On-Demand-Inferenz

- Flex-Tier: Optimiertes Preis-Leistungs-Verhältnis für spezifische Anwendungsfälle

- Prioritätsstufe: Standardtarif plus Premium für schnellere Verarbeitung (bis zu 25% bessere Latenzzeit)

- Reservierte Stufe: Verpflichtungsbasierte Preisgestaltung für vorhersehbare Arbeitsbelastungen

Batch-Inferenz bietet einen 50%-Rabatt im Vergleich zu On-Demand-Preisen für ausgewählte Foundation-Modelle. Die Preise werden pro 1 Million Token sowohl für die Eingabe als auch für die Ausgabe berechnet.

| Modell | Input (pro 1M Token) | Leistung (pro 1 Mio. Token) |

|---|---|---|

| Claude Instant 1.2 | $0.0008 pro 1K Token Input und $0.0024 pro 1K Token Output (oder $0.80 und $2.40 pro Million Token) | $0.0008 pro 1K Token Input und $0.0024 pro 1K Token Output (oder $0.80 und $2.40 pro Million Token) |

| Claude 2.1 | $8.00 | $24.00 |

| Gemma 3 4B | $0.04 | $0.08 |

| Gemma 3 12B | $0.09 | $0.29 |

Auf der offiziellen Preisseite wird darauf hingewiesen, dass die Preise je nach AWS-Region variieren. US East (Virginia), US East (Ohio) und US West (Oregon) bieten in der Regel die günstigsten Preise. Für Cache-Lese- und -Schreibvorgänge fallen bei Modellen, die promptes Caching unterstützen, separate Gebühren an.

Schlüsselkompetenzen, die Bedrock auszeichnen

Wissensgrundlagen

Wissensdatenbanken ermöglichen Anwendungen die Verbindung von Basismodellen mit proprietären Datenquellen. Der Dienst übernimmt den gesamten Retrieval-Augmented Generation (RAG)-Workflow: Einlesen von Dokumenten aus S3, Erstellen von Vektoreinbettungen, Speichern in Vektordatenbanken und Abrufen von relevantem Kontext für Eingabeaufforderungen.

Diese Fähigkeit verwandelt generische KI-Antworten in Antworten, die auf spezifischen Unternehmensdaten, Richtlinien oder technischen Unterlagen beruhen.

Agenten

Bedrock-Agenten orchestrieren mehrstufige Aufgaben, indem sie Benutzeranfragen aufschlüsseln, APIs aufrufen und Aktionen ausführen. Ein Agent kann Termine buchen, Datenbanken abfragen und Berechnungen durchführen - alles über natürlichsprachliche Anweisungen.

Agenten stellen einen Übergang von der einfachen Beantwortung von Fragen zur autonomen Ausführung von Aufgaben dar. Sie erweitern die Möglichkeiten der generativen KI ohne eigenen Orchestrierungscode.

Leitplanken

Guardrails setzen Sicherheitsrichtlinien für Modelleingaben und -ausgaben durch. Teams konfigurieren Inhaltsfilter, Themenbeschränkungen und die Schwärzung sensibler Informationen, ohne den Anwendungscode zu ändern.

Dies ist wichtig für regulierte Branchen. Anwendungen für Finanzdienstleistungen, das Gesundheitswesen und Behörden müssen verhindern, dass Modelle unangemessene Inhalte erzeugen oder geschützte Daten weitergeben. Guardrails bieten diese Kontrollebene.

Modell-Anpassung

Dank der Feinabstimmungsfunktionen können Teams die Basismodelle anhand ihrer eigenen Datensätze anpassen. Dies verbessert die Leistung bei domänenspezifischen Aufgaben, ohne dass Modelle von Grund auf neu trainiert werden müssen.

Bei der Anpassung wird das serverlose Modell beibehalten. Teams laden Trainingsdaten hoch, konfigurieren Hyperparameter, und Bedrock erledigt den Rest.

Amazon Bedrock im Vergleich zu Wettbewerbern

Der Markt für generative KI-Plattformen konzentriert sich auf drei Hauptakteure: Amazon Bedrock, Azure OpenAI Service und Google Vertex AI. Jeder verfolgt einen anderen Ansatz.

Bedrock legt Wert auf Modellvielfalt. Azure OpenAI konzentriert sich stark auf OpenAI-Modelle (GPT-4, GPT-3.5) mit begrenzten Alternativen. Google Vertex AI bevorzugt natürlich Googles eigene Modelle wie PaLM und Gemini.

Auch bei der Integration gibt es Unterschiede. Bedrock verbindet sich nativ mit AWS-Diensten - S3, Lambda, IAM, CloudWatch. Azure OpenAI lässt sich in das Ökosystem von Microsoft integrieren. Vertex AI funktioniert am besten innerhalb der Google Cloud Platform.

Sicherheitsarchitekturen spiegeln Plattformphilosophien wider. Bedrock verwendet VPC-Endpunkte und IAM-Rollen ohne zusätzliche Gateway-Dienste. Azure-Implementierungen erfordern oft eine API-Verwaltung (APIM) für die VNET-Integration, die zusätzliche Stundenkosten und Datenverarbeitungsgebühren verursacht.

Echtes Gespräch: Fast 74% der Unternehmen nutzen heute Cloud-basierte KI-Plattformen, um Infrastrukturkosten zu senken und Ressourcen zu optimieren. Die Plattformabhängigkeit bleibt ein Problem, aber Multi-Cloud-KI-Strategien bleiben komplex.

Praktische Anwendungen und Anwendungsfälle

Amazon Bedrock unterstützt verschiedene generative KI-Anwendungen in verschiedenen Branchen. Chatbots für den Kundenservice verwenden Claude-Modelle für eine nuancierte Gesprächsführung. Systeme zur Generierung von Inhalten nutzen mehrere Modelle, um Marketingtexte, Produktbeschreibungen und technische Dokumentationen zu erstellen.

Die Codegenerierung ist ein weiterer wichtiger Anwendungsfall. Entwicklungsteams verwenden Bedrock zur automatischen Generierung von Boilerplate-Code, zum Schreiben von Unit-Tests und zur Erklärung komplexer Codebasen in natürlicher Sprache.

Dokumentenverarbeitungsanwendungen kombinieren Wissensdatenbanken mit Grundmodellen, um Erkenntnisse aus Verträgen, Finanzberichten und juristischen Dokumenten zu gewinnen. Die RAG-Architektur basiert auf den tatsächlichen Dokumenteninhalten und nicht auf Modellhalluzinationen.

Nach Angaben von AWS nutzen Unternehmen wie Robinhood und Epsilon Bedrock für KI-Anwendungen in der Produktion. Der Service verarbeitet kundenorientierte Arbeitslasten, bei denen sich Latenz und Zuverlässigkeit direkt auf die Geschäftsergebnisse auswirken.

Sehen Sie, wie Amazon-Daten in der Praxis verwendet werden

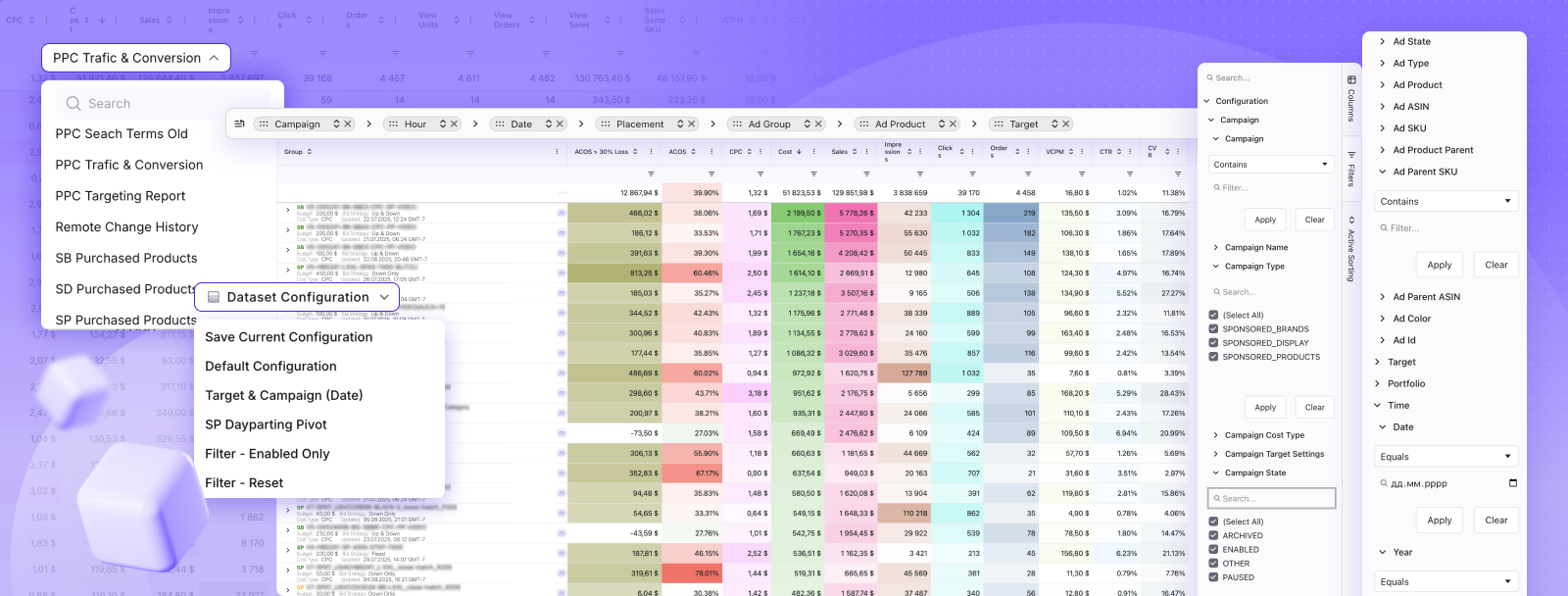

Amazon Bedrock erklärt, wie AWS groß angelegte Daten und KI-Modelle hinter den Kulissen verarbeitet. Aber auf der Marktplatzseite laufen die meisten Entscheidungen immer noch auf einfachere Daten hinaus - Anzeigen, Klicks und Verkäufe, und wie sie miteinander verbunden sind. WisePPC mit dieser Ebene arbeitet.

Es fasst Amazon-Anzeigen und Verkaufsdaten an einem Ort zusammen, sodass Sie die Leistung sehen können, ohne Berichte zusammensetzen zu müssen. Sie können verfolgen, wie sich Kampagnen im Laufe der Zeit verändern, Ergebnisse vergleichen und Gebote oder Budgets direkt anpassen - und das alles auf der Grundlage desselben Datensatzes und nicht in separaten Ansichten. Erkunden Sie WisePPC um zu sehen, wie Amazon-Daten bei täglichen Entscheidungen verwendet werden.

Erste Schritte: Erste Schritte mit Bedrock

AWS bietet einen Schnellstartpfad für neue Bedrock-Benutzer. Die Konsole bietet eine Webschnittstelle zum Testen von Modellen, ohne dass Code geschrieben werden muss. Teams können Aufforderungen übermitteln, die Ausgaben verschiedener Modelle vergleichen und die Leistung bewerten, bevor sie sich zur API-Integration verpflichten.

Für den programmatischen Zugriff unterstützt die Bedrock-API standardmäßige AWS SDK-Bibliotheken in mehreren Sprachen - Python, JavaScript, Java, Go und C++. Die Authentifizierung erfolgt über IAM-Anmeldeinformationen, das gleiche Identitätssystem wie bei anderen AWS-Services.

Der Zugriff auf ein Modell erfordert eine ausdrückliche Freigabe. Nicht alle Foundation-Modelle sind standardmäßig verfügbar. Teams beantragen den Zugriff über die Bedrock-Konsole, und AWS stellt Kapazitäten je nach Verfügbarkeit und Kontostand bereit.

Die offizielle Dokumentation enthält Codebeispiele für gängige Operationen: Aufrufen von Modellen, Streaming von Antworten, Verwaltung von Konversationen und Implementierung von RAG-Workflows. Diese Beispiele beschleunigen die anfängliche Entwicklung.

Beschränkungen und Überlegungen

Amazon Bedrock arbeitet ausschließlich innerhalb der AWS-Infrastruktur. Teams, die Multi-Cloud-Strategien verfolgen oder bereits in Azure oder GCP investiert haben, stehen vor Herausforderungen bei der Migration. Der Service bietet keine portablen Bereitstellungsoptionen.

Die regionale Verfügbarkeit ist unterschiedlich. Nicht alle Modelle sind in allen AWS-Regionen verfügbar. Preisunterschiede zwischen den Regionen können sich auf Kostenoptimierungsstrategien auswirken. Teams sollten die Modellverfügbarkeit in ihrer bevorzugten Bereitstellungsregion vor der Architekturplanung überprüfen.

In Zeiten hoher Nachfrage kommt es gelegentlich zu Kapazitätsengpässen beim Modell. Die Prioritätsstufe hilft, aber selbst Premium-Service-Level können bei extremen Nutzungsspitzen keine sofortige Verfügbarkeit garantieren. Unternehmenskunden warten manchmal wochenlang auf die Kapazitätsfreigabe in bestimmten Regionen.

Es gibt zwar Möglichkeiten zur Feinabstimmung, aber sie reichen nicht an die Tiefe der benutzerdefinierten Schulungen auf einer speziellen Infrastruktur heran. Teams mit hochspezialisierten Anforderungen können bei der Tiefe der Modellanpassung an Grenzen stoßen.

Häufig gestellte Fragen

Wofür genau wird Amazon Bedrock verwendet?

Amazon Bedrock wird verwendet, um generative KI-Anwendungen wie Chatbots, Inhaltsgeneratoren, Dokumentenanalysatoren und Code-Assistenten ohne Verwaltung der Infrastruktur zu erstellen.

Wie viel kostet Amazon Bedrock?

Die Preise sind tokenbasiert und variieren je nach Modell. Die Kosten hängen von den Eingabe-/Ausgabe-Tokens und dem gewählten Anbieter ab, wobei für die Stapelverarbeitung Rabatte möglich sind.

Welche Modelle sind in Amazon Bedrock verfügbar?

Bedrock bietet Modelle von Anbietern wie Anthropic, Amazon, Meta, Google, Mistral und anderen, wobei die Verfügbarkeit von der Region abhängt.

Ist Amazon Bedrock dasselbe wie AWS SageMaker?

Nein, SageMaker konzentriert sich auf benutzerdefiniertes Modelltraining, während Bedrock einen serverlosen Zugriff auf vortrainierte Modelle für eine schnellere Bereitstellung bietet.

Kann Amazon Bedrock mit meinen privaten Daten arbeiten?

Ja, es kann eine Verbindung zu privaten Datenquellen wie S3 herstellen, wobei die Daten innerhalb Ihres AWS-Kontos sicher sind.

Welche Branchen nutzen Amazon Bedrock?

Zu den Branchen gehören Finanzen, Gesundheitswesen, Einzelhandel, Medien, Softwareentwicklung und Behörden.

Unterstützt Amazon Bedrock die Feinabstimmung?

Ja, bestimmte Modelle unterstützen die Feinabstimmung, um die Ergebnisse anhand Ihrer eigenen Daten anzupassen.

Abschließende Überlegungen

Amazon Bedrock beseitigt die traditionellen Hindernisse für die Einführung generativer KI. Dank der vollständig verwalteten, serverlosen Architektur können sich Teams auf die Anwendungslogik und nicht auf die Infrastrukturverwaltung konzentrieren. Der Zugriff auf Hunderte von führenden Basismodellen über eine einheitliche API bietet Flexibilität, wenn sich die KI-Technologie weiterentwickelt.

Aber die Plattform befindet sich in AWS. Multi-Cloud-Strategien erfordern zusätzliche Architekturschichten. Regionale Einschränkungen und Kapazitätsbeschränkungen können die Bereitstellung verlangsamen. Teams sollten diese Kompromisse gegen die betriebliche Einfachheit von Bedrock abwägen.

Für Unternehmen, die bereits eine AWS-Infrastruktur nutzen, bietet Bedrock den schnellsten Weg von KI-Experimenten zur Produktionsbereitstellung. Die Kombination aus Modellvielfalt, Unternehmenssicherheit und AWS-Service-Integration schafft eine überzeugende Plattform für die Skalierung generativer KI-Anwendungen.

Sind Sie bereit, mit generativer KI zu arbeiten? Beginnen Sie mit der Erkundung von Amazon Bedrock über die AWS-Konsole, testen Sie Modelle für bestimmte Anwendungsfälle und bewerten Sie, wie die Plattform in bestehende Arbeitsabläufe passt. Die offizielle Dokumentation und die Schnellstartanleitungen bieten klare Einführungspfade für Teams auf jedem Erfahrungsniveau.

Nehmen Sie an der WisePPC-Beta teil und erhalten Sie exklusive Zugangsvorteile

WisePPC ist jetzt in der Beta-Phase - und wir laden eine begrenzte Anzahl von frühen Nutzern ein, daran teilzunehmen. Als Beta-Tester erhalten Sie kostenlosen Zugang, lebenslange Vergünstigungen und die Möglichkeit, das Produkt mitzugestalten - von einem Amazon Ads Verifizierter Partner dem Sie vertrauen können.

Keine Kreditkarte erforderlich

Keine Kreditkarte erforderlich

Kostenlos in der Beta-Phase und ein zusätzlicher kostenloser Monat nach der Veröffentlichung

Kostenlos in der Beta-Phase und ein zusätzlicher kostenloser Monat nach der Veröffentlichung

25% lebenslang gratis - begrenztes Beta-Angebot

25% lebenslang gratis - begrenztes Beta-Angebot

Zugriff auf Metriken, die Ihnen Amazon Ads nicht zeigen

Zugriff auf Metriken, die Ihnen Amazon Ads nicht zeigen

Gestalten Sie das Produkt mit Ihrem Feedback mit

Gestalten Sie das Produkt mit Ihrem Feedback mit