Cos'è Amazon Bedrock? La piattaforma AWS GenAI spiegata

Riepilogo rapido: Amazon Bedrock è un servizio serverless di AWS completamente gestito che consente agli sviluppatori di creare e scalare applicazioni di IA generativa utilizzando i principali modelli di base di fornitori come Anthropic, Meta, Mistral AI e Amazon senza gestire l'infrastruttura. Fornisce un accesso sicuro e di livello aziendale a centinaia di modelli di IA attraverso un'API unificata, insieme a strumenti per la personalizzazione, basi di conoscenza, agenti e guardrail.

L'IA generativa è passata da novità sperimentale a necessità strategica. Secondo recenti dati di settore, 81% di dirigenti sono ora alla guida di iniziative di adozione dell'IA, rispetto alle sole 53% dello scorso anno. Ma l'entusiasmo si scontra con la realtà quando i team devono affrontare i limiti dell'infrastruttura, che 44% delle aziende identificano come il loro ostacolo principale.

Amazon Bedrock è la risposta di AWS a questa sfida. Lanciata nel 2023, è una piattaforma completamente gestita che elimina l'onere dell'infrastruttura dalla creazione di applicazioni di intelligenza artificiale generativa. Invece di fornire server, addestrare modelli o gestire lo scaling, gli sviluppatori accedono ai principali modelli di base attraverso un'API unificata.

E funziona. Amazon Bedrock alimenta l'intelligenza artificiale generativa di oltre 100.000 organizzazioni in tutto il mondo, dalle startup alle aziende globali di ogni settore.

Il servizio centrale: Cosa fa realmente Amazon Bedrock

Amazon Bedrock è un'offerta Platform-as-a-Service (PaaS) che fornisce accesso serverless ai modelli di base. Il servizio elimina le tradizionali barriere all'implementazione dell'intelligenza artificiale: infrastrutture costose, competenze nella formazione dei modelli e complessità di scalabilità.

Il punto è che Bedrock non si occupa di costruire modelli da zero. Si tratta di accedere a modelli pre-addestrati e all'avanguardia e di personalizzarli per le specifiche esigenze aziendali. Gli sviluppatori inviano richieste e generano risposte utilizzando operazioni di inferenza del modello senza mai toccare le configurazioni del server.

La piattaforma supporta diverse modalità. La generazione di testo, la creazione di immagini, le incorporazioni multimodali e la generazione di codice avvengono attraverso la stessa interfaccia unificata. Questa coerenza è importante quando i team devono scambiare i modelli senza riscrivere intere applicazioni.

Architettura completamente gestita e senza server

Bedrock gestisce lo scaling automatico dietro le quinte. Quando il traffico delle applicazioni aumenta, il servizio fornisce capacità aggiuntiva. Quando l'utilizzo diminuisce, le risorse si riducono. Non è necessario alcun intervento manuale.

Questo modello serverless significa che i team pagano solo per l'utilizzo effettivo. Non c'è alcun costo per l'infrastruttura inattiva in attesa di richieste. Secondo la documentazione ufficiale di AWS, il servizio si integra direttamente con altre offerte AWS come S3 e SageMaker attraverso API standard.

Modelli di fondazione: Il vantaggio della selezione del modello

La scelta dei modelli è al centro della proposta di valore di Bedrock. La piattaforma offre l'accesso a centinaia di modelli di base dei principali fornitori di AI e la possibilità di scambiarli senza riscrivere il codice trasforma la selezione dei modelli da vincolo tecnico a vantaggio strategico.

I fornitori attualmente supportati includono Anthropic (modelli Claude), Amazon (serie Nova e Titan), Meta (Llama), Google (Gemma 3), Mistral AI, AI21 Labs (Jamba), OpenAI e Qwen. Ogni fornitore offre punti di forza diversi. Claude 3.5 Sonnet eccelle nei ragionamenti complessi. Nova Premier gestisce compiti multimodali. Titan Embeddings ottimizza la ricerca semantica.

Gli strumenti di valutazione integrati aiutano i team a confrontare le prestazioni, i costi e l'accuratezza dei vari modelli. In questo modo la selezione dei modelli si trasforma da congetture a decisioni basate sui dati.

Struttura dei prezzi: Come funziona Amazon Bedrock

Bedrock utilizza una tariffazione a gettoni con più livelli di servizio. I costi dipendono dallo specifico fornitore del modello, dalla modalità e dal livello di servizio selezionato.

A partire da marzo 2026, la pagina ufficiale dei prezzi mostra diversi livelli:

- Livello standard: Prezzo base per l'inferenza on-demand

- Livello flessibile: Prezzo-prestazioni ottimizzate per casi d'uso specifici

- Livello di priorità: Tariffa standard più premium per un'elaborazione più rapida (fino a 25% migliore latenza)

- Livello riservato: Prezzi basati su impegni per carichi di lavoro prevedibili

L'inferenza in lotti offre uno sconto di 50% rispetto ai prezzi on-demand per alcuni modelli di fondazione. I prezzi sono calcolati per 1 milione di token sia per l'input che per l'output.

| Modello | Ingresso (per 1M di gettoni) | Uscita (per 1M di gettoni) |

|---|---|---|

| Claude Instant 1.2 | $0,0008 per 1K gettoni in ingresso e $0,0024 per 1K gettoni in uscita (o $0,80 e $2,40 per milione di gettoni) | $0,0008 per 1K gettoni in ingresso e $0,0024 per 1K gettoni in uscita (o $0,80 e $2,40 per milione di gettoni) |

| Claude 2.1 | $8.00 | $24.00 |

| Gemma 3 4B | $0.04 | $0.08 |

| Gemma 3 12B | $0.09 | $0.29 |

La pagina ufficiale dei prezzi indica che le tariffe variano a seconda della regione AWS. US East (Virginia), US East (Ohio) e US West (Oregon) offrono in genere i prezzi più competitivi. Le operazioni di lettura e scrittura della cache comportano costi separati per i modelli che supportano la cache immediata.

Capacità chiave che differenziano Bedrock

Basi di conoscenza

Le Knowledge Bases consentono alle applicazioni di collegare i modelli di fondazione a fonti di dati proprietarie. Il servizio gestisce l'intero flusso di lavoro Retrieval-Augmented Generation (RAG): ingestione di documenti da S3, creazione di embeddings vettoriali, archiviazione in database vettoriali e recupero del contesto rilevante per i prompt.

Questa capacità trasforma le risposte generiche dell'IA in risposte basate su dati aziendali specifici, politiche o documentazione tecnica.

Agenti

Gli agenti Bedrock orchestrano attività in più fasi suddividendo le richieste degli utenti, invocando le API ed eseguendo le azioni. Un agente può prenotare appuntamenti, interrogare database ed eseguire calcoli, il tutto attraverso istruzioni in linguaggio naturale.

Gli agenti rappresentano un passaggio dalla semplice risposta alle domande all'esecuzione autonoma dei compiti. Estendono ciò che l'IA generativa può realizzare senza codice di orchestrazione personalizzato.

Guardrail

I guardrail applicano i criteri di sicurezza agli input e agli output del modello. I team configurano i filtri per i contenuti, le restrizioni per gli argomenti e la riduzione delle informazioni sensibili senza modificare il codice dell'applicazione.

Questo è importante per i settori regolamentati. Le applicazioni dei servizi finanziari, sanitari e governativi devono impedire ai modelli di generare contenuti inappropriati o di far trapelare dati protetti. I guardrail forniscono questo livello di controllo.

Personalizzazione del modello

Le funzionalità di messa a punto consentono ai team di adattare i modelli di base utilizzando i propri set di dati. In questo modo si migliorano le prestazioni per i compiti specifici del dominio senza dover addestrare i modelli da zero.

La personalizzazione mantiene il modello serverless. I team caricano i dati di formazione, configurano gli iperparametri e Bedrock gestisce il resto.

Amazon Bedrock contro i concorrenti

Il mercato delle piattaforme di IA generativa è incentrato su tre attori principali: Amazon Bedrock, Azure OpenAI Service e Google Vertex AI. Ognuno di essi adotta un approccio diverso.

Bedrock enfatizza la diversità dei modelli. Azure OpenAI si concentra fortemente sui modelli OpenAI (GPT-4, GPT-3.5) con alternative limitate. Google Vertex AI dà naturalmente la priorità ai modelli di Google, come PaLM e Gemini.

Anche la storia dell'integrazione è diversa. Bedrock si connette in modo nativo ai servizi AWS - S3, Lambda, IAM, CloudWatch. Azure OpenAI si integra con l'ecosistema Microsoft. Vertex AI funziona meglio con Google Cloud Platform.

Le architetture di sicurezza riflettono le filosofie delle piattaforme. Bedrock utilizza endpoint VPC e ruoli IAM senza servizi di gateway aggiuntivi. Le implementazioni di Azure spesso richiedono la gestione delle API (APIM) per l'integrazione VNET, che aggiunge costi orari e di elaborazione dei dati.

Un discorso vero e proprio: Quasi il 74% delle organizzazioni utilizza piattaforme di IA basate sul cloud per ridurre i costi dell'infrastruttura e ottimizzare le risorse. Il lock-in della piattaforma rimane un problema, ma le strategie di IA multi-cloud rimangono complesse.

Applicazioni e casi d'uso reali

Amazon Bedrock supporta diverse applicazioni di IA generativa nei vari settori. I chatbot del servizio clienti utilizzano i modelli Claude per la gestione delle conversazioni. I sistemi di generazione di contenuti sfruttano più modelli per creare testi di marketing, descrizioni di prodotti e documentazione tecnica.

La generazione di codice rappresenta un altro caso d'uso importante. I team di sviluppo utilizzano Bedrock per generare automaticamente codice boilerplate, scrivere test unitari e spiegare basi di codice complesse in linguaggio naturale.

Le applicazioni di elaborazione dei documenti combinano basi di conoscenza con modelli di base per estrarre informazioni da contratti, relazioni finanziarie e documenti legali. L'architettura RAG basa le risposte sul contenuto effettivo del documento piuttosto che sulle allucinazioni del modello.

Secondo AWS, aziende come Robinhood ed Epsilon utilizzano Bedrock per le applicazioni AI di produzione. Il servizio gestisce i carichi di lavoro rivolti ai clienti, dove la latenza e l'affidabilità hanno un impatto diretto sui risultati aziendali.

Scoprite come i dati di Amazon vengono effettivamente utilizzati nella pratica

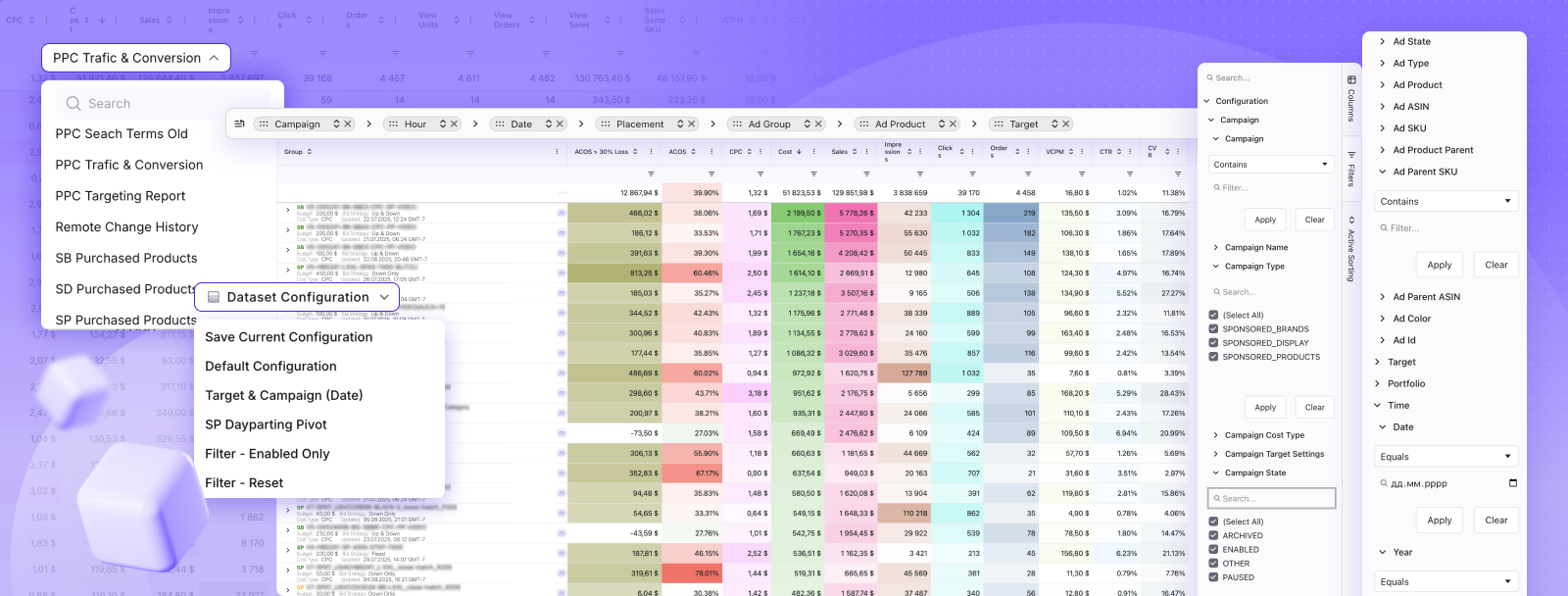

Amazon Bedrock spiega come AWS gestisce dati su larga scala e modelli AI dietro le quinte. Ma per quanto riguarda il mercato, la maggior parte delle decisioni si riduce ancora a dati più semplici: annunci, clic e vendite, e il modo in cui sono collegati. WisePPC funziona con quel livello.

Prende i dati relativi agli annunci e alle vendite di Amazon e li riunisce in un unico posto, in modo da poter vedere le prestazioni senza dover mettere insieme i report. È possibile seguire l'evoluzione delle campagne nel tempo, confrontare i risultati e regolare direttamente le offerte o i budget, il tutto basandosi sullo stesso set di dati anziché su visualizzazioni separate. Esplora WisePPC per vedere come i dati di Amazon vengono utilizzati nelle decisioni quotidiane.

Come iniziare: Primi passi con Bedrock

AWS offre un percorso di avvio rapido per i nuovi utenti di Bedrock. La console offre un'interfaccia web per testare i modelli senza scrivere codice. I team possono inviare richieste, confrontare i risultati dei vari modelli e valutare le prestazioni prima di impegnarsi nell'integrazione API.

Per l'accesso programmatico, l'API Bedrock supporta le librerie SDK AWS standard in diversi linguaggi: Python, JavaScript, Java, Go, C++. L'autenticazione utilizza le credenziali IAM, lo stesso sistema di identità di altri servizi AWS.

L'accesso al modello richiede un'abilitazione esplicita. Non tutti i modelli di fondazione sono disponibili per impostazione predefinita. I team richiedono l'accesso tramite la console Bedrock e AWS fornisce la capacità in base alla disponibilità e alla posizione dell'account.

La documentazione ufficiale include esempi di codice per le operazioni più comuni: invocazione di modelli, streaming di risposte, gestione di conversazioni e implementazione di flussi di lavoro RAG. Questi esempi accelerano lo sviluppo iniziale.

Limitazioni e considerazioni

Amazon Bedrock opera esclusivamente all'interno dell'infrastruttura AWS. I team impegnati in strategie multi-cloud o che hanno già investito in Azure o GCP devono affrontare le sfide della migrazione. Il servizio non offre opzioni di distribuzione portatili.

La disponibilità regionale varia. Non tutti i modelli sono accessibili in tutte le regioni AWS. Le differenze di prezzo tra le regioni possono avere un impatto sulle strategie di ottimizzazione dei costi. I team devono verificare la disponibilità del modello nella regione di distribuzione preferita prima di pianificare l'architettura.

I limiti di capacità del modello si verificano occasionalmente durante i periodi di alta domanda. Il livello di priorità aiuta, ma anche i livelli di servizio premium non possono garantire la disponibilità istantanea durante i picchi di utilizzo estremi. I clienti aziendali a volte attendono settimane per l'approvazione della capacità in regioni specifiche.

Le capacità di regolazione fine esistono, ma non sono all'altezza della profondità della formazione personalizzata su un'infrastruttura dedicata. I team con requisiti altamente specializzati possono incontrare dei limiti nella profondità di personalizzazione dei modelli.

Domande frequenti

A cosa serve esattamente Amazon Bedrock?

Amazon Bedrock è utilizzato per costruire applicazioni di intelligenza artificiale generativa come chatbot, generatori di contenuti, analizzatori di documenti e assistenti al codice senza dover gestire l'infrastruttura.

Quanto costa Amazon Bedrock?

I prezzi sono basati sui token e variano a seconda del modello. I costi dipendono dai token di ingresso/uscita e dal fornitore scelto, con sconti disponibili per l'elaborazione in batch.

Quali modelli sono disponibili in Amazon Bedrock?

Bedrock offre modelli di fornitori come Anthropic, Amazon, Meta, Google, Mistral e altri, la cui disponibilità dipende dalla regione.

Amazon Bedrock è lo stesso di AWS SageMaker?

No, SageMaker si concentra sull'addestramento di modelli personalizzati, mentre Bedrock offre un accesso serverless a modelli pre-addestrati per una distribuzione più rapida.

Amazon Bedrock può lavorare con i miei dati privati?

Sì, può connettersi a fonti di dati private come S3, mantenendo i dati al sicuro all'interno del vostro account AWS.

Quali settori utilizzano Amazon Bedrock?

I settori includono la finanza, la sanità, la vendita al dettaglio, i media, lo sviluppo di software e la pubblica amministrazione.

Amazon Bedrock supporta la messa a punto?

Sì, alcuni modelli supportano la regolazione fine per personalizzare i risultati utilizzando i propri dati.

Pensieri finali

Amazon Bedrock elimina le barriere tradizionali all'adozione dell'intelligenza artificiale generativa. L'architettura serverless, completamente gestita, consente ai team di concentrarsi sulla logica applicativa piuttosto che sulla gestione dell'infrastruttura. L'accesso a centinaia di modelli di fondazione leader del settore attraverso un'API unificata garantisce la flessibilità necessaria per l'evoluzione della tecnologia AI.

Ma la piattaforma vive all'interno di AWS. Le strategie multi-cloud richiedono ulteriori livelli di architettura. Le limitazioni regionali e i vincoli di capacità possono rallentare le implementazioni. I team devono valutare questi compromessi rispetto alla semplicità operativa offerta da Bedrock.

Per le organizzazioni già impegnate nell'infrastruttura AWS, Bedrock offre il percorso più rapido dalla sperimentazione dell'IA alla distribuzione in produzione. La combinazione di diversità dei modelli, sicurezza aziendale e integrazione dei servizi AWS crea una piattaforma convincente per la scalabilità delle applicazioni di IA generativa.

Siete pronti a costruire con l'IA generativa? Iniziate a esplorare Amazon Bedrock attraverso la console AWS, testate modelli per casi d'uso specifici e valutate come la piattaforma si adatta ai flussi di lavoro esistenti. La documentazione ufficiale e le guide di avvio rapido offrono percorsi chiari per l'avvio dei team a qualsiasi livello di esperienza.

Unisciti alla Beta di WisePPC e ottieni vantaggi di accesso esclusivi

WisePPC è ora in fase beta e stiamo invitando un numero limitato di primi utenti a partecipare. In qualità di beta tester, otterrete accesso gratuito, vantaggi a vita e la possibilità di contribuire alla creazione del prodotto - da una Partner verificato di Amazon Ads di cui ci si può fidare.

Non è richiesta la carta di credito

Non è richiesta la carta di credito

Gratuito in beta e gratis per un mese supplementare dopo il rilascio

Gratuito in beta e gratis per un mese supplementare dopo il rilascio

25% a vita - offerta beta limitata

25% a vita - offerta beta limitata

Accesso alle metriche che Amazon Ads non vi mostrerà

Accesso alle metriche che Amazon Ads non vi mostrerà

Partecipate alla creazione del prodotto con il vostro feedback

Partecipate alla creazione del prodotto con il vostro feedback