¿Qué es Amazon Bedrock? Explicación de la plataforma AWS GenAI

Resumen rápido: Amazon Bedrock es un servicio sin servidor totalmente administrado de AWS que permite a los desarrolladores crear y escalar aplicaciones de IA generativa con los principales modelos básicos de proveedores como Anthropic, Meta, Mistral AI y Amazon sin administrar la infraestructura. Proporciona acceso seguro de nivel empresarial a cientos de modelos de IA a través de una API unificada, junto con herramientas de personalización, bases de conocimiento, agentes y guardarraíles.

La IA generativa ha pasado de ser una novedad experimental a una necesidad estratégica. Según datos recientes del sector, 81% de los ejecutivos lideran ahora iniciativas de adopción de IA, frente a sólo 53% el año pasado. Pero el entusiasmo se estrella contra la realidad cuando los equipos se enfrentan a limitaciones de infraestructura, que 44% de las empresas identifican como su principal obstáculo.

Amazon Bedrock surgió como la respuesta de AWS a este desafío. Lanzada en 2023, es una plataforma totalmente administrada que elimina la carga de infraestructura de la creación de aplicaciones de IA generativa. En lugar de aprovisionar servidores, entrenar modelos o administrar el escalado, los desarrolladores obtienen acceso a los principales modelos básicos a través de una API unificada.

Y funciona. Amazon Bedrock impulsa la IA generativa para más de 100 000 organizaciones de todo el mundo, desde startups hasta empresas globales de todos los sectores.

El servicio central: Qué hace realmente Amazon Bedrock

Amazon Bedrock es una oferta de plataforma como servicio (PaaS) que proporciona acceso sin servidor a modelos básicos. El servicio elimina las barreras tradicionales a la implementación de IA: infraestructura costosa, experiencia en la capacitación de modelos y complejidad de escalado.

Pero no se trata de crear modelos desde cero. Se trata de acceder a modelos preentrenados de última generación y personalizarlos para necesidades empresariales específicas. Los desarrolladores envían solicitudes y generan respuestas utilizando operaciones de inferencia de modelos sin tocar nunca las configuraciones del servidor.

La plataforma admite múltiples modalidades. La generación de texto, la creación de imágenes, las incrustaciones multimodales y la generación de código se ejecutan a través de la misma interfaz unificada. Esta coherencia es importante cuando los equipos necesitan intercambiar modelos sin reescribir aplicaciones enteras.

Arquitectura totalmente gestionada y sin servidor

Bedrock gestiona el escalado automático entre bastidores. Cuando el tráfico de la aplicación aumenta, el servicio proporciona capacidad adicional. Cuando el uso disminuye, los recursos se reducen. No se requiere intervención manual.

Este modelo sin servidor significa que los equipos solo pagan por el uso real. No hay ningún coste por infraestructura inactiva esperando solicitudes. Según la documentación oficial de AWS, el servicio se integra directamente con otras ofertas de AWS como S3 y SageMaker a través de API estándar.

Modelos de cimentación: La ventaja de la selección de modelos

La elección del modelo se sitúa en el centro de la propuesta de valor de Bedrock. La plataforma ofrece acceso a cientos de modelos básicos de los principales proveedores de IA, y la posibilidad de intercambiarlos sin reescribir el código transforma la selección de modelos de una limitación técnica en una ventaja estratégica.

Entre los proveedores actuales se encuentran Anthropic (modelos Claude), Amazon (series Nova y Titan), Meta (Llama), Google (Gemma 3), Mistral AI, AI21 Labs (Jamba), OpenAI y Qwen. Cada proveedor aporta puntos fuertes diferentes. Claude 3.5 Sonnet destaca en el razonamiento complejo. Nova Premier se ocupa de tareas multimodales. Titan Embeddings optimiza la búsqueda semántica.

Las herramientas de evaluación integradas ayudan a los equipos a comparar el rendimiento, el coste y la precisión de los distintos modelos. De este modo, la selección del modelo deja de ser una conjetura para convertirse en una toma de decisiones basada en datos.

Estructura de precios: Cómo cobra Amazon Bedrock

Bedrock utiliza precios basados en fichas con varios niveles de servicio. Los costes dependen del modelo de proveedor, la modalidad y el nivel de servicio seleccionados.

A partir de marzo de 2026, la página oficial de precios muestra varios niveles:

- Nivel estándar: Precio base de la inferencia a la carta

- Nivel Flex: Relación calidad-precio optimizada para casos de uso específicos

- Nivel de prioridad: Tarifa estándar más premium para un procesamiento más rápido (hasta 25% de mejor latencia)

- Nivel reservado: Precios basados en compromisos para cargas de trabajo predecibles

La inferencia por lotes ofrece un descuento de 50% en comparación con los precios bajo demanda para determinados modelos de la fundación. El precio se calcula por 1 millón de tokens tanto de entrada como de salida.

| Modelo | Entrada (por 1 millón de fichas) | Producción (por 1 millón de fichas) |

|---|---|---|

| Claude Instant 1.2 | $0,0008 por cada 1.000 fichas de entrada y $0,0024 por cada 1.000 fichas de salida (o $0,80 y $2,40 por cada millón de fichas). | $0,0008 por cada 1.000 fichas de entrada y $0,0024 por cada 1.000 fichas de salida (o $0,80 y $2,40 por cada millón de fichas). |

| Claude 2.1 | $8.00 | $24.00 |

| Gemma 3 4B | $0.04 | $0.08 |

| Gemma 3 12B | $0.09 | $0.29 |

La página oficial de precios señala que las tarifas varían según la región de AWS. Este de EE.UU. (Virginia), este de EE.UU. (Ohio) y oeste de EE.UU. (Oregón) suelen ofrecer los precios más competitivos. Las operaciones de lectura y escritura en caché conllevan cargos independientes para los modelos que admiten el almacenamiento en caché inmediato.

Capacidades clave que diferencian a Bedrock

Bases de conocimiento

Las bases de conocimiento permiten a las aplicaciones conectar modelos fundacionales a fuentes de datos propias. El servicio gestiona todo el flujo de trabajo de recuperación y generación mejorada (RAG): ingestión de documentos desde S3, creación de incrustaciones vectoriales, almacenamiento en bases de datos vectoriales y recuperación del contexto relevante para las solicitudes.

Esta capacidad transforma las respuestas genéricas de la IA en respuestas basadas en datos, políticas o documentación técnica específicos de la empresa.

Agentes

Los agentes Bedrock orquestan tareas de varios pasos desglosando las solicitudes de los usuarios, invocando API y ejecutando acciones. Un agente puede reservar citas, consultar bases de datos y realizar cálculos, todo ello mediante instrucciones en lenguaje natural.

Los agentes representan un cambio de la simple respuesta a preguntas a la ejecución autónoma de tareas. Amplían lo que la IA generativa puede lograr sin código de orquestación personalizado.

Barandillas

Los Guardrails aplican políticas de seguridad a las entradas y salidas del modelo. Los equipos configuran filtros de contenido, restricciones temáticas y eliminación de información sensible sin modificar el código de la aplicación.

Esto es importante para los sectores regulados. Los servicios financieros, la sanidad y las aplicaciones gubernamentales necesitan evitar que los modelos generen contenido inapropiado o filtren datos protegidos. Los Guardrails proporcionan esa capa de control.

Personalización de modelos

Las funciones de ajuste permiten a los equipos adaptar los modelos básicos utilizando sus propios conjuntos de datos. Esto mejora el rendimiento en tareas específicas sin necesidad de entrenar los modelos desde cero.

La personalización mantiene el modelo sin servidor. Los equipos cargan los datos de entrenamiento, configuran los hiperparámetros y Bedrock se encarga del resto.

Amazon Bedrock vs Competidores

El mercado de plataformas de IA generativa se centra en tres actores principales: Amazon Bedrock, Azure OpenAI Service y Google Vertex AI. Cada una adopta un enfoque diferente.

Bedrock hace hincapié en la diversidad de modelos. Azure OpenAI se centra en gran medida en los modelos de OpenAI (GPT-4, GPT-3.5) con alternativas limitadas. Google Vertex AI prioriza naturalmente los modelos propios de Google como PaLM y Gemini.

La historia de la integración también difiere. Bedrock se conecta de forma nativa a los servicios de AWS: S3, Lambda, IAM, CloudWatch. Azure OpenAI se integra con el ecosistema de Microsoft. Vertex AI funciona mejor en Google Cloud Platform.

Las arquitecturas de seguridad reflejan las filosofías de las plataformas. Bedrock utiliza puntos finales de VPC y funciones de IAM sin servicios de puerta de enlace adicionales. Las implementaciones de Azure suelen requerir API Management (APIM) para la integración de VNET, lo que añade costes por hora y tarifas de procesamiento de datos.

Hablando en serio: Casi 74% de las organizaciones utilizan ahora plataformas de IA basadas en la nube para reducir los costes de infraestructura y optimizar los recursos. El bloqueo de plataformas sigue siendo una preocupación, pero las estrategias de IA multicloud siguen siendo complejas.

Aplicaciones reales y casos prácticos

Amazon Bedrock admite diversas aplicaciones de IA generativa en todos los sectores. Los chatbots de atención al cliente utilizan modelos de Claude para gestionar conversaciones con matices. Los sistemas de generación de contenido aprovechan varios modelos para crear textos de marketing, descripciones de productos y documentación técnica.

La generación de código representa otro caso de uso importante. Los equipos de desarrollo utilizan Bedrock para autogenerar código repetitivo, escribir pruebas unitarias y explicar bases de código complejas en lenguaje natural.

Las aplicaciones de tratamiento de documentos combinan bases de conocimiento con modelos de fundamentos para extraer información de contratos, informes financieros y documentos jurídicos. La arquitectura RAG basa las respuestas en el contenido real de los documentos y no en alucinaciones de modelos.

Según AWS, empresas como Robinhood y Epsilon utilizan Bedrock para aplicaciones de IA de producción. El servicio gestiona cargas de trabajo orientadas al cliente en las que la latencia y la fiabilidad afectan directamente a los resultados empresariales.

Vea cómo se utilizan realmente los datos de Amazon en la práctica

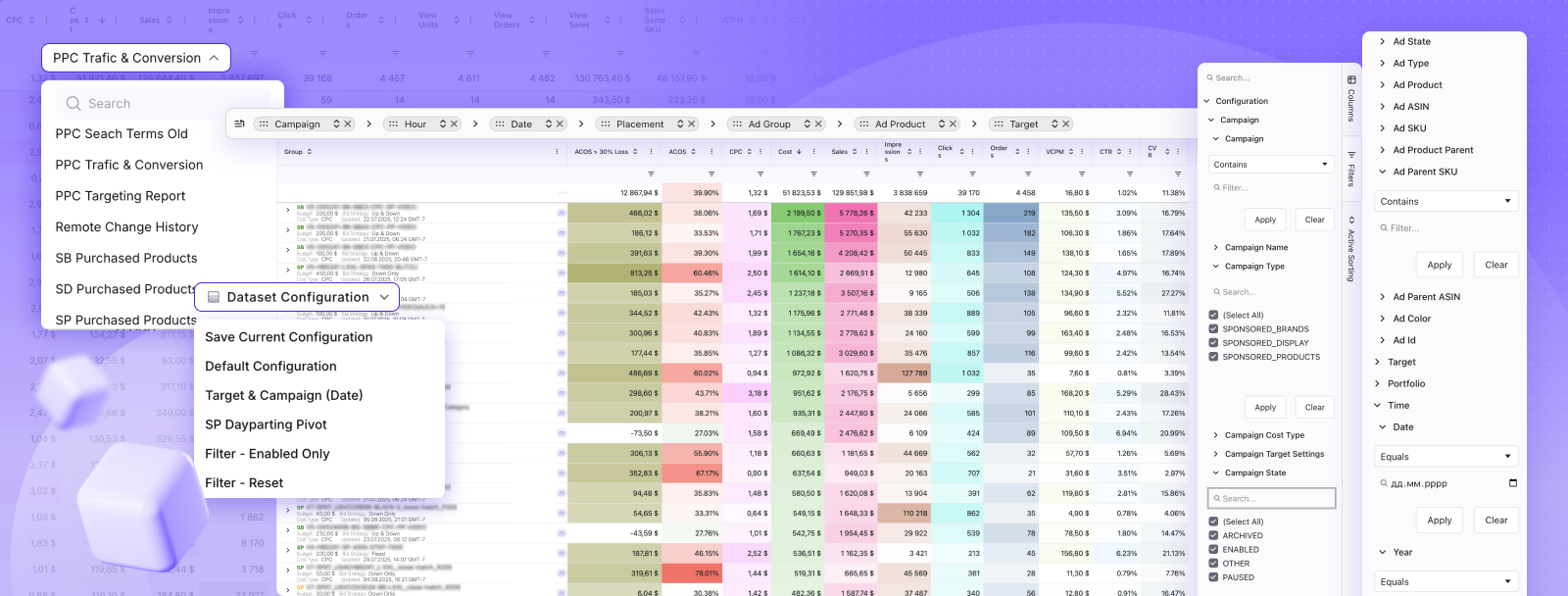

Amazon Bedrock explica cómo AWS gestiona datos a gran escala y modelos de IA entre bastidores. Pero en el mercado, la mayoría de las decisiones siguen reduciéndose a datos más sencillos: anuncios, clics y ventas, y cómo se conectan. WisePPC funciona con esa capa.

Toma los datos de los anuncios y las ventas de Amazon y los reúne en un solo lugar para que pueda ver el rendimiento sin tener que juntar informes. Puede seguir cómo cambian las campañas a lo largo del tiempo, comparar resultados y ajustar ofertas o presupuestos directamente, todo ello basado en el mismo conjunto de datos en lugar de en vistas separadas. Explorar WisePPC para ver cómo se utilizan los datos de Amazon en las decisiones cotidianas.

Primeros pasos: Primeros pasos con Bedrock

AWS proporciona una ruta de inicio rápido para los nuevos usuarios de Bedrock. La consola ofrece una interfaz web para probar modelos sin escribir código. Los equipos pueden enviar solicitudes, comparar resultados entre modelos y evaluar el desempeño antes de comprometerse con la integración de la API.

Para el acceso programático, la API de Bedrock admite las bibliotecas estándar del SDK de AWS en varios lenguajes: Python, JavaScript, Java, Go y C++. La autenticación utiliza credenciales de IAM, el mismo sistema de identidad que otros servicios de AWS.

El acceso a los modelos requiere una habilitación explícita. No todos los modelos de cimientos están disponibles de forma predeterminada. Los equipos solicitan el acceso a través de la consola de Bedrock y AWS proporciona la capacidad en función de la disponibilidad y el estado de la cuenta.

La documentación oficial incluye ejemplos de código para operaciones comunes: invocación de modelos, transmisión de respuestas, gestión de conversaciones e implementación de flujos de trabajo RAG. Estos ejemplos aceleran el desarrollo inicial.

Limitaciones y consideraciones

Amazon Bedrock opera exclusivamente dentro de la infraestructura de AWS. Los equipos comprometidos con estrategias multicloud o que ya han invertido en Azure o GCP se enfrentan a problemas de migración. El servicio no ofrece opciones de despliegue portátiles.

La disponibilidad regional varía. No todos los modelos son accesibles en todas las regiones de AWS. Las diferencias de precios entre regiones pueden afectar a las estrategias de optimización de costes. Los equipos deben verificar la disponibilidad del modelo en su región de implementación preferida antes de planificar la arquitectura.

Las limitaciones de capacidad del modelo ocurren ocasionalmente durante periodos de alta demanda. El nivel de prioridad ayuda, pero ni siquiera los niveles de servicio premium pueden garantizar la disponibilidad instantánea durante picos de uso extremos. A veces, los clientes empresariales esperan semanas a que se apruebe su capacidad en determinadas regiones.

Existen funciones de ajuste fino, pero no igualan la profundidad de la formación personalizada en infraestructuras dedicadas. Los equipos con requisitos muy especializados pueden toparse con limitaciones en la profundidad de la personalización de modelos.

Preguntas frecuentes

¿Para qué sirve exactamente Amazon Bedrock?

Amazon Bedrock se utiliza para crear aplicaciones de IA generativa como chatbots, generadores de contenido, analizadores de documentos y asistentes de código sin necesidad de administrar la infraestructura.

¿Cuánto cuesta Amazon Bedrock?

Los precios se basan en fichas y varían según el modelo. Los costes dependen de los tokens de entrada/salida y del proveedor elegido, con descuentos disponibles para el procesamiento por lotes.

¿Qué modelos están disponibles en Amazon Bedrock?

Bedrock ofrece modelos de proveedores como Anthropic, Amazon, Meta, Google, Mistral y otros, con disponibilidad según la región.

¿Es Amazon Bedrock lo mismo que AWS SageMaker?

No, SageMaker se centra en el entrenamiento de modelos personalizados, mientras que Bedrock proporciona acceso sin servidor a modelos preentrenados para un despliegue más rápido.

¿Puede Amazon Bedrock trabajar con mis datos privados?

Sí, puede conectarse a fuentes de datos privadas como S3 mientras mantiene los datos seguros dentro de su cuenta de AWS.

¿Qué sectores utilizan Amazon Bedrock?

Entre los sectores figuran las finanzas, la sanidad, el comercio minorista, los medios de comunicación, el desarrollo de software y la administración pública.

¿Admite Amazon Bedrock el ajuste fino?

Sí, algunos modelos admiten un ajuste fino para personalizar los resultados utilizando sus propios datos.

Reflexiones finales

Amazon Bedrock elimina las barreras tradicionales para la adopción de IA generativa. La arquitectura sin servidor totalmente administrada permite a los equipos centrarse en la lógica de la aplicación en lugar de en la administración de la infraestructura. El acceso a cientos de modelos básicos líderes a través de una API unificada proporciona flexibilidad a medida que evoluciona la tecnología de IA.

Pero la plataforma vive dentro de AWS. Las estrategias multicloud requieren capas de arquitectura adicionales. Las limitaciones regionales y las restricciones de capacidad pueden ralentizar las implementaciones. Los equipos deben evaluar estas ventajas y desventajas frente a la simplicidad operativa que ofrece Bedrock.

Para las organizaciones ya comprometidas con la infraestructura de AWS, Bedrock ofrece la ruta más rápida desde la experimentación de IA hasta la implementación de producción. La combinación de diversidad de modelos, seguridad empresarial e integración de servicios de AWS crea una plataforma convincente para escalar aplicaciones de IA generativa.

¿Está listo para crear con IA generativa? Comience a explorar Amazon Bedrock a través de la consola de AWS, pruebe modelos para casos de uso específicos y evalúe cómo la plataforma se adapta a los flujos de trabajo existentes. La documentación oficial y las guías de inicio rápido proporcionan rutas de incorporación claras para equipos de cualquier nivel de experiencia.

Únase a la beta de WisePPC y obtenga ventajas de acceso exclusivas

WisePPC ya está en fase beta, y estamos invitando a un número limitado de primeros usuarios a unirse. Como probador de la versión beta, obtendrá acceso gratuito, ventajas de por vida y la oportunidad de ayudar a dar forma al producto. Socio verificado de Amazon Ads de confianza.

No se necesita tarjeta de crédito

No se necesita tarjeta de crédito

Gratis en beta y un mes más gratis tras el lanzamiento

Gratis en beta y un mes más gratis tras el lanzamiento

25% de descuento de por vida - oferta beta limitada

25% de descuento de por vida - oferta beta limitada

Acceda a las métricas que Amazon Ads no le muestra

Acceda a las métricas que Amazon Ads no le muestra

Participe en la creación del producto con sus comentarios

Participe en la creación del producto con sus comentarios