Jak testować produkty A/B we właściwy sposób?

Testy A/B na początku brzmią technicznie, ale w gruncie rzeczy jest to po prostu sposób, aby przestać zgadywać i zacząć uczyć się na podstawie rzeczywistych zachowań klientów. Zamiast zmieniać coś i mieć nadzieję, że zadziała, porównujesz dwie wersje i pozwalasz danym powiedzieć, co faktycznie poprawia wydajność. Czasami różnica jest oczywista. Innym razem wyniki są zaskakujące i to właśnie w nich kryje się prawdziwa wiedza.

Dla zespołów produktowych i sprzedawców testowanie staje się mniej związane z pogonią za szybkimi zwycięstwami, a bardziej z budowaniem zaufania do podejmowanych decyzji. Niewielka zmiana w obrazie, tytule lub wiadomości może zmienić reakcję ludzi, ale bez testowania jest prawie niemożliwe, aby dowiedzieć się dlaczego. Ustrukturyzowane podejście do testów A/B pomaga zmniejszyć ryzyko, odkryć wzorce zachowań klientów i stopniowo poprawiać wyniki w czasie bez zakłócania tego, co już działa.

Co testy A/B naprawdę oznaczają w praktyce

W codziennej pracy testowanie A/B jest mniej skomplikowane niż się wydaje. Najprościej rzecz ujmując, jest to kontrolowany eksperyment mający odpowiedzieć na jedno pytanie: która wersja działa lepiej dla prawdziwych użytkowników. Zamiast zmieniać coś dla wszystkich naraz, tworzysz dwie wersje tego samego elementu i dzielisz odbiorców między nimi. Jedna grupa widzi oryginalną wersję, często nazywaną kontrolą, podczas gdy druga widzi zmodyfikowaną wersję, znaną jako wariant. Wszystko inne pozostaje bez zmian, aby można było wyraźnie zaobserwować wpływ pojedynczej zmiany.

To, co czyni to podejście niezawodnym, to usunięcie opinii z procesu. Zespoły często podejmują decyzje w oparciu o doświadczenie, preferencje lub wewnętrzne dyskusje, ale klienci nie zawsze reagują w sposób, jakiego oczekujemy. Obraz produktu, który dla projektanta wygląda czyściej, może wydawać się mniej wiarygodny dla kupującego. Krótszy opis może wydawać się łatwiejszy do przeczytania, ale pozostawia ważne pytania bez odpowiedzi. Testy A/B zastępują założenia obserwowalnym zachowaniem. Użytkownicy głosują poprzez swoje działania, a nie opinie.

Innym ważnym szczegółem jest to, że w testach A/B nie chodzi o odgadnięcie zwycięzcy z wyprzedzeniem. Chodzi o stworzenie uczciwego porównania. Ruch jest zwykle dzielony losowo, tak aby każda wersja była narażona na podobne typy użytkowników. Z czasem pojawiają się wzorce. Jeśli jedna wersja konsekwentnie prowadzi do większej liczby kliknięć, zakupów lub zaangażowania, różnica jest mało prawdopodobna. Jest to moment, w którym zespoły mogą wprowadzać zmiany z ufnością, a nie nadzieją.

Dlaczego testy A/B produktów mają większe znaczenie niż kiedykolwiek wcześniej?

Produkty nie konkurują już tylko funkcjami lub ceną. Konkurują przejrzystością, zaufaniem i tym, jak szybko użytkownicy rozumieją wartość. W środowisku, w którym uwaga klientów jest krótka, a oczekiwania stale się zmieniają, niewielkie ulepszenia mogą mieć zauważalne znaczenie, dlatego właśnie testowanie strukturalne stało się niezbędne, a nie opcjonalne.

Zmieniające się środowiska cyfrowe wymagają ciągłej weryfikacji

Środowiska cyfrowe nie stoją w miejscu. Oczekiwania klientów szybko się zmieniają, konkurenci dostosowują się, a platformy ewoluują. Strona produktu, która działała dobrze w zeszłym roku, może po cichu stracić skuteczność, czego nikt nie zauważy. Niewielkie spadki potęgują się z czasem, a wydajność rzadko spada od razu. Częściej zanika stopniowo wraz ze zmianą oczekiwań użytkowników. Testy A/B pomagają wykryć i skorygować te powolne zmiany, zanim staną się większymi problemami.

Testy A/B zapobiegają stagnacji i zachęcają do postępu

Testy A/B stanowią zabezpieczenie przed stagnacją. Zamiast czekać na spadki wydajności, zespoły aktywnie badają ulepszenia poprzez kontrolowane eksperymenty. Takie proaktywne podejście tworzy dynamikę, ponieważ optymalizacja staje się częścią regularnej pracy, a nie sporadycznym wysiłkiem związanym z przeprojektowaniem. Nawet niewielkie korzyści mają znaczenie. Gdy małe ulepszenia są konsekwentnie stosowane w obrazach produktów, komunikatach, układzie lub prezentacji cen, skumulowany efekt może być znaczący w czasie.

Dane zmniejszają tarcia w zespołowym podejmowaniu decyzji

Istnieje również psychologiczna korzyść wewnątrz zespołów, która często pozostaje niezauważona. Testowanie zmniejsza tarcia przy podejmowaniu decyzji. Dyskusje odchodzą od osobistych upodobań w kierunku wymiernych rezultatów. Gdy dane zastępują debatę, postęp ma tendencję do przyspieszania, ponieważ decyzje nie zależą już od hierarchii lub opinii. Zespoły spędzają mniej czasu na kłótniach o kierunek, a więcej na udoskonalaniu tego, co faktycznie działa dla użytkowników.

Co należy przetestować w pierwszej kolejności

Kiedy ludzie po raz pierwszy odkrywają testy A/B, często pojawia się pokusa, aby przetestować wszystko naraz. Kolory, czcionki, układy, wiadomości, obrazy. Rezultatem jest zwykle szum, a nie wgląd. Priorytetyzacja ma większe znaczenie niż ilość eksperymentów.

Dobrym punktem wyjścia jest przyjrzenie się momentom, w których klienci podejmują decyzje. Są to punkty, w których niepewność lub wahanie mogą zatrzymać postęp. Im bliżej tego momentu decyzyjnego znajduje się dany element, tym wyższa jest jego wartość testowa.

Elementy o dużym wpływie do rozważenia

- Główne obrazy produktów lub wizualizacje bohaterów

- Nazwy produktów i propozycje wartości

- Prezentacja cen lub rabatów

- Sformułowanie lub umieszczenie wezwania do działania

- Opisy kluczowych korzyści

- Dowód społeczny, taki jak recenzje lub referencje

Elementy te kształtują pierwsze wrażenie i wpływają na zaufanie. Wizualny poler ma znaczenie, ale przejrzystość ma większe znaczenie. Klienci muszą zrozumieć, czym jest produkt, dlaczego jest ważny i co robić dalej. Testowanie pomaga udoskonalić tę ścieżkę.

WisePPC: Zaawansowana analityka do prowadzenia strategii testowania A/B produktu

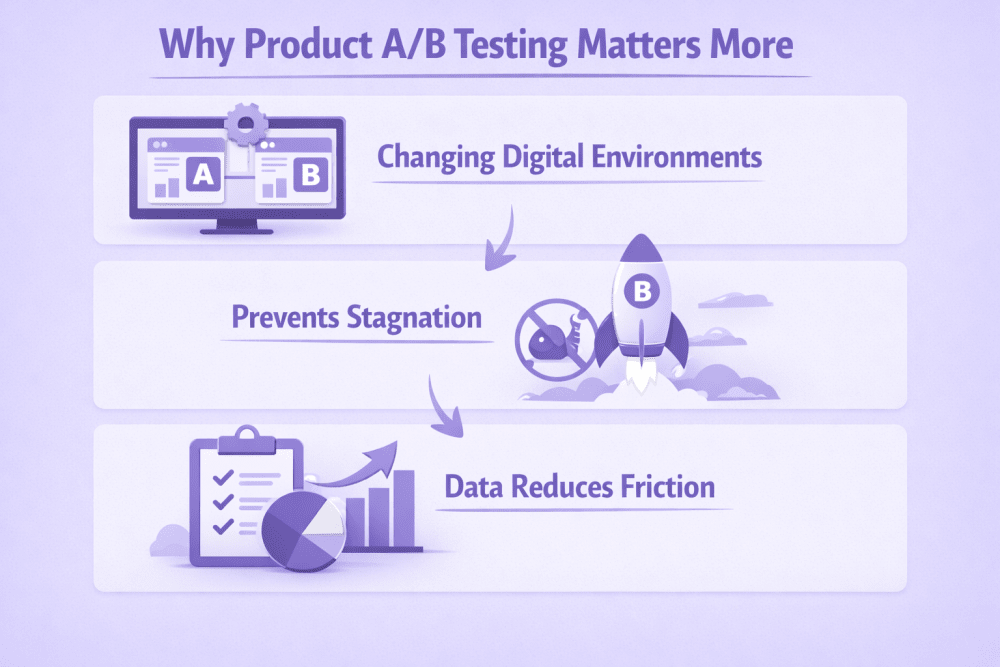

Przy WisePPC, Testy A/B postrzegamy jako naturalne rozszerzenie analityki. Testowanie działa tylko wtedy, gdy jasno rozumiesz, co dzieje się przed i po zmianie. Dlatego nasza platforma koncentruje się na zapewnieniu sprzedawcom pełnego wglądu zarówno w wyniki reklamowe, jak i sprzedażowe w jednym miejscu. Kiedy przeprowadzasz eksperymenty dotyczące ofert produktów, cen lub struktury kampanii, musisz zobaczyć, jak te zmiany wpływają na rzeczywiste wyniki, a nie tylko na wskaźniki powierzchniowe. Łącząc dane historyczne, śledzenie wyników w czasie rzeczywistym i szczegółową segmentację, pomagamy określić, czy dana zmiana rzeczywiście poprawia wyniki, czy tylko tymczasowo zmienia liczby.

W praktyce oznacza to, że umożliwiamy zespołom porównywanie wyników w różnych kampaniach, miejscach docelowych i okresach bez utraty kontekstu. Długoterminowe dane historyczne pomagają uniknąć typowych błędów w testowaniu, takich jak zbyt wczesne ocenianie wyników lub pomijanie wzorców sezonowych. Szczegółowa analiza i filtrowanie ułatwiają wyodrębnienie tego, co się zmieniło i dlaczego, a działania zbiorcze umożliwiają szybkie dostosowanie po zidentyfikowaniu zwycięskiej wersji. Zamiast zgadywać, która wersja działa lepiej, skupiamy się na pomaganiu sprzedawcom w łączeniu decyzji testowych z wymiernym wpływem na biznes, niezależnie od tego, czy jest to poprawa ROAS, zmniejszenie zmarnowanych wydatków na reklamę, czy też lepsze zrozumienie tego, co faktycznie napędza konwersje.

Jak przeprowadzić test A/B bez zgadywania?

Testy A/B działają najlepiej, gdy przebiegają według jasnej sekwencji. Wiele zespołów od razu przechodzi do tworzenia wariantów, ponieważ wydaje się to postępem. W rzeczywistości większość nieudanych testów ma miejsce jeszcze przed rozpoczęciem eksperymentu. Różnica między użytecznymi wynikami a mylącymi danymi zwykle sprowadza się do przygotowania, jasności i cierpliwości.

Ta sekcja przedstawia cały proces w praktyczny sposób. Każdy krok opiera się na poprzednim, więc pomijanie kolejnych często stwarza później więcej problemów.

Krok 1 - Zdefiniuj, co właściwie oznacza sukces

Przed zmianą czegokolwiek ważne jest, aby zrozumieć, dlaczego test w ogóle istnieje. Testy A/B bez jasnego celu zamieniają się w działania bez kierunku. Możesz skończyć z danymi, ale bez prawdziwej odpowiedzi.

Silny cel testowania łączy się bezpośrednio z zachowaniem użytkownika. Zamiast niejasnych intencji, takich jak poprawa wydajności, cel powinien opisywać konkretny wynik, na który chcesz wpłynąć. Na przykład, więcej sfinalizowanych zakupów, większe zaangażowanie w szczegóły produktu lub mniej użytkowników porzucających stronę przed jej zamknięciem.

Na co zwykle odpowiada jasny cel

- Jakie działania użytkownika staramy się poprawić?

- Na którym etapie podróży występuje problem

- Jak mierzony będzie sukces?

Gdy cele są jasne, późniejsza analiza staje się prostsza. Wiesz już, który wskaźnik jest najważniejszy i dlaczego go mierzysz.

Przykłady celów testów ukierunkowanych

- Zwiększenie wskaźnika zakupu produktu poprzez poprawę przejrzystości produktu

- Poprawa współczynnika klikalności głównego wezwania do działania

- Zmniejszenie liczby porzuceń koszyka podczas realizacji zakupu

- Zwiększenie zaangażowania dzięki kluczowym informacjom o produkcie

Im jaśniejszy cel, tym łatwiejsze staje się zaprojektowanie sensownego testu.

Krok 2 - Przekształcenie obserwacji w testowalną hipotezę

Po zdefiniowaniu celu, kolejnym krokiem jest wyjaśnienie, dlaczego zmiana może w ogóle zadziałać. W tym miejscu wiele testów albo nabiera znaczenia, albo zamienia się w przypadkowe eksperymenty. Hipoteza nadaje testowi kierunek. Łączy to, co widzisz w danych, z konkretną zmianą, która Twoim zdaniem może poprawić wynik.

Hipoteza nie jest domysłem ani kreatywnym pomysłem. Jest to ustrukturyzowane założenie oparte na obserwacji. Coś w obecnym doświadczeniu nie działa zgodnie z oczekiwaniami, a hipoteza wyjaśnia, co może powodować to tarcie. Na przykład, jeśli użytkownicy konsekwentnie opuszczają stronę produktu w ciągu kilku sekund, problemem może nie być cena lub projekt. Problemem może być po prostu to, że odwiedzający nie rozumieją od razu, dlaczego produkt jest dla nich ważny. W takim przypadku można postawić hipotezę, że poprawa jasności nagłówka lub wiadomości otwierającej pomoże użytkownikom pozostać dłużej i zaangażować się głębiej.

Najbardziej przydatne hipotezy zwykle pochodzą z wzorców, a nie opinii. Opinie klientów często ujawniają nieporozumienia lub brakujące informacje. Pytania pomocnicze podkreślają obszary, w których oczekiwania nie pokrywają się z rzeczywistością. Analityka może pokazać, gdzie użytkownicy wahają się lub całkowicie porzucają proces. Nawet porównanie produktów o wysokiej wydajności ze słabszymi może ujawnić różnice w przekazie lub prezentacji, które warto przetestować. Sygnały te pomagają przekształcić testowanie w rozwiązywanie problemów zamiast eksperymentowania dla samego eksperymentowania. Utrzymanie hipotezy w centrum uwagi jest ważne. Każdy test powinien mieć na celu udzielenie odpowiedzi na jedno istotne pytanie. Gdy zakres pozostaje wąski, wyniki stają się łatwiejsze do zinterpretowania, a uzyskane spostrzeżenia można z pewnością zastosować do przyszłych ulepszeń.

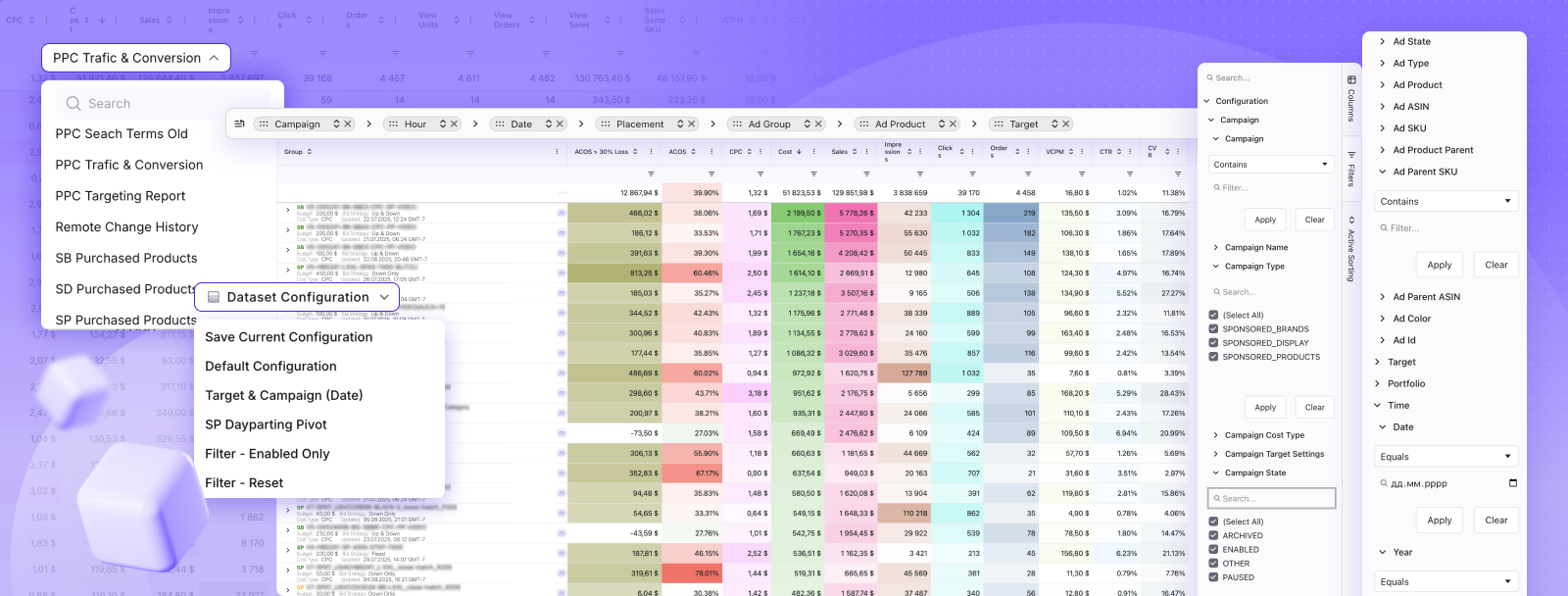

Krok 3 - Tworzenie wariantów, które izolują zmianę

Jest to etap, na którym wiele testów A/B po cichu traci swoją wartość. Kiedy kilka ulepszeń wydaje się oczywistych, naturalnym instynktem jest aktualizacja wszystkiego naraz. Nowy obraz, przeredagowany tekst, dostosowany układ, a może nawet zmiany cen. Problem polega na tym, że gdy wiele elementów zmienia się razem, wyniki przestają być jasne. Jeśli wydajność ulegnie poprawie, nie można z całą pewnością wyjaśnić, dlaczego tak się stało.

Dobrze skonstruowany test A/B jest celowo prosty. Celem nie jest przeprojektowanie całego doświadczenia, ale wyizolowanie jednej znaczącej różnicy między dwiema wersjami. Gdy zmienia się tylko jedna zmienna, widoczna staje się przyczyna i skutek. Wynik staje się użyteczną wiedzą, a nie szczęśliwym rezultatem.

Wersja kontrolna - bieżąca strona lub lista produktów

Wersja kontrolna to istniejąca wersja, którą użytkownicy już widzą. Służy ona jako punkt odniesienia do porównań, ponieważ jej wydajność jest już znana. Nic nie jest tutaj zmieniane. Pozostawienie wersji kontrolnej nietkniętej gwarantuje, że wszelkie różnice w wydajności wynikają z nowej odmiany, a nie z czynników zewnętrznych.

Wersja wariantowa - identyczna z wyjątkiem jednej zamierzonej zmiany

Wersja wariantowa wprowadza pojedynczą, celową korektę opartą na hipotezie. Może to być inny obraz produktu, zmienione sformułowanie nagłówka lub nowe umiejscowienie dowodu społecznego. Wszystko inne pozostaje bez zmian, więc wpływ tej jednej zmiany można dokładnie zmierzyć. Utrzymanie tej spójności chroni integralność testu i ułatwia interpretację wyników.

Gdy warianty są tworzone w ten sposób, uzyskany wgląd staje się wielokrotnego użytku. Udana zmiana może być często stosowana w innych produktach lub stronach, ponieważ rozumiesz, co wpłynęło na zachowanie użytkowników, a nie tylko na wzrost wydajności.

Krok 4 - Pozwól testowi działać wystarczająco długo, aby był wiarygodny

Jedną z najtrudniejszych części testów A/B jest czekanie. Wczesne dane często wyglądają przekonująco, zwłaszcza gdy jedna wersja zaczyna szybko przewyższać drugą. Niestety, wczesne trendy są często tymczasowe.

Zachowanie użytkowników zmienia się w zależności od czasu, źródeł ruchu, a nawet dnia tygodnia. Wersja, która działa dobrze w krótkim okresie, może nie działać w ten sam sposób przez dłuższy czas.

Powody, dla których testy wymagają czasu:

- Zachowanie w dni powszednie i weekendy różni się

- Nowi i powracający użytkownicy zachowują się inaczej

- Ruch w kampanii ulega wahaniom

- Losowa zmienność może powodować krótkoterminowe skoki

Zbyt wczesne zakończenie testu wiąże się z ryzykiem. Decyzja podjęta na podstawie niekompletnych danych może zablokować słabszą wersję i cofnąć wcześniejsze ulepszenia. Cierpliwość chroni przed tym.

Krok 5 - Wyjdź poza pojedynczy wskaźnik

Naturalne jest skupienie się na podstawowej metryce związanej z celem. Jednak rzeczywista wydajność rzadko jest jednowymiarowa. Ulepszenia w jednym obszarze mogą powodować nieoczekiwane kompromisy w innych obszarach.

Na przykład, bardziej agresywna wiadomość może zwiększyć liczbę kliknięć, jednocześnie obniżając jakość zakupu. Zaangażowanie rośnie, ale długoterminowa wartość spada. Spojrzenie na wskaźniki pomocnicze pomaga ujawnić te sytuacje przed wprowadzeniem zmian na szeroką skalę.

Wskaźniki, które warto analizować wraz z głównym celem

- Współczynnik konwersji

- Przychód na odwiedzającego

- Zachowanie podczas dodawania do koszyka

- Czas spędzony na stronie

- Współczynnik odrzuceń lub wyjść

- Wskaźniki jakości klienta

Zrównoważona analiza uwzględnia zarówno sygnały zaangażowania, jak i wyniki biznesowe. Najlepiej działającą wersją nie zawsze jest ta z największą liczbą kliknięć. Jest to ta, która wspiera zrównoważone wyniki.

Typowe błędy w testach A/B, których należy unikać

Większość problemów z testami A/B nie wynika ze złych intencji lub braku wysiłku. Zazwyczaj pojawiają się one, gdy zespoły działają zbyt szybko lub próbują wymusić wnioski, zanim dane są gotowe. Na pierwszy rzut oka testowanie wydaje się proste, ale drobne błędy w konfiguracji lub interpretacji mogą prowadzić do decyzji, które po cichu szkodzą wydajności, zamiast ją poprawiać. Zrozumienie, gdzie zazwyczaj pojawiają się błędy, pomaga utrzymać użyteczność i niezawodność eksperymentów.

Testowanie zbyt wielu zmian jednocześnie

Jest to prawdopodobnie najczęstszy problem, zwłaszcza gdy zespoły chcą szybko poprawić wyniki. Kilka elementów wygląda słabo, więc wszystko jest aktualizowane w tym samym czasie. Strona wygląda lepiej, wydajność się zmienia i wszyscy zakładają, że test zadziałał. Problem polega na tym, że nikt nie wie, która zmiana faktycznie spowodowała różnicę.

Gdy wiele zmiennych porusza się razem, wynik staje się niemożliwy do wyciągnięcia. Możesz przypadkowo zachować zmiany, które pogorszyły wydajność, jednocześnie usuwając te, które pomogły. Z czasem prowadzi to do niespójnych wyników i utrudnia przyszłe testy.

Testy A/B działają najlepiej, gdy każdy eksperyment odpowiada na jedno jasne pytanie. Jedna zmiana, jedno porównanie, jeden wniosek.

Zbyt wczesne zakończenie testów

Wczesne dane mogą być przekonujące. Wariant wykazuje poprawę po kilku dniach i pokusa ogłoszenia zwycięzcy staje się silna. Problem polega na tym, że wczesne wyniki są często niestabilne. Wzorce ruchu zmieniają się w ciągu tygodnia, kampanie ulegają zmianie, a zachowanie użytkowników różni się w zależności od czasu.

Zbyt wczesne przerwanie testu zwiększa szansę na wybranie fałszywego zwycięzcy. To, co wygląda na poprawę, może być po prostu krótkotrwałą fluktuacją. Pozostawienie wystarczającej ilości czasu na normalizację zachowania pomaga zapewnić, że wynik odzwierciedla rzeczywistą wydajność, a nie zbieg okoliczności.

Cierpliwość nie jest tutaj czasem straconym. Chroni przed wprowadzaniem zmian, które później trzeba cofnąć.

Optymalizacja pod kątem niewłaściwej metryki

Nie każde ulepszenie jest w rzeczywistości ulepszeniem. Czasami test zwiększa aktywność bez poprawy wyników, które mają znaczenie dla firmy. Na przykład bardziej agresywna wiadomość może zwiększyć liczbę kliknięć, przyciągając jednocześnie mniej poważnych kupujących, co prowadzi do niższych ogólnych przychodów lub retencji.

Zwykle dzieje się tak, gdy zespoły koncentrują się na łatwych wskaźnikach zamiast na tych znaczących. Wskaźniki powinny zawsze łączyć się z rzeczywistym celem produktu lub kampanii.

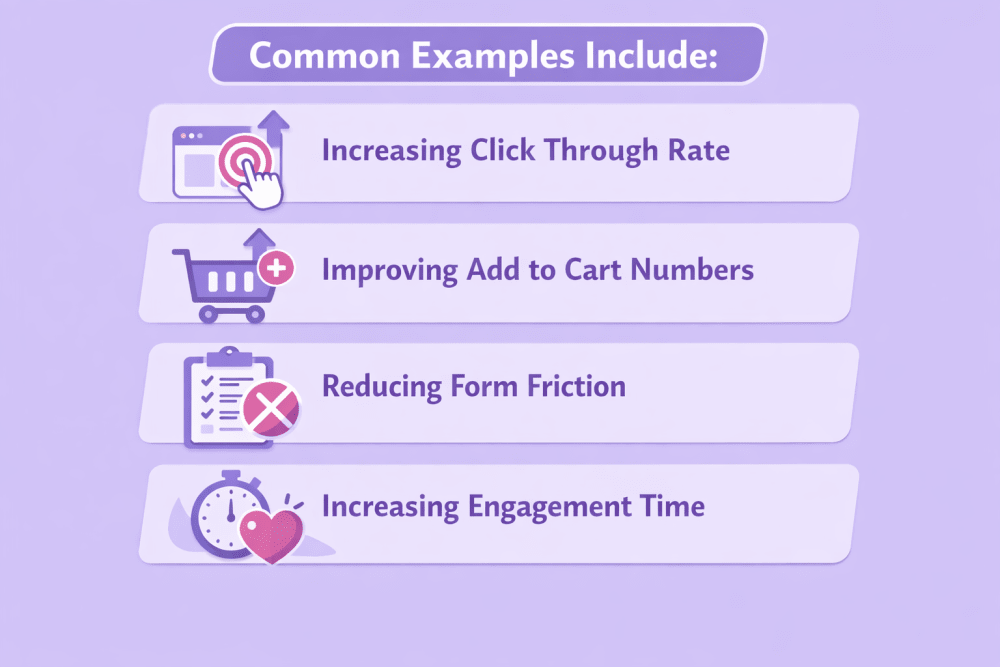

Typowe przykłady obejmują:

- Zwiększenie współczynnika klikalności przy jednoczesnym spadku współczynnika zakupów

- Poprawa liczby dodań do koszyka bez poprawy liczby zrealizowanych zamówień

- Zmniejszenie tarcia formularza, ale obniżenie jakości leadów

- Wydłużenie czasu zaangażowania bez zwiększania liczby konwersji

Spojrzenie na wskaźniki pomocnicze obok głównego celu pomaga zapobiegać takim sytuacjom.

Zakładanie, że jeden wynik pasuje do każdego odbiorcy

Innym częstym błędem jest zakładanie, że jedna zwycięska wersja działa równie dobrze dla wszystkich. W rzeczywistości różne segmenty odbiorców często zachowują się inaczej. Nowi odwiedzający mogą potrzebować więcej wyjaśnień, podczas gdy powracający klienci wolą szybkość i znajomość. Użytkownicy mobilni mogą reagować inaczej niż użytkownicy komputerów stacjonarnych.

Ignorowanie tych różnic może ukryć cenne spostrzeżenia. Czasami przegrywający wariant ogólnie działa wyjątkowo dobrze w określonym segmencie. Rozpoznanie tych wzorców może prowadzić do bardziej ukierunkowanych ulepszeń zamiast jednej uniwersalnej zmiany.

Wnioski

Testy A/B są często opisywane jako taktyka, ale w praktyce stają się sposobem myślenia o doskonaleniu. Zamiast wprowadzać zmiany w oparciu o instynkt lub wewnętrzną debatę, dajesz prawdziwym użytkownikom głos w podejmowaniu decyzji. Czasami wyniki potwierdzają to, czego się spodziewałeś. Innym razem podważają założenia, z których nawet nie zdawałeś sobie sprawy. Oba wyniki posuwają produkt do przodu.

Najważniejsza jest spójność. Jeden test nie zmieni wydajności z dnia na dzień i jest to całkowicie normalne. Prawdziwa wartość pojawia się z czasem, w miarę gromadzenia się drobnych spostrzeżeń. Zaczynasz rozumieć, jak klienci interpretują Twoje komunikaty, co buduje zaufanie i gdzie pojawiają się tarcia w procesie zakupu. Decyzje stają się spokojniejsze, zmiany bezpieczniejsze, a postępy bardziej przewidywalne.

Jeśli jest jedna rzecz, o której warto pamiętać, to fakt, że w testowaniu nie chodzi o dążenie do perfekcji. Produkty ewoluują, odbiorcy się zmieniają i zawsze pojawiają się nowe pomysły. Testy A/B dają po prostu niezawodny sposób na dostosowanie się bez zgadywania. Zacznij od jasnego pytania, przetestuj je uczciwie i pozwól wynikom poprowadzić następny krok.

FAQ

Jak długo powinien trwać test A/B przed wybraniem zwycięzcy?

Nie ma uniwersalnego harmonogramu, ponieważ zależy on od natężenia ruchu i liczby wygenerowanych konwersji. Ogólnie rzecz biorąc, test powinien trwać wystarczająco długo, aby uchwycić normalne zachowanie użytkowników w różnych dniach i wzorcach ruchu. Zbyt wczesne zakończenie testu często prowadzi do mylących wniosków, więc lepiej poczekać, aż wyniki się ustabilizują, niż reagować na wczesne trendy.

Czy małe zmiany naprawdę mogą coś zmienić w testach A/B?

Tak, i to właśnie tutaj często pojawiają się zaskakujące ulepszenia. Inny obraz, wyraźniejszy nagłówek lub lepsze rozmieszczenie kluczowych informacji może zmienić sposób, w jaki użytkownicy rozumieją produkt. Zmiany te mogą wydawać się niewielkie wewnętrznie, ale mogą znacząco wpłynąć na sposób podejmowania decyzji przez klientów.

Co powinienem najpierw przetestować, jeśli jestem nowy w testach A/B?

Zazwyczaj warto zacząć od elementów, które bezpośrednio wpływają na decyzje zakupowe. Obrazy produktów, propozycje wartości i wezwania do działania mają zwykle silniejszy wpływ niż czysto wizualne dostosowania. Testowanie obszarów najbliższych konwersji pomaga uzyskać wyraźniejsze wyniki na wczesnym etapie.

Czy test A/B może zakończyć się niepowodzeniem?

Oczywiście i nie oznacza to, że test został zmarnowany. Wynik, który nie wykazuje poprawy, nadal dostarcza informacji. Informuje, że określone założenie było nieprawidłowe, co pozwala uniknąć większych błędów w przyszłości. Z czasem te wnioski pomagają udoskonalić przyszłe eksperymenty.

Czy potrzebuję specjalnych narzędzi, aby skutecznie przeprowadzać testy A/B?

Narzędzia pomagają w śledzeniu i analizie, zwłaszcza gdy testowanie staje się coraz częstsze, ale główna idea nie zależy od złożonego oprogramowania. Najważniejsze jest posiadanie jasnych celów, właściwe izolowanie zmian i uważne analizowanie wyników. Technologia wspiera ten proces, ale dyscyplina sprawia, że działa.

Dołącz do WisePPC Beta i uzyskaj ekskluzywne korzyści dostępu

WisePPC jest teraz w wersji beta - i zapraszamy ograniczoną liczbę pierwszych użytkowników do dołączenia. Jako beta tester otrzymasz bezpłatny dostęp, dożywotnie profity i szansę na pomoc w kształtowaniu produktu - od Zweryfikowany partner Amazon Ads któremu można zaufać.

Karta kredytowa nie jest wymagana

Karta kredytowa nie jest wymagana

Darmowa w wersji beta i dodatkowy miesiąc za darmo po premierze

Darmowa w wersji beta i dodatkowy miesiąc za darmo po premierze

25% taniej dożywotnio - limitowana oferta beta

25% taniej dożywotnio - limitowana oferta beta

Dostęp do danych, których nie pokazują reklamy Amazon Ads

Dostęp do danych, których nie pokazują reklamy Amazon Ads

Weź udział w kształtowaniu produktu dzięki swoim opiniom

Weź udział w kształtowaniu produktu dzięki swoim opiniom