A/B-Tests für Ihre Produkte auf die richtige Weise

A/B-Tests klingen zunächst technisch, aber im Grunde ist es einfach eine Möglichkeit, nicht mehr zu raten, sondern aus dem tatsächlichen Kundenverhalten zu lernen. Anstatt etwas zu ändern und zu hoffen, dass es funktioniert, vergleicht man zwei Versionen und lässt sich von den Daten sagen, was die Leistung tatsächlich verbessert. Manchmal ist der Unterschied offensichtlich. In anderen Fällen überraschen die Ergebnisse, und genau darin liegt in der Regel die wahre Erkenntnis.

Für Produktteams und Verkäufer geht es beim Testen weniger darum, schnelle Erfolge zu erzielen, sondern vielmehr darum, Vertrauen in Entscheidungen aufzubauen. Eine kleine Änderung eines Bildes, eines Titels oder einer Nachricht kann die Reaktion der Kunden verändern, aber ohne Tests ist es fast unmöglich zu wissen, warum. Ein strukturierter Ansatz für A/B-Tests hilft, das Risiko zu verringern, Muster im Kundenverhalten aufzudecken und die Ergebnisse im Laufe der Zeit schrittweise zu verbessern, ohne das, was bereits funktioniert, zu unterbrechen.

Was A/B-Tests in der Praxis wirklich bedeuten

In der täglichen Arbeit ist A/B-Testing weniger kompliziert als es klingt. Im einfachsten Fall handelt es sich um ein kontrolliertes Experiment, mit dem eine Frage beantwortet werden soll: Welche Version funktioniert für echte Nutzer besser. Anstatt etwas für alle auf einmal zu ändern, erstellen Sie zwei Versionen desselben Elements und teilen Ihr Publikum zwischen ihnen auf. Eine Gruppe sieht die ursprüngliche Version, die oft als Kontrolle bezeichnet wird, während die andere Gruppe eine geänderte Version sieht, die als Variante bezeichnet wird. Alles andere bleibt gleich, so dass die Auswirkungen der einzelnen Änderung deutlich zu sehen sind.

Dieser Ansatz ist deshalb so zuverlässig, weil er Meinungen aus dem Prozess herausnimmt. Teams treffen Entscheidungen oft auf der Grundlage von Erfahrungen, Vorlieben oder internen Diskussionen, aber die Kunden reagieren nicht immer so, wie wir es erwarten. Ein Produktbild, das für einen Designer sauberer aussieht, wirkt auf einen Käufer vielleicht weniger vertrauenswürdig. Eine kürzere Beschreibung mag zwar leichter zu lesen sein, lässt aber wichtige Fragen unbeantwortet. A/B-Tests ersetzen Annahmen durch beobachtbares Verhalten. Die Nutzer stimmen durch ihre Handlungen ab und nicht durch ihr Feedback.

Ein weiteres wichtiges Detail ist, dass es bei A/B-Tests nicht darum geht, den Gewinner im Voraus zu erraten. Es geht darum, einen fairen Vergleich zu erstellen. Der Datenverkehr wird in der Regel nach dem Zufallsprinzip aufgeteilt, so dass jede Version mit ähnlichen Nutzertypen in Kontakt kommt. Mit der Zeit bilden sich Muster heraus. Wenn eine Version durchgängig zu mehr Klicks, Käufen oder Engagement führt, ist es unwahrscheinlich, dass der Unterschied zufällig ist. Dann können die Teams mit Zuversicht Änderungen vornehmen, anstatt zu hoffen.

Warum A/B-Tests für Produkte wichtiger sind denn je

Produkte konkurrieren nicht mehr nur über Funktionen oder den Preis. Sie konkurrieren um Klarheit, Vertrauen und darum, wie schnell die Nutzer den Wert verstehen. In einem Umfeld, in dem die Aufmerksamkeit der Kunden kurz ist und sich die Erwartungen ständig ändern, können kleine Verbesserungen einen spürbaren Unterschied machen. Genau aus diesem Grund sind strukturierte Tests nicht mehr optional, sondern unverzichtbar geworden.

Sich verändernde digitale Umgebungen erfordern eine kontinuierliche Validierung

Digitale Umgebungen stehen nicht still. Kundenerwartungen ändern sich schnell, Wettbewerber passen sich an, und Plattformen entwickeln sich weiter. Eine Produktseite, die im letzten Jahr gut funktioniert hat, kann leise an Effektivität verlieren, ohne dass es jemand sofort bemerkt. Kleine Einbußen summieren sich im Laufe der Zeit, und die Leistung sinkt selten auf einmal. Vielmehr nimmt sie allmählich ab, wenn sich die Erwartungen der Nutzer ändern. A/B-Tests helfen, diese langsamen Veränderungen zu erkennen und zu korrigieren, bevor sie zu größeren Problemen werden.

A/B-Tests verhindern Stagnation und fördern den Fortschritt

A/B-Tests dienen als Schutz vor Stagnation. Anstatt auf einen Leistungsabfall zu warten, erforschen Teams aktiv Verbesserungen durch kontrollierte Experimente. Dieser proaktive Ansatz schafft eine Dynamik, da die Optimierung Teil der regelmäßigen Arbeit wird und nicht nur ein gelegentlicher Umgestaltungsaufwand ist. Selbst kleine Fortschritte sind wichtig. Wenn kleine Verbesserungen konsequent bei Produktbildern, Botschaften, Layout oder Preisgestaltung angewandt werden, kann der kumulative Effekt im Laufe der Zeit erheblich sein.

Daten verringern die Reibung bei der Entscheidungsfindung im Team

Auch innerhalb der Teams gibt es einen psychologischen Vorteil, der oft unbemerkt bleibt. Tests verringern die Reibung bei der Entscheidungsfindung. Die Diskussionen bewegen sich weg vom persönlichen Geschmack und hin zu messbaren Ergebnissen. Wenn Daten an die Stelle von Diskussionen treten, beschleunigt sich der Fortschritt, weil Entscheidungen nicht mehr von Hierarchien oder Meinungen abhängen. Die Teams verbringen weniger Zeit damit, sich über die Richtung zu streiten, und mehr Zeit damit, das zu verfeinern, was für die Benutzer tatsächlich funktioniert.

Was Sie zuerst testen sollten

Wenn man zum ersten Mal A/B-Tests entdeckt, ist man oft versucht, alles auf einmal zu testen. Farben, Schriftarten, Layouts, Botschaften, Bilder. Das Ergebnis ist in der Regel eher Rauschen als Erkenntnis. Die Priorisierung ist wichtiger als die Anzahl der Experimente.

Ein guter Ausgangspunkt ist die Betrachtung der Momente, in denen Kunden Entscheidungen treffen. Dies sind Punkte, an denen Unsicherheit oder Zögern den Fortschritt aufhalten können. Je näher ein Element an diesem Entscheidungsmoment liegt, desto höher ist sein Testwert.

Zu berücksichtigende Elemente mit großer Wirkung

- Hauptproduktbilder oder visuelle Hauptfiguren

- Produkttitel und Wertversprechen

- Preisvorstellungen oder Rabatte

- Formulierung oder Platzierung des Aufrufs zum Handeln

- Beschreibungen der wichtigsten Vorteile

- Sozialer Beweis wie Bewertungen oder Zeugnisse

Diese Elemente prägen den ersten Eindruck und beeinflussen das Vertrauen. Optischer Schliff ist wichtig, aber Klarheit ist noch wichtiger. Die Kunden müssen verstehen, was das Produkt ist, warum es wichtig ist und was sie als Nächstes tun sollen. Tests helfen, diesen Weg zu verfeinern.

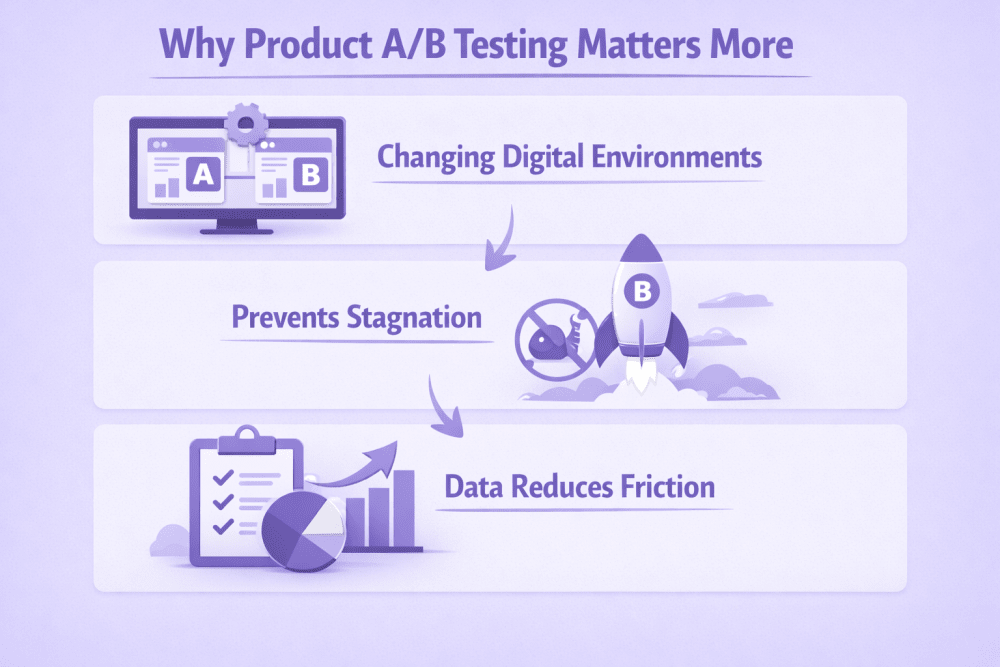

WisePPC: Fortgeschrittene Analytik als Leitfaden für Ihre Produkt-A/B-Teststrategie

Unter WisePPC, sehen wir A/B-Tests als eine natürliche Erweiterung der Analyse. Testen funktioniert nur, wenn Sie genau verstehen, was vor und nach einer Änderung passiert. Aus diesem Grund konzentriert sich unsere Plattform darauf, Verkäufern einen vollständigen Einblick in die Werbe- und Verkaufsleistung an einem Ort zu geben. Wenn Sie Experimente zu Produktangeboten, Preisgestaltung oder Kampagnenstruktur durchführen, müssen Sie sehen, wie sich diese Änderungen auf reale Ergebnisse auswirken, nicht nur auf oberflächliche Messwerte. Durch die Kombination von historischen Daten, Echtzeit-Performance-Tracking und detaillierter Segmentierung können wir feststellen, ob eine Veränderung die Ergebnisse wirklich verbessert oder nur vorübergehend Zahlen verschiebt.

In der Praxis bedeutet dies, dass wir es den Teams ermöglichen, die Leistung verschiedener Kampagnen, Platzierungen und Zeiträume zu vergleichen, ohne den Kontext zu verlieren. Langfristige historische Daten helfen, häufige Fehler beim Testen zu vermeiden, z. B. eine zu frühe Beurteilung der Ergebnisse oder das Übersehen saisonaler Muster. Detaillierte Analysen und Filter machen es einfacher zu erkennen, was sich geändert hat und warum, während Massenaktionen schnelle Anpassungen ermöglichen, sobald eine erfolgreiche Version ermittelt wurde. Anstatt zu raten, welche Version besser abschneidet, konzentrieren wir uns darauf, Verkäufern dabei zu helfen, Testentscheidungen mit messbaren geschäftlichen Auswirkungen zu verknüpfen, sei es in Form von verbessertem ROAS, reduzierten verschwendeten Werbeausgaben oder einem klareren Verständnis dessen, was tatsächlich zu Konversionen führt.

Wie man einen A/B-Test ohne Rätselraten durchführt

A/B-Tests funktionieren am besten, wenn sie in einer klaren Reihenfolge ablaufen. Viele Teams beginnen sofort mit der Erstellung von Variationen, weil sie das für einen Fortschritt halten. In Wirklichkeit scheitern die meisten Tests, bevor das Experiment überhaupt begonnen hat. Der Unterschied zwischen nützlichen Ergebnissen und verwirrenden Daten liegt in der Regel in der Vorbereitung, der Klarheit und der Geduld.

In diesem Abschnitt wird der gesamte Prozess auf praktische Art und Weise erläutert. Jeder Schritt baut auf dem vorhergehenden auf, so dass das Überspringen von Schritten später oft zu mehr Problemen führt.

Schritt 1 - Definieren Sie, was Erfolg wirklich bedeutet

Bevor man etwas ändert, ist es wichtig zu verstehen, warum es den Test überhaupt gibt. A/B-Tests ohne ein klares Ziel werden zu einer Aktivität ohne Richtung. Am Ende haben Sie vielleicht Daten, aber keine wirkliche Antwort.

Ein starkes Testziel steht in direktem Zusammenhang mit dem Nutzerverhalten. Anstelle von vagen Absichten wie der Verbesserung der Leistung sollte das Ziel ein bestimmtes Ergebnis beschreiben, das Sie beeinflussen möchten. Zum Beispiel mehr abgeschlossene Käufe, eine höhere Beschäftigung mit Produktdetails oder weniger Nutzer, die vor dem Bezahlen abbrechen.

Was ein klares Ziel in der Regel beantwortet

- Welche Benutzeraktion wollen wir verbessern?

- Wo auf der Reise das Problem auftritt

- Wie wird der Erfolg gemessen?

Wenn die Ziele klar sind, wird die Analyse später einfacher. Sie wissen bereits, welche Kennzahl am wichtigsten ist und warum Sie sie messen.

Beispiele für fokussierte Testzwecke

- Erhöhung der Produktkaufrate durch Verbesserung der Produktklarheit

- Verbessern Sie die Klickrate für die primäre Aufforderung zum Handeln

- Verringern Sie den Abbruch des Einkaufswagens beim Checkout

- Erhöhen Sie die Aufmerksamkeit für wichtige Produktinformationen

Je klarer das Ziel ist, desto einfacher ist es, einen aussagekräftigen Test zu konzipieren.

Schritt 2 - Umwandlung von Beobachtungen in eine prüfbare Hypothese

Sobald das Ziel definiert ist, besteht der nächste Schritt darin zu erklären, warum eine Veränderung überhaupt funktionieren könnte. Hier werden viele Tests entweder aussagekräftig oder verkommen zu Zufallsexperimenten. Eine Hypothese gibt dem Test eine Richtung. Sie stellt eine Verbindung her zwischen dem, was Sie in den Daten sehen, und einer spezifischen Änderung, von der Sie glauben, dass sie das Ergebnis verbessern könnte.

Eine Hypothese ist weder eine Vermutung noch eine kreative Idee. Sie ist eine strukturierte Annahme, die auf Beobachtungen beruht. Irgendetwas in der aktuellen Erfahrung funktioniert nicht wie erwartet, und die Hypothese erklärt, was die Ursache für diese Reibung sein könnte. Wenn Benutzer beispielsweise eine Produktseite immer wieder innerhalb weniger Sekunden verlassen, liegt das Problem möglicherweise nicht am Preis oder am Design. Es könnte einfach daran liegen, dass die Besucher nicht sofort verstehen, warum das Produkt für sie wichtig ist. In diesem Fall könnte die Hypothese lauten, dass eine Verbesserung der Klarheit der Überschrift oder der einleitenden Botschaft den Nutzern hilft, länger zu bleiben und sich intensiver mit dem Produkt zu beschäftigen.

Die nützlichsten Hypothesen ergeben sich in der Regel aus Mustern und nicht aus Meinungen. Kundenrezensionen offenbaren oft Verwirrung oder fehlende Informationen. Supportanfragen zeigen Bereiche auf, in denen die Erwartungen nicht mit der Realität übereinstimmen. Analysen können zeigen, wo Benutzer zögern oder den Prozess ganz abbrechen. Selbst der Vergleich von leistungsstarken mit schwächeren Produkten kann Unterschiede in der Kommunikation oder Präsentation aufzeigen, die es zu testen lohnt. Diese Signale helfen dabei, das Testen in eine Problemlösung umzuwandeln und nicht in ein Experimentieren um seiner selbst willen. Es ist wichtig, die Hypothese im Auge zu behalten. Jeder Test sollte darauf abzielen, eine sinnvolle Frage zu beantworten. Wenn der Rahmen eng gesteckt bleibt, ist das Ergebnis leichter zu interpretieren, und die gewonnenen Erkenntnisse lassen sich mit Zuversicht auf künftige Verbesserungen anwenden.

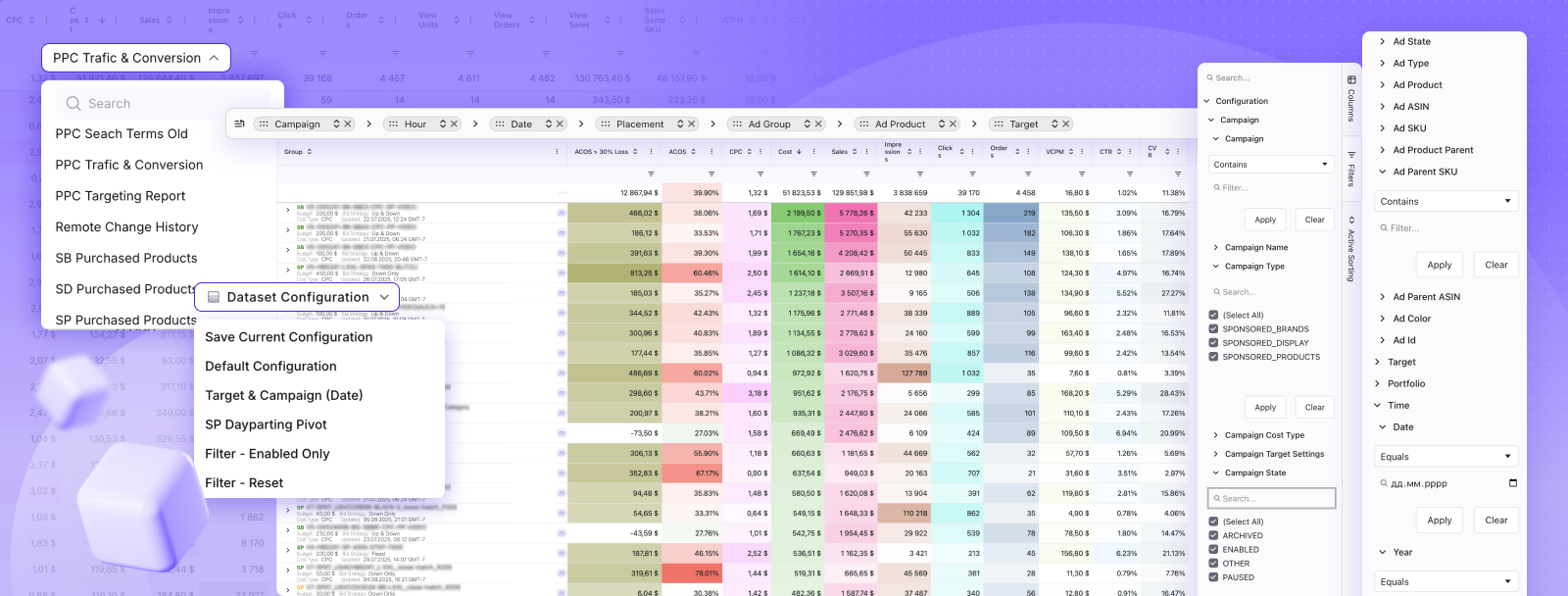

Schritt 3 - Erstellen von Varianten, die die Änderung isolieren

Dies ist die Phase, in der viele A/B-Tests leise ihren Wert verlieren. Wenn mehrere Verbesserungen offensichtlich sind, besteht der natürliche Instinkt darin, alles auf einmal zu aktualisieren. Ein neues Bild, ein umgeschriebener Text, ein angepasstes Layout, vielleicht sogar Preisänderungen. Das Problem ist, dass die Ergebnisse nicht mehr eindeutig sind, sobald mehrere Elemente gleichzeitig geändert werden. Wenn sich die Leistung verbessert, können Sie nicht mit Sicherheit erklären, warum das so ist.

Bei einem gut strukturierten A/B-Test sind die Dinge bewusst einfach gehalten. Der Zweck ist nicht, das gesamte Erlebnis neu zu gestalten, sondern einen bedeutsamen Unterschied zwischen zwei Versionen zu isolieren. Wenn sich nur eine Variable ändert, werden Ursache und Wirkung sichtbar. Das Ergebnis wird zu nützlichem Wissen und nicht zu einem Zufallsergebnis.

Kontrollversion - die aktuelle Produktseite oder Auflistung

Die Kontrollversion ist die bestehende Version, die die Benutzer bereits sehen. Sie dient als Basis für den Vergleich, da ihre Leistung bereits bekannt ist. Hier wird nichts geändert. Dadurch, dass die Kontrollversion unangetastet bleibt, wird sichergestellt, dass jeder Leistungsunterschied auf die neue Variante und nicht auf externe Faktoren zurückzuführen ist.

Variante - identisch bis auf eine absichtliche Änderung

Bei der Variantenversion wird eine einzige, bewusste Anpassung auf der Grundlage der Hypothese vorgenommen. Dabei kann es sich um ein anderes Produktbild, einen geänderten Wortlaut der Überschrift oder eine neue Platzierung für den sozialen Nachweis handeln. Alles andere bleibt gleich, so dass die Auswirkungen dieser einen Änderung genau gemessen werden können. Die Beibehaltung dieser Konsistenz schützt die Integrität des Tests und macht das Ergebnis leichter zu interpretieren.

Wenn Varianten auf diese Weise erstellt werden, sind die gewonnenen Erkenntnisse wiederverwendbar. Eine erfolgreiche Änderung kann oft auf andere Produkte oder Seiten übertragen werden, weil man versteht, was das Nutzerverhalten beeinflusst hat, und nicht nur, dass die Leistung gestiegen ist.

Schritt 4 - Lassen Sie den Test lange genug laufen, um vertrauenswürdig zu sein

Einer der schwierigsten Aspekte von A/B-Tests ist das Warten. Die ersten Daten sehen oft überzeugend aus, besonders wenn eine Version die andere schnell übertrifft. Leider sind die ersten Trends oft nur vorübergehend.

Das Nutzerverhalten ändert sich je nach Zeitpunkt, Verkehrsquellen und sogar je nach Wochentag. Eine Version, die während eines kurzen Zeitfensters gut funktioniert, funktioniert möglicherweise nicht über einen längeren Zeitraum hinweg gleich gut.

Gründe für Tests brauchen Zeit:

- Unterschiedliches Verhalten an Wochentagen und Wochenenden

- Neue und wiederkehrende Besucher verhalten sich unterschiedlich

- Der Kampagnenverkehr schwankt

- Zufällige Schwankungen können kurzfristige Ausschläge verursachen

Eine zu frühe Beendigung eines Tests birgt Risiken. Eine Entscheidung, die auf der Grundlage unvollständiger Daten getroffen wird, kann zu einer schwächeren Version führen und frühere Verbesserungen zunichte machen. Geduld schützt vor diesem Risiko.

Schritt 5 - Blick über den Tellerrand

Es ist ganz natürlich, sich auf die primäre Kennzahl zu konzentrieren, die mit dem Ziel verbunden ist. Die tatsächliche Leistung ist jedoch selten eindimensional. Verbesserungen in einem Bereich können zu unerwarteten Kompromissen in anderen Bereichen führen.

Eine aggressivere Botschaft könnte beispielsweise die Anzahl der Klicks erhöhen, aber die Kaufqualität verringern. Das Engagement steigt, aber der langfristige Wert sinkt. Ein Blick auf die unterstützenden Metriken hilft dabei, diese Situationen aufzudecken, bevor Änderungen auf breiter Basis eingeführt werden.

Metriken, die es wert sind, neben dem Hauptziel überprüft zu werden

- Umrechnungskurs

- Einnahmen pro Besucher

- Verhalten in den Warenkorb legen

- Auf der Seite verbrachte Zeit

- Absprungraten oder Ausstiegsraten

- Qualitätsindikatoren für Kunden

Eine ausgewogene Analyse berücksichtigt sowohl Engagement-Signale als auch Geschäftsergebnisse. Die leistungsstärkste Version ist nicht immer diejenige mit den meisten Klicks. Es ist diejenige, die zu nachhaltigen Ergebnissen führt.

Häufige A/B-Testing-Fehler zu vermeiden

Die meisten Probleme bei A/B-Tests sind nicht auf schlechte Absichten oder mangelnde Bemühungen zurückzuführen. Sie treten in der Regel auf, wenn Teams zu schnell vorgehen oder versuchen, Schlussfolgerungen zu erzwingen, bevor die Daten fertig sind. Oberflächlich betrachtet scheint das Testen einfach zu sein, aber kleine Fehler bei der Einrichtung oder Interpretation können zu Entscheidungen führen, die der Leistung schaden, anstatt sie zu verbessern. Wenn man versteht, was typischerweise schief läuft, können Experimente nützlich und zuverlässig bleiben.

Zu viele Änderungen auf einmal testen

Dies ist wahrscheinlich das häufigste Problem, vor allem, wenn die Teams ihre Ergebnisse schnell verbessern wollen. Mehrere Elemente sehen schwach aus, also wird alles gleichzeitig aktualisiert. Die Seite sieht besser aus, die Leistung verbessert sich, und alle gehen davon aus, dass der Test funktioniert hat. Das Problem ist, dass niemand weiß, welche Änderung tatsächlich den Unterschied ausgemacht hat.

Wenn sich mehrere Variablen gemeinsam bewegen, ist es unmöglich, aus dem Ergebnis zu lernen. Es kann passieren, dass Sie versehentlich Änderungen beibehalten, die sich negativ auf die Leistung auswirken, während Sie diejenigen entfernen, die hilfreich sind. Mit der Zeit führt dies zu inkonsistenten Ergebnissen und erschwert künftige Tests.

A/B-Tests funktionieren am besten, wenn jedes Experiment eine klare Frage beantwortet. Eine Änderung, ein Vergleich, eine Schlussfolgerung.

Zu frühes Beenden von Tests

Die ersten Daten können überzeugend sein. Eine Variante zeigt nach einigen Tagen Verbesserungen, und die Versuchung ist groß, sie zum Sieger zu erklären. Das Problem ist, dass frühe Ergebnisse oft unbeständig sind. Die Verkehrsmuster ändern sich im Laufe der Woche, Kampagnen verschieben sich, und das Nutzerverhalten variiert je nach Zeitpunkt.

Wird ein Test zu früh abgebrochen, erhöht sich die Wahrscheinlichkeit, dass ein falscher Gewinner ausgewählt wird. Was wie eine Verbesserung aussieht, ist vielleicht nur eine kurzfristige Fluktuation. Wenn man dem Verhalten genügend Zeit gibt, um sich zu normalisieren, kann man sicherstellen, dass das Ergebnis die tatsächliche Leistung widerspiegelt und nicht nur ein Zufall ist.

Geduld ist hier keine verschwendete Zeit. Sie schützt Sie davor, Änderungen vorzunehmen, die später wieder rückgängig gemacht werden müssen.

Optimieren für die falsche Metrik

Nicht jede Verbesserung ist tatsächlich eine Verbesserung. Manchmal steigert ein Test die Aktivität, ohne die Ergebnisse zu verbessern, die für das Unternehmen wichtig sind. Eine aggressivere Botschaft könnte beispielsweise die Klicks erhöhen, aber weniger ernsthafte Käufer anziehen, was zu einem geringeren Gesamtumsatz oder einer geringeren Kundenbindung führt.

Dies geschieht in der Regel, wenn sich Teams auf einfache statt auf aussagekräftige Metriken konzentrieren. Metriken sollten immer mit dem eigentlichen Ziel des Produkts oder der Kampagne verbunden sein.

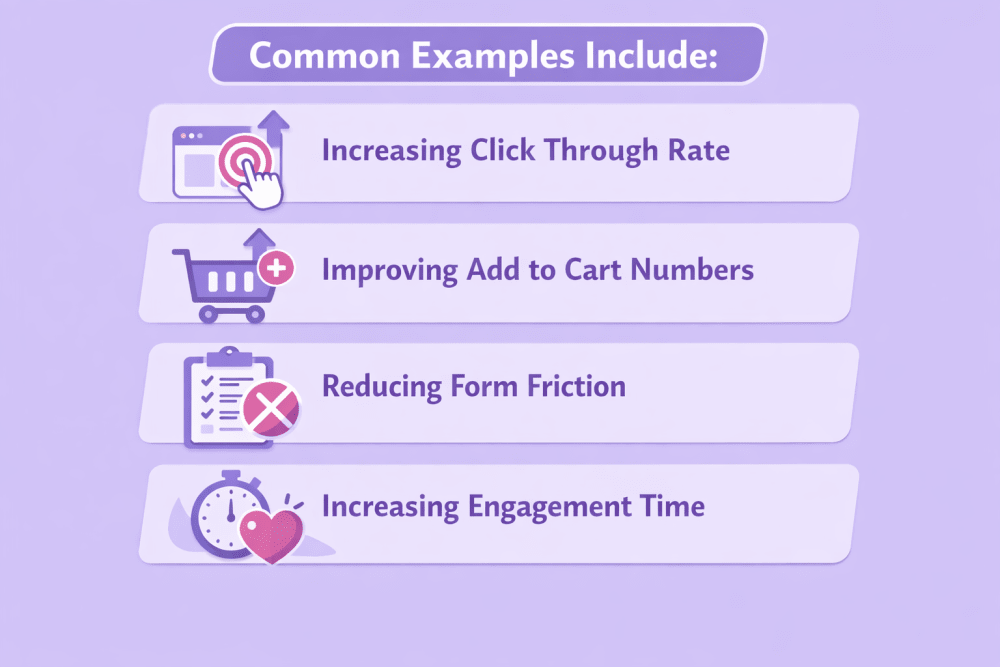

Gängige Beispiele sind:

- Erhöhung der Klickrate bei gleichzeitigem Rückgang der Kaufrate

- Verbesserung der Anzahl der in den Warenkorb gelegten Produkte ohne Verbesserung der abgeschlossenen Bestellungen

- Verringerung der Reibung der Formulare, aber Senkung der Qualität der Leads

- Erhöhung der Verweildauer ohne Steigerung der Konversionen

Die Betrachtung der unterstützenden Kennzahlen neben dem Hauptziel hilft, solche Situationen zu vermeiden.

Die Annahme, dass ein Ergebnis für jede Zielgruppe geeignet ist

Ein weiterer häufiger Fehler ist die Annahme, dass eine erfolgreiche Version für alle gleich gut funktioniert. In Wirklichkeit verhalten sich die verschiedenen Publikumsgruppen oft unterschiedlich. Neue Besucher brauchen vielleicht mehr Erklärungen, während Stammkunden Schnelligkeit und Vertrautheit bevorzugen. Mobile Nutzer reagieren möglicherweise anders als Desktop-Nutzer.

Das Ignorieren dieser Unterschiede kann wertvolle Erkenntnisse verbergen. Manchmal schneidet eine Variante, die insgesamt verliert, für ein bestimmtes Segment außergewöhnlich gut ab. Das Erkennen dieser Muster kann zu gezielteren Verbesserungen führen, statt zu einer universellen Änderung.

Schlussfolgerung

A/B-Tests werden oft als Taktik beschrieben, aber in der Praxis wird daraus eine Denkweise für Verbesserungen. Anstatt Änderungen auf der Grundlage von Instinkten oder internen Diskussionen vorzunehmen, lassen Sie echte Nutzer an der Entscheidung teilhaben. Manchmal bestätigen die Ergebnisse, was Sie erwartet haben. In anderen Fällen stellen sie Annahmen in Frage, von denen Sie nicht einmal wussten, dass Sie sie gemacht haben. Beide Ergebnisse bringen das Produkt voran.

Das Wichtigste ist die Beständigkeit. Ein Test wird die Leistung nicht über Nacht verändern, und das ist völlig normal. Der wahre Wert zeigt sich erst im Laufe der Zeit, wenn sich kleine Erkenntnisse ansammeln. Sie beginnen zu verstehen, wie Kunden Ihre Botschaften interpretieren, was Vertrauen schafft und wo im Kaufprozess Reibungsverluste auftreten. Entscheidungen werden ruhiger, Änderungen werden sicherer, und der Fortschritt wird vorhersehbarer.

Wenn es eine Sache gibt, an die man sich erinnern sollte, dann ist es die, dass es bei Tests nicht darum geht, Perfektion zu erreichen. Produkte entwickeln sich weiter, Zielgruppen ändern sich, und neue Ideen tauchen immer wieder auf. A/B-Tests geben Ihnen einfach eine zuverlässige Möglichkeit, sich anzupassen, ohne zu raten. Beginnen Sie mit einer klaren Frage, testen Sie sie ehrlich und lassen Sie sich von den Ergebnissen zum nächsten Schritt leiten.

FAQ

Wie lange sollte ein A/B-Test laufen, bevor ein Gewinner ausgewählt wird?

Es gibt keinen allgemeingültigen Zeitrahmen, da er vom Verkehrsaufkommen und der Anzahl der generierten Konversionen abhängt. Im Allgemeinen sollte ein Test lange genug laufen, um das normale Nutzerverhalten über verschiedene Tage und Verkehrsmuster hinweg zu erfassen. Ein zu frühes Beenden eines Tests führt oft zu irreführenden Schlussfolgerungen. Daher ist es besser zu warten, bis sich die Ergebnisse stabilisieren, anstatt auf frühe Trends zu reagieren.

Können kleine Änderungen bei A/B-Tests wirklich einen Unterschied machen?

Ja, und das ist oft der Grund für überraschende Verbesserungen. Ein anderes Bild, eine klarere Überschrift oder eine bessere Platzierung von Schlüsselinformationen kann dazu führen, dass die Nutzer ein Produkt schneller verstehen. Diese Änderungen mögen intern unbedeutend erscheinen, können sich aber erheblich auf die Entscheidungsfindung der Kunden auswirken.

Was sollte ich als erstes testen, wenn ich neu im A/B-Testing bin?

In der Regel ist es sinnvoll, mit Elementen zu beginnen, die die Kaufentscheidung direkt beeinflussen. Produktbilder, Wertversprechen und Handlungsaufforderungen haben in der Regel eine stärkere Wirkung als rein visuelle Anpassungen. Das Testen von Bereichen, die der Konversion am nächsten sind, hilft dabei, frühzeitig klarere Ergebnisse zu erzielen.

Ist es möglich, dass ein A/B-Test fehlschlägt?

Auf jeden Fall, und das bedeutet nicht, dass der Test umsonst war. Ein Ergebnis, das keine Verbesserung zeigt, liefert immer noch Informationen. Es zeigt Ihnen, dass eine bestimmte Annahme falsch war, was später größere Fehler verhindert. Mit der Zeit helfen diese Erkenntnisse, zukünftige Experimente zu verfeinern.

Brauche ich spezielle Tools, um A/B-Tests effektiv durchzuführen?

Tools helfen bei der Nachverfolgung und Analyse, vor allem, wenn die Tests häufiger werden, aber die Kernidee hängt nicht von komplexer Software ab. Das Wichtigste ist, klare Ziele zu haben, Änderungen richtig zu isolieren und die Ergebnisse sorgfältig zu analysieren. Die Technologie unterstützt den Prozess, aber die Disziplin sorgt dafür, dass er funktioniert.

Nehmen Sie an der WisePPC-Beta teil und erhalten Sie exklusive Zugangsvorteile

WisePPC ist jetzt in der Beta-Phase - und wir laden eine begrenzte Anzahl von frühen Nutzern ein, daran teilzunehmen. Als Beta-Tester erhalten Sie kostenlosen Zugang, lebenslange Vergünstigungen und die Möglichkeit, das Produkt mitzugestalten - von einem Amazon Ads Verifizierter Partner dem Sie vertrauen können.

Keine Kreditkarte erforderlich

Keine Kreditkarte erforderlich

Kostenlos in der Beta-Phase und ein zusätzlicher kostenloser Monat nach der Veröffentlichung

Kostenlos in der Beta-Phase und ein zusätzlicher kostenloser Monat nach der Veröffentlichung

25% lebenslang gratis - begrenztes Beta-Angebot

25% lebenslang gratis - begrenztes Beta-Angebot

Zugriff auf Metriken, die Ihnen Amazon Ads nicht zeigen

Zugriff auf Metriken, die Ihnen Amazon Ads nicht zeigen

Gestalten Sie das Produkt mit Ihrem Feedback mit

Gestalten Sie das Produkt mit Ihrem Feedback mit