Come eseguire il test A/B dei prodotti nel modo giusto

Il test A/B sembra inizialmente tecnico, ma in realtà è semplicemente un modo per smettere di tirare a indovinare e iniziare a imparare dal comportamento reale dei clienti. Invece di cambiare qualcosa e sperare che funzioni, si confrontano due versioni e si lascia che siano i dati a dire cosa effettivamente migliora le prestazioni. A volte la differenza è evidente. Altre volte i risultati sorprendono, e di solito è qui che si trova la vera intuizione.

Per i team di prodotto e i venditori, i test non sono più finalizzati alla ricerca di vittorie rapide, ma piuttosto a creare fiducia nelle decisioni. Una piccola modifica a un'immagine, a un titolo o a un messaggio può cambiare il modo in cui le persone rispondono, ma senza test è quasi impossibile sapere perché. Un approccio strutturato ai test A/B aiuta a ridurre i rischi, a scoprire i modelli di comportamento dei clienti e a migliorare gradualmente i risultati nel tempo senza stravolgere ciò che già funziona.

Cosa significa in pratica il test A/B

Nel lavoro di tutti i giorni, il test A/B è meno complicato di quanto sembri. Nella sua forma più semplice, è un esperimento controllato progettato per rispondere a una domanda: quale versione funziona meglio per gli utenti reali. Invece di cambiare qualcosa per tutti in una volta, si creano due versioni dello stesso elemento e si divide il pubblico tra di esse. Un gruppo vede la versione originale, spesso chiamata controllo, mentre l'altro vede una versione modificata, nota come variante. Tutto il resto rimane invariato, in modo da poter osservare chiaramente l'impatto della singola modifica.

Ciò che rende affidabile questo approccio è che elimina le opinioni dal processo. I team spesso prendono decisioni in base all'esperienza, alle preferenze o alle discussioni interne, ma i clienti non sempre rispondono come ci aspettiamo. Un'immagine del prodotto che sembra più pulita per un designer potrebbe sembrare meno affidabile per un acquirente. Una descrizione più breve potrebbe sembrare più facile da leggere, ma lasciare domande importanti senza risposta. I test A/B sostituiscono le ipotesi con il comportamento osservabile. Gli utenti votano attraverso le loro azioni piuttosto che attraverso i loro feedback.

Un altro dettaglio importante è che il test A/B non consiste nell'indovinare in anticipo il vincitore. Si tratta di creare un confronto equo. Il traffico viene solitamente suddiviso in modo casuale, in modo che ogni versione sia esposta a tipi di utenti simili. Nel corso del tempo, emergono degli schemi. Se una versione porta costantemente a un maggior numero di clic, acquisti o coinvolgimento, è improbabile che la differenza sia casuale. È allora che i team possono apportare modifiche con fiducia anziché con speranza.

Perché i test A/B dei prodotti sono più importanti che mai

I prodotti non competono più solo in base alle caratteristiche o al prezzo. Sono in competizione per la chiarezza, la fiducia e la rapidità con cui gli utenti comprendono il valore. In un ambiente in cui l'attenzione dei clienti è breve e le aspettative cambiano continuamente, i piccoli miglioramenti possono fare una differenza notevole, ed è proprio per questo che i test strutturati sono diventati essenziali anziché opzionali.

Ambienti digitali in continua evoluzione richiedono una convalida continua

Gli ambienti digitali non restano fermi. Le aspettative dei clienti cambiano rapidamente, i concorrenti si adattano e le piattaforme si evolvono. Una pagina di prodotto che l'anno scorso aveva ottenuto buoni risultati può perdere silenziosamente efficacia senza che nessuno se ne accorga subito. I piccoli cali si sommano nel tempo e raramente le prestazioni si riducono in una sola volta. Più spesso, si affievoliscono gradualmente, man mano che le aspettative degli utenti cambiano. I test A/B aiutano a individuare e a correggere questi lenti cambiamenti prima che diventino problemi più gravi.

I test A/B prevengono la stagnazione e incoraggiano il progresso

L'A/B testing agisce come una salvaguardia contro la stagnazione. Invece di aspettare cali di prestazioni, i team esplorano attivamente i miglioramenti attraverso esperimenti controllati. Questo approccio proattivo crea slancio, perché l'ottimizzazione diventa parte del lavoro regolare piuttosto che uno sforzo occasionale di riprogettazione. Anche i piccoli miglioramenti sono importanti. Quando i piccoli miglioramenti vengono applicati in modo coerente alle immagini dei prodotti, alla messaggistica, al layout o alla presentazione dei prezzi, l'effetto cumulativo può essere significativo nel tempo.

I dati riducono l'attrito nel processo decisionale del team

Esiste anche un beneficio psicologico all'interno dei team che spesso passa inosservato. I test riducono l'attrito nel processo decisionale. Le discussioni si allontanano dai gusti personali e si orientano verso risultati misurabili. Quando i dati sostituiscono il dibattito, il progresso tende ad accelerare perché le decisioni non dipendono più dalla gerarchia o dalle opinioni. I team passano meno tempo a discutere sulla direzione da prendere e più tempo a perfezionare ciò che funziona effettivamente per gli utenti.

Cosa si dovrebbe testare per prima cosa

Quando si scopre per la prima volta il test A/B, spesso si ha la tentazione di testare tutto in una volta. Colori, font, layout, messaggi, immagini. Il risultato è di solito un rumore piuttosto che un'intuizione. La definizione delle priorità è più importante del volume di sperimentazione.

Un buon punto di partenza è osservare i momenti in cui i clienti prendono le decisioni. Si tratta di punti in cui l'incertezza o l'esitazione possono bloccare il progresso. Più un elemento è vicino a quel momento decisionale, più alto è il suo valore di test.

Elementi ad alto impatto da considerare

- Immagini principali del prodotto o immagini eroiche

- Titoli dei prodotti e proposte di valore

- Presentazione dei prezzi o sconti

- Formulazione o posizionamento dell'invito all'azione

- Descrizione dei benefici principali

- Prova sociale come recensioni o testimonianze

Questi elementi determinano la prima impressione e influenzano la fiducia. La pulizia visiva è importante, ma la chiarezza lo è ancora di più. I clienti devono capire cos'è il prodotto, perché è importante e cosa fare dopo. I test aiutano a perfezionare questo percorso.

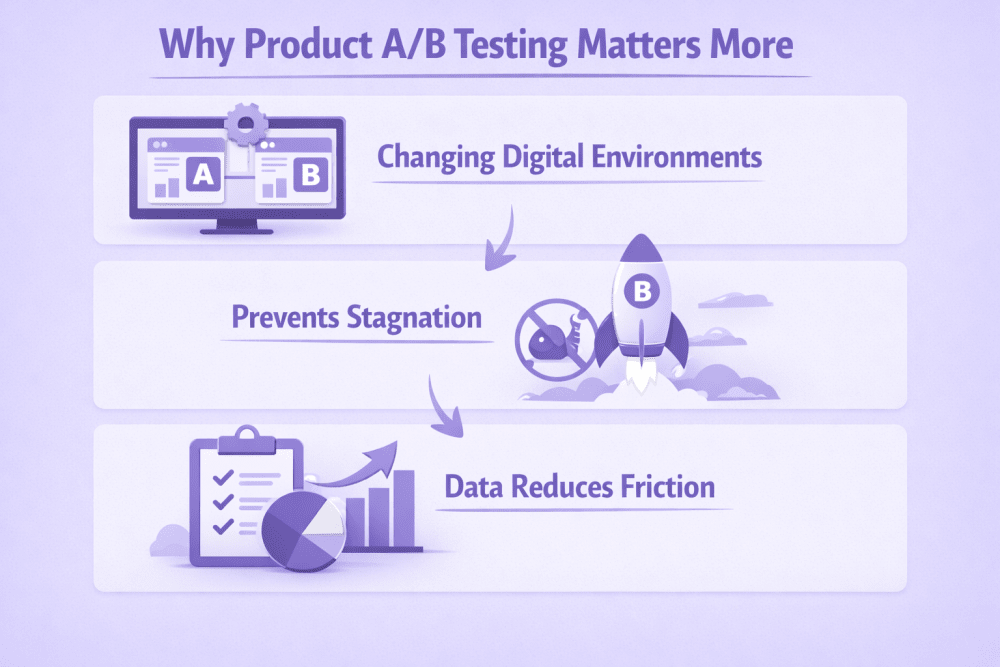

WisePPC: Analisi avanzate per guidare la strategia di test A/B dei prodotti

A WisePPC, Per noi i test A/B sono un'estensione naturale dell'analisi. I test funzionano solo se si capisce chiaramente cosa succede prima e dopo un cambiamento. Per questo motivo la nostra piattaforma si concentra sull'offrire ai venditori una visibilità completa delle performance pubblicitarie e di vendita in un unico luogo. Quando si eseguono esperimenti sulle inserzioni dei prodotti, sui prezzi o sulla struttura delle campagne, è necessario vedere come tali modifiche influiscono sui risultati reali, non solo sulle metriche superficiali. Combinando dati storici, monitoraggio delle prestazioni in tempo reale e segmentazione dettagliata, aiutiamo a identificare se una variazione migliora realmente i risultati o se sposta semplicemente i numeri in modo temporaneo.

In pratica, ciò significa che consentiamo ai team di confrontare le prestazioni tra campagne, posizionamenti e periodi di tempo senza perdere il contesto. I dati storici a lungo termine aiutano a evitare i più comuni errori di testing, come giudicare i risultati troppo presto o perdere i modelli stagionali. Le analisi e i filtri granulari rendono più facile isolare ciò che è cambiato e perché, mentre le azioni massicce consentono di apportare modifiche rapide una volta identificata la versione vincente. Invece di tirare a indovinare quale versione sia più performante, ci concentriamo sull'aiutare i venditori a collegare le decisioni di testing con un impatto commerciale misurabile, che si tratti di un miglioramento del ROAS, di una riduzione dello spreco di spesa pubblicitaria o di una più chiara comprensione di ciò che effettivamente guida le conversioni.

Come eseguire un test A/B senza congetture

I test A/B funzionano meglio quando seguono una sequenza chiara. Molti team si lanciano subito nella creazione di varianti, perché sembra un progresso. In realtà, la maggior parte dei test falliti avviene prima ancora di iniziare l'esperimento. La differenza tra risultati utili e dati confusi si riduce di solito alla preparazione, alla chiarezza e alla pazienza.

Questa sezione illustra l'intero processo in modo pratico. Ogni fase si basa su quella precedente, per cui saltarla spesso crea ulteriori problemi in seguito.

Fase 1 - Definire il vero significato del successo

Prima di cambiare qualcosa, è importante capire perché esiste il test. Un test A/B senza un obiettivo chiaro si trasforma in un'attività senza direzione. Potreste ritrovarvi con dei dati, ma senza una vera risposta.

Un obiettivo di test forte si collega direttamente al comportamento dell'utente. Invece di intenzioni vaghe come il miglioramento delle prestazioni, l'obiettivo deve descrivere un risultato specifico che si vuole influenzare. Ad esempio, un maggior numero di acquisti completati, un maggior coinvolgimento con i dettagli del prodotto o un minor numero di utenti che abbandonano il sito prima del checkout.

Cosa risponde di solito un obiettivo chiaro

- Quale azione dell'utente stiamo cercando di migliorare

- In quale punto del viaggio si verifica il problema

- Come verrà misurato il successo

Quando gli obiettivi sono chiari, l'analisi diventa più semplice. Sapete già quale metrica è più importante e perché la state misurando.

Esempi di obiettivi di test focalizzati

- Aumentare il tasso di acquisto dei prodotti migliorando la loro chiarezza

- Migliorare il tasso di click-through sull'invito primario all'azione

- Ridurre l'abbandono del carrello durante il checkout

- Aumentare il coinvolgimento con le informazioni chiave sui prodotti

Più chiaro è l'obiettivo, più facile diventa progettare un test significativo.

Fase 2 - Trasformare le osservazioni in un'ipotesi testabile

Una volta definito l'obiettivo, il passo successivo è spiegare perché un cambiamento potrebbe funzionare. È qui che molti test diventano significativi o si trasformano in esperimenti casuali. Un'ipotesi dà una direzione al test. Collega ciò che si vede nei dati con una modifica specifica che si ritiene possa migliorare il risultato.

Un'ipotesi non è una supposizione o un'idea creativa. È una supposizione strutturata costruita sull'osservazione. Qualcosa nell'esperienza attuale non funziona come ci si aspetta e l'ipotesi spiega cosa potrebbe causare questo attrito. Ad esempio, se gli utenti abbandonano costantemente la pagina di un prodotto entro pochi secondi, il problema potrebbe non essere il prezzo o il design. Potrebbe essere semplicemente che i visitatori non capiscano immediatamente perché il prodotto è importante per loro. In questo caso, l'ipotesi potrebbe essere quella di migliorare la chiarezza del titolo o del messaggio di apertura per aiutare gli utenti a rimanere più a lungo e a impegnarsi più a fondo.

Le ipotesi più utili di solito provengono da modelli piuttosto che da opinioni. Le recensioni dei clienti spesso rivelano confusione o informazioni mancanti. Le domande di assistenza evidenziano le aree in cui le aspettative non corrispondono alla realtà. Le analisi possono mostrare dove gli utenti esitano o abbandonano del tutto il processo. Anche il confronto tra prodotti ad alte prestazioni e prodotti più deboli può rivelare differenze nella messaggistica o nella presentazione che vale la pena testare. Questi segnali aiutano a trasformare i test in una soluzione dei problemi, anziché in una sperimentazione fine a se stessa. È importante mantenere l'ipotesi focalizzata. Ogni test deve mirare a rispondere a una domanda significativa. Quando il campo di applicazione rimane ristretto, il risultato diventa più facile da interpretare e le conoscenze acquisite possono essere applicate con fiducia ai miglioramenti futuri.

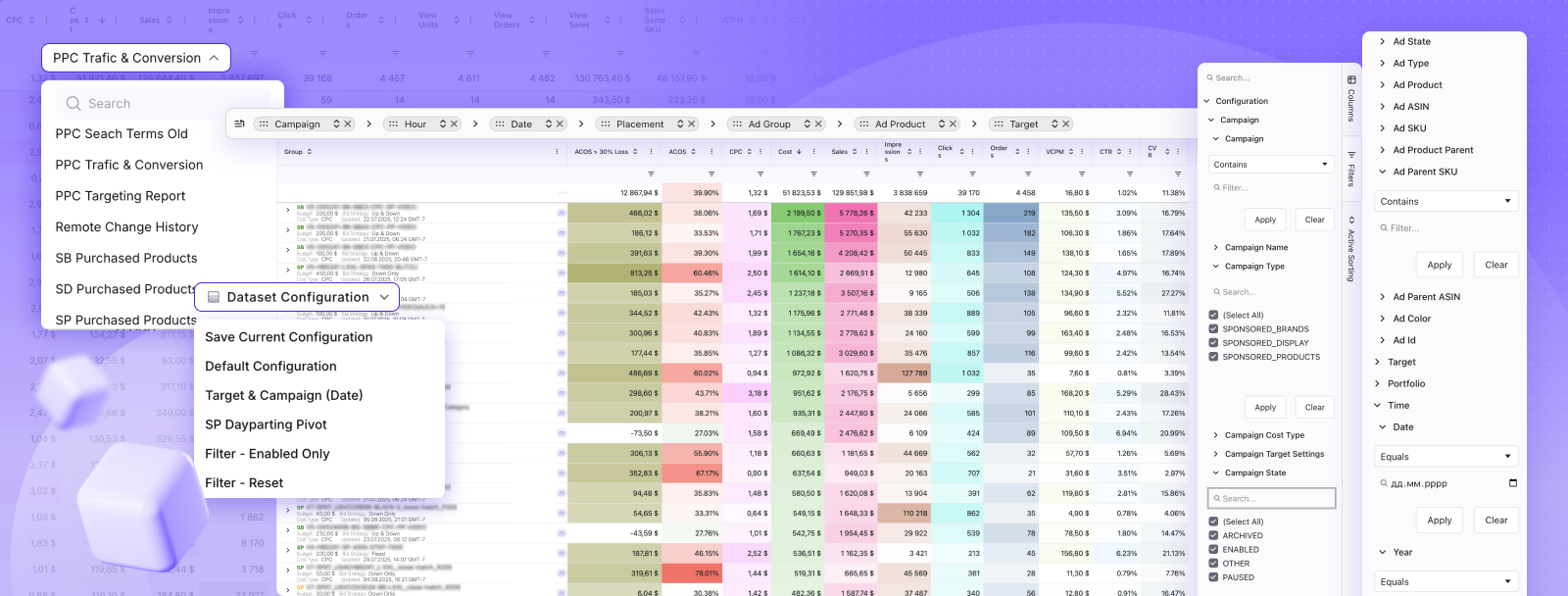

Fase 3 - Creare varianti che isolino la modifica

Questa è la fase in cui molti test A/B perdono silenziosamente il loro valore. Quando diversi miglioramenti appaiono evidenti, l'istinto naturale è quello di aggiornare tutto in una volta. Una nuova immagine, una riscrittura del testo, una modifica del layout e magari anche dei prezzi. Il problema è che quando più elementi cambiano insieme, i risultati non sono più chiari. Se le prestazioni migliorano, non si riesce a spiegare con sicurezza perché è successo.

Un test A/B ben strutturato mantiene le cose intenzionalmente semplici. Lo scopo non è quello di riprogettare l'intera esperienza, ma di isolare una differenza significativa tra due versioni. Quando cambia una sola variabile, causa ed effetto diventano visibili. Il risultato diventa una conoscenza utile piuttosto che un risultato fortunato.

Versione di controllo - la pagina o l'elenco del prodotto corrente

La versione di controllo è la versione esistente che gli utenti vedono già. Serve come base di confronto, perché le sue prestazioni sono già note. Qui non si cambia nulla. Mantenere il controllo inalterato assicura che qualsiasi differenza di prestazioni derivi dalla nuova variazione e non da fattori esterni.

Variante - Identica tranne che per una modifica intenzionale

La versione variante introduce una singola modifica intenzionale basata sull'ipotesi. Potrebbe trattarsi di una diversa immagine del prodotto, di una nuova formulazione del titolo o di un nuovo posizionamento per la riprova sociale. Tutto il resto rimane invariato, in modo da poter misurare con precisione l'impatto di quell'unica modifica. Il mantenimento di questa coerenza protegge l'integrità del test e rende i risultati più facili da interpretare.

Quando le varianti vengono create in questo modo, le informazioni acquisite diventano riutilizzabili. Una modifica di successo può spesso essere applicata ad altri prodotti o pagine, perché si capisce cosa ha influenzato il comportamento degli utenti, non solo l'aumento delle prestazioni.

Fase 4 - Lasciare che il test venga eseguito abbastanza a lungo da essere affidabile

Una delle parti più difficili dei test A/B è l'attesa. I primi dati sembrano spesso convincenti, soprattutto quando una versione inizia a superare rapidamente l'altra. Purtroppo, le prime tendenze sono spesso temporanee.

Il comportamento degli utenti cambia a seconda dell'orario, delle fonti di traffico e persino del giorno della settimana. Una versione che funziona bene in una breve finestra può non funzionare allo stesso modo nel tempo.

I test hanno bisogno di tempo:

- Il comportamento nei giorni feriali e nei fine settimana è diverso

- I visitatori nuovi e quelli che ritornano si comportano in modo diverso

- Il traffico della campagna fluttua

- La variazione casuale può creare picchi a breve termine

Terminare un test troppo presto introduce dei rischi. Una decisione presa sulla base di dati incompleti può bloccare una versione più debole e annullare i miglioramenti precedenti. La pazienza protegge da questo rischio.

Passo 5 - Guardare oltre una singola metrica

È naturale concentrarsi sulla metrica principale legata all'obiettivo. Tuttavia, le prestazioni reali sono raramente unidimensionali. I miglioramenti in un'area possono creare compromessi inaspettati altrove.

Ad esempio, un messaggio più aggressivo potrebbe aumentare i clic, riducendo però la qualità dell'acquisto. Il coinvolgimento aumenta, ma il valore a lungo termine diminuisce. L'analisi delle metriche di supporto aiuta a rivelare queste situazioni prima che le modifiche vengano introdotte su larga scala.

Metriche da esaminare insieme all'obiettivo principale

- Tasso di conversione

- Ricavi per visitatore

- Comportamento dell'aggiunta al carrello

- Tempo trascorso sulla pagina

- Tassi di rimbalzo o di uscita

- Indicatori di qualità del cliente

Un'analisi equilibrata considera sia i segnali di coinvolgimento che i risultati di business. La versione più performante non è sempre quella con il maggior numero di clic. È quella che supporta risultati sostenibili.

Errori comuni nei test A/B da evitare

La maggior parte dei problemi legati ai test A/B non deriva da cattive intenzioni o da mancanza di impegno. Di solito si manifestano quando i team si muovono troppo velocemente o cercano di forzare le conclusioni prima che i dati siano pronti. I test sembrano semplici in superficie, ma piccoli errori di impostazione o di interpretazione possono portare a decisioni che silenziosamente danneggiano le prestazioni invece di migliorarle. Capire dove le cose tipicamente vanno storte aiuta a mantenere gli esperimenti utili e affidabili.

Testare troppe modifiche in una volta sola

Questo è probabilmente il problema più comune, soprattutto quando i team sono desiderosi di migliorare rapidamente i risultati. Diversi elementi sembrano deboli, quindi tutto viene aggiornato nello stesso momento. La pagina appare migliore, le prestazioni cambiano e tutti pensano che il test abbia funzionato. Il problema è che nessuno sa quale modifica abbia effettivamente fatto la differenza.

Quando più variabili si muovono insieme, il risultato diventa impossibile da imparare. Potreste accidentalmente mantenere le modifiche che hanno compromesso le prestazioni e rimuovere quelle che le hanno migliorate. Nel tempo, questo crea risultati incoerenti e rende più difficili i test futuri.

I test A/B funzionano meglio quando ogni esperimento risponde a una domanda chiara. Un cambiamento, un confronto, una conclusione.

Terminare i test troppo presto

I primi dati possono essere convincenti. Una variante mostra miglioramenti dopo pochi giorni e la tentazione di dichiarare un vincitore diventa forte. Il problema è che i primi risultati sono spesso instabili. I modelli di traffico cambiano nel corso della settimana, le campagne si spostano e il comportamento degli utenti varia a seconda del momento.

Interrompere un test troppo presto aumenta la possibilità di scegliere un falso vincitore. Ciò che sembra un miglioramento può essere semplicemente una fluttuazione a breve termine. Lasciare un tempo sufficiente per normalizzare il comportamento aiuta a garantire che il risultato rifletta le prestazioni reali e non una coincidenza.

La pazienza non è tempo perso. Vi protegge dall'introduzione di modifiche che in seguito dovranno essere annullate.

Ottimizzazione per la metrica sbagliata

Non tutti i miglioramenti sono effettivamente tali. A volte un test aumenta l'attività senza migliorare i risultati importanti per l'azienda. Ad esempio, un messaggio più aggressivo potrebbe aumentare i clic, ma attirare acquirenti meno seri, con conseguente diminuzione dei ricavi complessivi o della fidelizzazione.

Questo accade di solito quando i team si concentrano su metriche facili invece che su quelle significative. Le metriche devono sempre essere collegate all'obiettivo reale del prodotto o della campagna.

Esempi comuni sono:

- Aumento del tasso di click through mentre il tasso di acquisto diminuisce

- Migliorare il numero di aggiunte al carrello senza migliorare gli ordini completati

- Riduzione dell'attrito del modulo, ma riduzione della qualità del lead

- Aumentare il tempo di coinvolgimento senza aumentare le conversioni

Considerare le metriche di supporto insieme all'obiettivo primario aiuta a prevenire queste situazioni.

Presupporre che un risultato sia adatto a ogni pubblico

Un altro errore frequente è quello di dare per scontato che una versione vincente vada bene per tutti. In realtà, i diversi segmenti di pubblico si comportano spesso in modo diverso. I nuovi visitatori possono aver bisogno di maggiori spiegazioni, mentre i clienti abituali preferiscono velocità e familiarità. Gli utenti di dispositivi mobili possono rispondere in modo diverso da quelli di desktop.

Ignorare queste differenze può nascondere preziose intuizioni. A volte una variante perdente nel complesso ha prestazioni eccezionali per un segmento specifico. Riconoscere questi schemi può portare a miglioramenti più mirati invece che a una modifica universale.

Conclusione

Il test A/B viene spesso descritto come una tattica, ma in pratica diventa un modo di pensare al miglioramento. Invece di apportare modifiche basate sull'istinto o sul dibattito interno, si dà voce agli utenti reali nella decisione. A volte i risultati confermano ciò che ci si aspettava. Altre volte mettono in discussione ipotesi che non vi eravate nemmeno accorti di aver fatto. Entrambi i risultati fanno progredire il prodotto.

Ciò che conta di più è la coerenza. Un test non trasformerà le prestazioni da un giorno all'altro, e questo è perfettamente normale. Il vero valore appare nel tempo, con l'accumularsi di piccole intuizioni. Si inizia a capire come i clienti interpretano i messaggi, cosa crea fiducia e dove si manifestano gli attriti nel processo di acquisto. Le decisioni diventano più tranquille, i cambiamenti più sicuri e i progressi più prevedibili.

Se c'è una cosa che vale la pena di ricordare è che i test non servono a inseguire la perfezione. I prodotti si evolvono, il pubblico cambia e appaiono sempre nuove idee. Il test A/B vi offre semplicemente un modo affidabile per adattarvi senza tirare a indovinare. Iniziate con una domanda chiara, fate un test onesto e lasciate che i risultati guidino il passo successivo.

FAQ

Quanto tempo deve durare un test A/B prima di scegliere il vincitore?

Non esiste una tempistica universale perché dipende dal volume di traffico e dal numero di conversioni generate. In generale, un test dovrebbe durare abbastanza a lungo da catturare il normale comportamento degli utenti in diversi giorni e modelli di traffico. Terminare un test troppo presto spesso porta a conclusioni fuorvianti, quindi è meglio aspettare che i risultati si stabilizzino piuttosto che reagire alle prime tendenze.

I piccoli cambiamenti possono davvero fare la differenza nei test A/B?

Sì, e spesso è da qui che nascono miglioramenti sorprendenti. Un'immagine diversa, un titolo più chiaro o una migliore collocazione delle informazioni chiave possono cambiare la rapidità con cui gli utenti comprendono un prodotto. Questi cambiamenti possono sembrare minori all'interno, ma possono influenzare in modo significativo il modo in cui i clienti prendono le decisioni.

Cosa devo testare per prima cosa se sono alle prime armi con i test A/B?

Di solito ha senso iniziare con gli elementi che influenzano direttamente le decisioni di acquisto. Le immagini dei prodotti, le proposte di valore e le chiamate all'azione tendono ad avere un impatto maggiore rispetto alle modifiche puramente visive. Testare le aree più vicine alla conversione aiuta a produrre risultati più chiari fin dalle prime fasi.

È possibile che un test A/B fallisca?

Assolutamente sì, e questo non significa che il test sia stato sprecato. Un risultato che non mostra alcun miglioramento fornisce comunque informazioni. Vi dice che una particolare ipotesi non era corretta, il che evita errori più grandi in seguito. Nel tempo, questi insegnamenti aiutano a perfezionare gli esperimenti futuri.

Ho bisogno di strumenti speciali per eseguire efficacemente i test A/B?

Gli strumenti aiutano a tracciare e analizzare, soprattutto quando i test diventano più frequenti, ma l'idea di base non dipende da un software complesso. Ciò che conta di più è avere obiettivi chiari, isolare correttamente le modifiche e analizzare attentamente i risultati. La tecnologia supporta il processo, ma è la disciplina a farlo funzionare.

Unisciti alla Beta di WisePPC e ottieni vantaggi di accesso esclusivi

WisePPC è ora in fase beta e stiamo invitando un numero limitato di primi utenti a partecipare. In qualità di beta tester, otterrete accesso gratuito, vantaggi a vita e la possibilità di contribuire alla creazione del prodotto - da una Partner verificato di Amazon Ads di cui ci si può fidare.

Non è richiesta la carta di credito

Non è richiesta la carta di credito

Gratuito in beta e gratis per un mese supplementare dopo il rilascio

Gratuito in beta e gratis per un mese supplementare dopo il rilascio

25% a vita - offerta beta limitata

25% a vita - offerta beta limitata

Accesso alle metriche che Amazon Ads non vi mostrerà

Accesso alle metriche che Amazon Ads non vi mostrerà

Partecipate alla creazione del prodotto con il vostro feedback

Partecipate alla creazione del prodotto con il vostro feedback