Cómo probar sus productos de la forma correcta

Las pruebas A/B suenan técnicas al principio, pero en el fondo son simplemente una forma de dejar de adivinar y empezar a aprender del comportamiento real de los clientes. En lugar de cambiar algo y esperar que funcione, se comparan dos versiones y se deja que los datos indiquen qué es lo que realmente mejora el rendimiento. A veces la diferencia es obvia. Otras veces los resultados le sorprenden, y ahí es donde suele residir el verdadero conocimiento.

Para los equipos de producto y los vendedores, las pruebas tienen menos que ver con la búsqueda de victorias rápidas y más con la creación de confianza en las decisiones. Un pequeño cambio en una imagen, un título o un mensaje puede cambiar la respuesta de la gente, pero sin pruebas es casi imposible saber por qué. Un enfoque estructurado de pruebas A/B ayuda a reducir el riesgo, descubrir patrones en el comportamiento del cliente y mejorar gradualmente los resultados a lo largo del tiempo sin alterar lo que ya funciona.

Qué significan realmente las pruebas A/B en la práctica

En el trabajo diario, las pruebas A/B son menos complicadas de lo que parecen. En su forma más simple, se trata de un experimento controlado diseñado para responder a una pregunta: qué versión funciona mejor para los usuarios reales. En lugar de cambiar algo para todos a la vez, se crean dos versiones del mismo elemento y se divide al público entre ellas. Un grupo ve la versión original, a menudo denominada control, mientras que el otro ve una versión modificada, conocida como variante. Todo lo demás permanece igual para que pueda observarse claramente el impacto del único cambio.

Lo que hace fiable este enfoque es que elimina la opinión del proceso. Los equipos suelen tomar decisiones basadas en la experiencia, las preferencias o los debates internos, pero los clientes no siempre responden como esperamos. Una imagen de producto que parece más limpia para un diseñador puede parecer menos fiable para un comprador. Una descripción más breve puede parecer más fácil de leer, pero deja preguntas importantes sin respuesta. Las pruebas A/B sustituyen las suposiciones por comportamientos observables. Los usuarios votan a través de sus acciones en lugar de sus comentarios.

Otro detalle importante es que las pruebas A/B no consisten en adivinar el ganador de antemano. Se trata de crear una comparación justa. El tráfico suele dividirse aleatoriamente para que cada versión esté expuesta a tipos similares de usuarios. Con el tiempo, surgen patrones. Si una versión conduce sistemáticamente a más clics, compras o compromiso, es poco probable que la diferencia sea accidental. Es entonces cuando los equipos pueden hacer cambios con confianza en lugar de con esperanza.

Por qué las pruebas A/B de productos son más importantes que nunca

Los productos ya no compiten sólo en características o precio. Compiten en claridad, confianza y rapidez con que los usuarios comprenden el valor. En un entorno en el que la atención del cliente es escasa y las expectativas cambian constantemente, las pequeñas mejoras pueden marcar una diferencia notable, que es exactamente la razón por la que las pruebas estructuradas se han convertido en algo esencial y no opcional.

Los entornos digitales cambiantes exigen una validación continua

Los entornos digitales no se quedan quietos. Las expectativas de los clientes cambian rápidamente, los competidores se adaptan y las plataformas evolucionan. Una página de producto que funcionó bien el año pasado puede perder eficacia silenciosamente sin que nadie se dé cuenta de inmediato. Los pequeños descensos se acumulan con el tiempo, y el rendimiento rara vez cae de golpe. Más a menudo, se desvanece gradualmente a medida que cambian las expectativas del usuario. Las pruebas A/B ayudan a detectar y corregir estos cambios lentos antes de que se conviertan en problemas mayores.

Las pruebas A/B evitan el estancamiento y fomentan el progreso

Las pruebas A/B actúan como una salvaguarda contra el estancamiento. En lugar de esperar a que baje el rendimiento, los equipos exploran activamente las mejoras mediante experimentos controlados. Este enfoque proactivo crea impulso porque la optimización se convierte en parte del trabajo habitual en lugar de un esfuerzo de rediseño ocasional. Incluso las pequeñas mejoras son importantes. Cuando se aplican pequeñas mejoras de forma coherente en las imágenes de los productos, los mensajes, el diseño o la presentación de precios, el efecto acumulativo puede ser significativo con el tiempo.

Los datos reducen la fricción en la toma de decisiones en equipo

También hay un beneficio psicológico dentro de los equipos que a menudo pasa desapercibido. Las pruebas reducen la fricción en la toma de decisiones. Los debates se alejan de los gustos personales y se orientan hacia resultados mensurables. Cuando los datos sustituyen al debate, el progreso tiende a acelerarse porque las decisiones ya no dependen de la jerarquía o la opinión. Los equipos dedican menos tiempo a discutir sobre la dirección y más a perfeccionar lo que realmente funciona para los usuarios.

Qué debe probar primero

Cuando la gente descubre por primera vez las pruebas A/B, suele caer en la tentación de probarlo todo a la vez. Colores, fuentes, diseños, mensajes, imágenes. El resultado suele ser más ruido que conocimiento. El establecimiento de prioridades es más importante que el volumen de experimentación.

Un buen punto de partida es fijarse en los momentos en los que los clientes toman decisiones. Son puntos en los que la incertidumbre o la indecisión pueden detener el progreso. Cuanto más cerca esté un elemento de ese momento de decisión, mayor será su valor de prueba.

Elementos de alto impacto a tener en cuenta

- Imágenes principales del producto

- Títulos de productos y propuestas de valor

- Presentación de precios o descuentos

- Redacción o ubicación de la llamada a la acción

- Descripción de las principales prestaciones

- Pruebas sociales como reseñas o testimonios

Estos elementos conforman la primera impresión e influyen en la confianza. La presentación visual es importante, pero la claridad lo es más. Los clientes necesitan entender qué es el producto, por qué es importante y qué hacer a continuación. Las pruebas ayudan a perfeccionar ese camino.

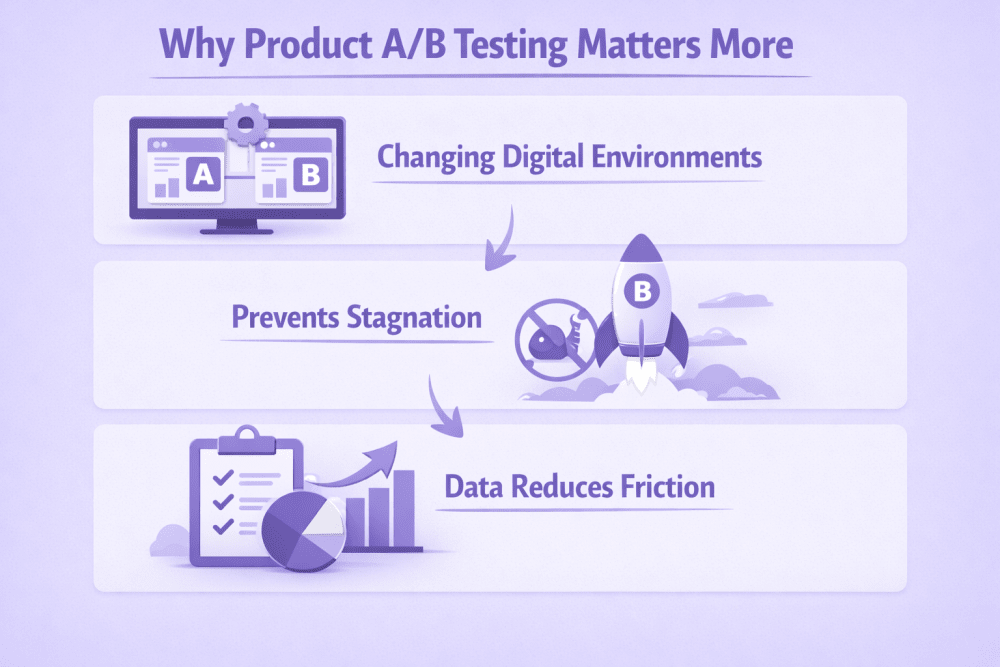

WisePPC: Analítica avanzada para guiar su estrategia de pruebas A/B de producto

En WisePPC, En nuestra opinión, las pruebas A/B son una extensión natural de los análisis. Las pruebas sólo funcionan cuando se entiende claramente lo que ocurre antes y después de un cambio. Por eso, nuestra plataforma se centra en ofrecer a los vendedores una visibilidad completa del rendimiento tanto de la publicidad como de las ventas en un único lugar. Cuando se realizan experimentos en los listados de productos, los precios o la estructura de las campañas, es necesario ver cómo esos cambios afectan a los resultados reales, no sólo a las métricas superficiales. Mediante la combinación de datos históricos, seguimiento del rendimiento en tiempo real y segmentación detallada, ayudamos a identificar si una variación mejora realmente los resultados o simplemente desplaza las cifras temporalmente.

En la práctica, esto significa que permitimos a los equipos comparar el rendimiento entre campañas, ubicaciones y periodos de tiempo sin perder el contexto. Los datos históricos a largo plazo ayudan a evitar errores comunes en las pruebas, como juzgar los resultados demasiado pronto o pasar por alto patrones estacionales. Los análisis granulares y el filtrado facilitan aislar qué ha cambiado y por qué, mientras que las acciones masivas permiten realizar ajustes rápidos una vez identificada la versión ganadora. En lugar de adivinar qué versión funciona mejor, nos centramos en ayudar a los vendedores a conectar las decisiones de pruebas con un impacto empresarial medible, ya sea una mejora del ROAS, una reducción del gasto publicitario desperdiciado o una comprensión más clara de lo que realmente impulsa las conversiones.

Cómo realizar una prueba A/B sin conjeturas

Las pruebas A/B funcionan mejor cuando siguen una secuencia clara. Muchos equipos se lanzan directamente a crear variaciones porque eso les parece un avance. En realidad, la mayoría de las pruebas fallidas ocurren incluso antes de que comience el experimento. La diferencia entre resultados útiles y datos confusos suele estar en la preparación, la claridad y la paciencia.

Esta sección recorre todo el proceso de forma práctica. Cada paso se basa en el anterior, por lo que saltárselo suele crear más problemas más adelante.

Paso 1 - Definir qué significa realmente el éxito

Antes de cambiar nada, es importante entender por qué existe la prueba en primer lugar. Las pruebas A/B sin un objetivo claro se convierten en una actividad sin dirección. Puede que acabes con datos, pero sin una respuesta real.

Un objetivo de pruebas sólido conecta directamente con el comportamiento del usuario. En lugar de intenciones vagas como mejorar el rendimiento, el objetivo debe describir un resultado específico sobre el que se quiere influir. Por ejemplo, más compras completadas, mayor interacción con los detalles del producto o menos usuarios que abandonan antes de finalizar la compra.

Qué suele responder un objetivo claro

- ¿Qué acción del usuario intentamos mejorar?

- En qué punto del trayecto se produce el problema

- Cómo se medirá el éxito

Cuando los objetivos están claros, el análisis posterior resulta más sencillo. Ya sabes qué métrica es la más importante y por qué la estás midiendo.

Ejemplos de objetivos de pruebas específicas

- Aumentar la tasa de compra de productos mejorando su claridad

- Mejorar la tasa de clics en la llamada a la acción principal

- Reducir el abandono de carritos durante la compra

- Aumentar el compromiso con la información clave del producto

Cuanto más claro sea el objetivo, más fácil será diseñar una prueba significativa.

Paso 2 - Convertir las observaciones en una hipótesis comprobable

Una vez definido el objetivo, el siguiente paso es explicar por qué un cambio podría funcionar en primer lugar. Aquí es donde muchas pruebas cobran sentido o se convierten en experimentos aleatorios. Una hipótesis orienta la prueba. Conecta lo que se observa en los datos con un cambio específico que se cree que podría mejorar el resultado.

Una hipótesis no es una suposición ni una idea creativa. Es una suposición estructurada basada en la observación. Algo en la experiencia actual no está funcionando como se esperaba, y la hipótesis explica qué puede estar causando esa fricción. Por ejemplo, si los usuarios abandonan sistemáticamente la página de un producto en pocos segundos, puede que el problema no sea el precio o el diseño. Podría ser simplemente que los visitantes no entienden inmediatamente por qué el producto es importante para ellos. En ese caso, la hipótesis podría ser que mejorar la claridad del titular o del mensaje de apertura ayudará a los usuarios a permanecer más tiempo y a comprometerse más profundamente.

Las hipótesis más útiles suelen proceder de patrones y no de opiniones. Las opiniones de los clientes suelen revelar confusiones o falta de información. Las preguntas de soporte ponen de manifiesto áreas en las que las expectativas no coinciden con la realidad. Los análisis pueden mostrar dónde dudan los usuarios o dónde abandonan el proceso por completo. Incluso la comparación de productos de alto rendimiento con otros más débiles puede revelar diferencias en los mensajes o la presentación que merece la pena probar. Estas señales ayudan a convertir las pruebas en resolución de problemas en lugar de en experimentación porque sí. Es importante centrar la hipótesis. Cada prueba debe responder a una pregunta significativa. Cuando el alcance es limitado, el resultado es más fácil de interpretar y la información obtenida puede aplicarse con confianza a futuras mejoras.

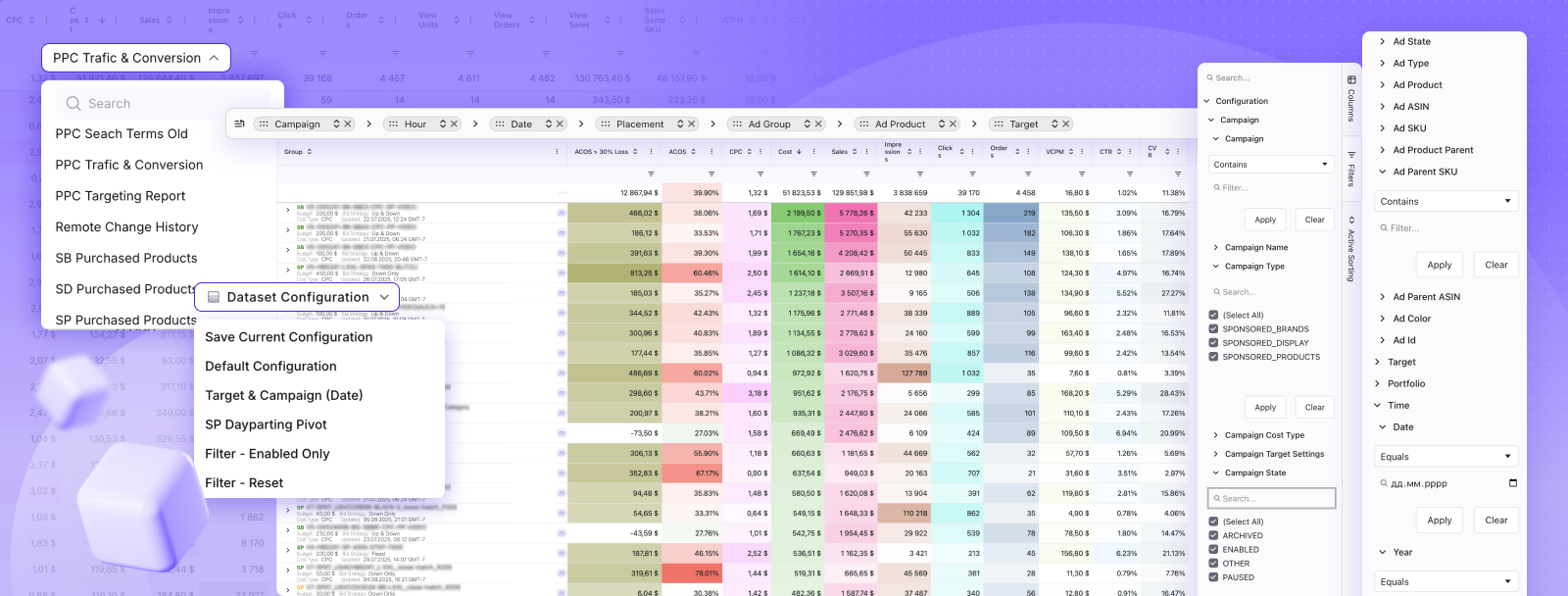

Paso 3 - Crear variantes que aíslen el cambio

Esta es la etapa en la que muchas pruebas A/B pierden silenciosamente su valor. Cuando varias mejoras parecen obvias, el instinto natural es actualizarlo todo a la vez. Una nueva imagen, un texto redactado de nuevo, un diseño ajustado, tal vez incluso cambios en los precios. El problema es que una vez que cambian varios elementos a la vez, los resultados dejan de ser claros. Si el rendimiento mejora, no se puede explicar con seguridad por qué ha ocurrido.

Una prueba A/B bien estructurada mantiene las cosas intencionadamente simples. El objetivo no es rediseñar toda la experiencia, sino aislar una diferencia significativa entre dos versiones. Cuando sólo cambia una variable, la causa y el efecto se hacen visibles. El resultado se convierte en un conocimiento útil en lugar de un resultado afortunado.

Versión de control - la página o listado actual del producto

La versión de control es la versión existente que ya ven los usuarios. Sirve de referencia para la comparación porque ya se conoce su rendimiento. Aquí no se cambia nada. Mantener el control intacto garantiza que cualquier diferencia en el rendimiento proceda de la nueva variación y no de factores externos.

Versión variante - Idéntica salvo un cambio intencionado

La versión variante introduce un único ajuste deliberado basado en la hipótesis. Puede tratarse de una imagen diferente del producto, una redacción revisada del titular o una nueva ubicación para la prueba social. Todo lo demás permanece igual para que el impacto de ese único cambio pueda medirse con precisión. Mantener esta coherencia protege la integridad de la prueba y facilita la interpretación de los resultados.

Cuando las variantes se crean de esta manera, la información obtenida se vuelve reutilizable. Un cambio exitoso puede aplicarse a menudo a otros productos o páginas porque se entiende qué influyó en el comportamiento del usuario, no solo que aumentó el rendimiento.

Paso 4 - Deje que la prueba dure lo suficiente para que sea fiable

Una de las partes más difíciles de las pruebas A/B es la espera. Los primeros datos suelen parecer convincentes, sobre todo cuando una versión empieza a superar rápidamente a la otra. Por desgracia, las primeras tendencias suelen ser temporales.

El comportamiento de los usuarios cambia en función del horario, las fuentes de tráfico e incluso el día de la semana. Una versión que funcione bien durante un breve periodo de tiempo puede no hacerlo de la misma manera a lo largo del tiempo.

Las pruebas necesitan tiempo:

- El comportamiento entre semana y en fin de semana difiere

- Los visitantes nuevos y los recurrentes se comportan de forma diferente

- El tráfico de la campaña fluctúa

- La variación aleatoria puede crear picos a corto plazo

Terminar una prueba demasiado pronto introduce riesgos. Una decisión tomada a partir de datos incompletos puede bloquear una versión más débil y deshacer las mejoras anteriores. La paciencia protege de esta situación.

Paso 5 - Más allá de una única métrica

Es natural centrarse en la métrica principal vinculada al objetivo. Sin embargo, el rendimiento real rara vez es unidimensional. Las mejoras en un área pueden crear compensaciones inesperadas en otras.

Por ejemplo, un mensaje más agresivo puede aumentar los clics pero reducir la calidad de la compra. El compromiso aumenta, pero el valor a largo plazo disminuye. Observar las métricas de apoyo ayuda a revelar estas situaciones antes de introducir los cambios de forma generalizada.

Métricas que merece la pena revisar junto con el objetivo principal

- Tasa de conversión

- Ingresos por visitante

- Añadir a la cesta

- Tiempo de permanencia en la página

- Índices de rebote o de salida

- Indicadores de calidad del cliente

Un análisis equilibrado tiene en cuenta tanto las señales de compromiso como los resultados empresariales. La versión más eficaz no siempre es la que tiene más clics. Es la que permite obtener resultados sostenibles.

Errores comunes en las pruebas A/B

La mayoría de los problemas de las pruebas A/B no provienen de malas intenciones o falta de esfuerzo. Suelen aparecer cuando los equipos se mueven demasiado rápido o intentan forzar conclusiones antes de que los datos estén listos. Las pruebas parecen sencillas a primera vista, pero pequeños errores en la configuración o la interpretación pueden llevar a decisiones que silenciosamente perjudican el rendimiento en lugar de mejorarlo. Entender dónde suelen fallar las cosas ayuda a que los experimentos sigan siendo útiles y fiables.

Probar demasiados cambios a la vez

Este es probablemente el problema más común, sobre todo cuando los equipos están ansiosos por mejorar los resultados rápidamente. Varios elementos parecen débiles, así que todo se actualiza al mismo tiempo. La página tiene mejor aspecto, el rendimiento cambia y todo el mundo asume que la prueba ha funcionado. El problema es que nadie sabe qué cambio marcó realmente la diferencia.

Cuando múltiples variables se mueven juntas, resulta imposible aprender del resultado. Es posible que accidentalmente se mantengan los cambios que perjudican el rendimiento y se eliminen los que ayudan. Con el tiempo, esto crea resultados incoherentes y dificulta las pruebas futuras.

Las pruebas A/B funcionan mejor cuando cada experimento responde a una pregunta clara. Un cambio, una comparación, una conclusión.

Terminar las pruebas demasiado pronto

Los primeros datos pueden ser convincentes. Una variante muestra una mejora al cabo de unos días y la tentación de declarar un ganador se hace fuerte. El problema es que los primeros resultados suelen ser inestables. Los patrones de tráfico cambian a lo largo de la semana, las campañas cambian y el comportamiento de los usuarios varía en función del momento.

Detener una prueba demasiado pronto aumenta las posibilidades de elegir un falso ganador. Lo que parece una mejora puede ser simplemente una fluctuación a corto plazo. Dejar tiempo suficiente para que el comportamiento se normalice ayuda a garantizar que el resultado refleja el rendimiento real y no una coincidencia.

La paciencia no es una pérdida de tiempo. Te protege de introducir cambios que luego haya que revertir.

Optimizar para la métrica equivocada

No todas las mejoras son realmente mejoras. A veces, una prueba aumenta la actividad sin mejorar los resultados importantes para la empresa. Por ejemplo, un mensaje más agresivo puede aumentar los clics pero atraer a compradores menos serios, lo que puede reducir los ingresos o la retención.

Esto suele ocurrir cuando los equipos se centran en métricas fáciles en lugar de en métricas significativas. Las métricas siempre deben estar relacionadas con el objetivo real del producto o la campaña.

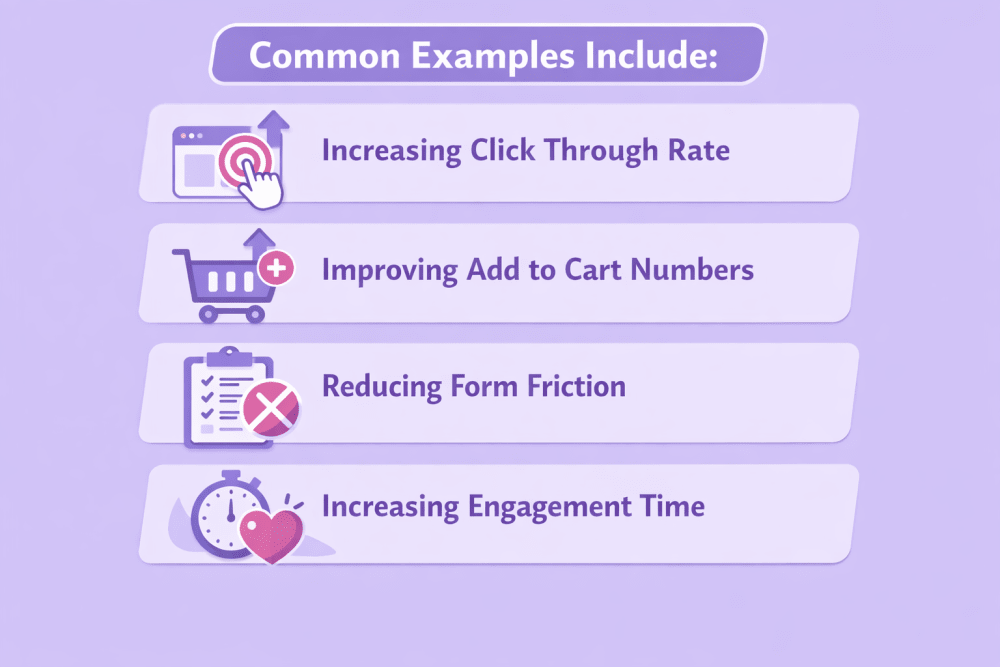

Algunos ejemplos comunes son:

- Aumento de la tasa de clics mientras disminuye la tasa de compras

- Mejorar el número de añadidos a la cesta sin mejorar los pedidos completados

- Reducción de la fricción de los formularios pero disminución de la calidad de las pistas

- Aumentar el tiempo de compromiso sin aumentar las conversiones

Examinar las métricas de apoyo junto con el objetivo principal ayuda a prevenir estas situaciones.

Suponer que un resultado se adapta a todos los públicos

Otro error frecuente es suponer que una versión ganadora funciona igual de bien para todos. En realidad, los distintos segmentos de público suelen comportarse de forma diferente. Los nuevos visitantes pueden necesitar más explicaciones, mientras que los clientes habituales prefieren rapidez y familiaridad. Los usuarios de móviles pueden responder de forma diferente a los de ordenadores de sobremesa.

Ignorar estas diferencias puede ocultar información valiosa. A veces, una variante perdedora en general funciona excepcionalmente bien para un segmento específico. Reconocer estos patrones puede conducir a mejoras más específicas en lugar de un cambio universal.

Conclusión

Las pruebas A/B suelen describirse como una táctica, pero en la práctica se convierten en una forma de concebir la mejora. En lugar de hacer cambios basados en el instinto o el debate interno, se da voz a los usuarios reales en la decisión. A veces los resultados confirman lo que se esperaba. Otras veces cuestionan supuestos de los que ni siquiera se había dado cuenta. Ambos resultados hacen avanzar el producto.

Lo más importante es la coherencia. Una prueba no transformará el rendimiento de la noche a la mañana, y eso es perfectamente normal. El valor real aparece con el tiempo, a medida que se acumulan los pequeños conocimientos. Se empieza a comprender cómo interpretan los clientes los mensajes, qué genera confianza y dónde aparecen las fricciones en el proceso de compra. Las decisiones se vuelven más tranquilas, los cambios más seguros y el progreso más predecible.

Si hay algo que merece la pena recordar es que las pruebas no consisten en perseguir la perfección. Los productos evolucionan, el público cambia y siempre surgen nuevas ideas. Las pruebas A/B simplemente le ofrecen una forma fiable de adaptarse sin tener que adivinar. Empiece con una pregunta clara, pruébela honestamente y deje que los resultados guíen el siguiente paso.

PREGUNTAS FRECUENTES

¿Cuánto tiempo debe durar una prueba A/B antes de elegir al ganador?

No existe un calendario universal porque depende del volumen de tráfico y del número de conversiones generadas. En general, una prueba debe durar lo suficiente para captar el comportamiento normal de los usuarios en diferentes días y patrones de tráfico. Finalizar una prueba demasiado pronto suele llevar a conclusiones erróneas, por lo que es mejor esperar a que los resultados se estabilicen en lugar de reaccionar a las primeras tendencias.

¿Pueden los pequeños cambios marcar realmente la diferencia en las pruebas A/B?

Sí, y de ahí suelen venir las mejoras sorprendentes. Una imagen diferente, un titular más claro o una mejor ubicación de la información clave pueden cambiar la rapidez con que los usuarios entienden un producto. Estos cambios pueden parecer menores internamente, pero pueden afectar significativamente a la forma en que los clientes toman decisiones.

¿Qué debo probar primero si soy nuevo en las pruebas A/B?

Suele tener sentido empezar por los elementos que influyen directamente en las decisiones de compra. Las imágenes de los productos, las propuestas de valor y las llamadas a la acción suelen tener un mayor impacto que los ajustes puramente visuales. Probar las áreas más cercanas a la conversión ayuda a obtener resultados más claros desde el principio.

¿Es posible que una prueba A/B fracase?

Por supuesto, y eso no significa que la prueba haya sido en vano. Un resultado que no muestra ninguna mejora sigue proporcionando información. Te dice que una suposición concreta era incorrecta, lo que evita errores mayores más adelante. Con el tiempo, estos aprendizajes ayudan a perfeccionar futuros experimentos.

¿Necesito herramientas especiales para realizar pruebas A/B con eficacia?

Las herramientas ayudan con el seguimiento y el análisis, sobre todo a medida que las pruebas se hacen más frecuentes, pero la idea central no depende de un software complejo. Lo más importante es tener objetivos claros, aislar los cambios adecuadamente y analizar los resultados con cuidado. La tecnología apoya el proceso, pero la disciplina hace que funcione.

Únase a la beta de WisePPC y obtenga ventajas de acceso exclusivas

WisePPC ya está en fase beta, y estamos invitando a un número limitado de primeros usuarios a unirse. Como probador de la versión beta, obtendrá acceso gratuito, ventajas de por vida y la oportunidad de ayudar a dar forma al producto. Socio verificado de Amazon Ads de confianza.

No se necesita tarjeta de crédito

No se necesita tarjeta de crédito

Gratis en beta y un mes más gratis tras el lanzamiento

Gratis en beta y un mes más gratis tras el lanzamiento

25% de descuento de por vida - oferta beta limitada

25% de descuento de por vida - oferta beta limitada

Acceda a las métricas que Amazon Ads no le muestra

Acceda a las métricas que Amazon Ads no le muestra

Participe en la creación del producto con sus comentarios

Participe en la creación del producto con sus comentarios